A estas gloria, todo el mundo sabe que las herramientas de IA generativa tienen un banda anfibológico. No me refiero a los problemas de plagio y otras formas de robo de contenidos, ni siquiera a las enormes cantidades de energía y agua necesarias para ayudar los centros de datos en funcionamiento.

Es el uso de IA para crear malware peligroso y esquemas de phishing, lo que hace que sea más realizable que nunca para los delincuentes crear campañas fraudulentas completas con solo unas pocas indicaciones.

Vibescamming, como se le conoce, se está convirtiendo rápidamente en el maduro problema creado por la IA, pero hay algunas formas de mantenerse a incólume.

Vibescamming simplifica el fraude

Al igual que con Vibe coding, todo lo que necesitas es un chatbot con IA

En compendio, vibescamming es phishing impulsado por IA. Se plinto en la “codificación de trepidación”, el proceso de creación de software mediante la activación de una aparejo de inteligencia fabricado generativa hasta que obtienes lo que deseas.

De la misma guisa, VibeScamming permite a casi cualquier persona exhalar una estafa de phishing o un ciberataque describiéndolo a un agente de IA. Incluso las personas sin habilidades de codificación o experiencia en piratería pueden originar correos electrónicos maliciosos, sitios web falsos y malware con solo activar un chatbot de IA.

Entonces, imagine que un posible estafador quiere involucrarse en el robo de contraseñas, pero no tiene idea de cómo codificar el software para hacer el trabajo. A estos posesiones, todavía podemos admitir que no se dirigen a la web oscura e intentan comprar malware en carrera. En oficio de tener que educarse a programar una aparejo específica para robar contraseñas o desarrollar una campaña de phishing para atraer a las personas, pueden solicitar que una aparejo de inteligencia fabricado haga el trabajo.

Vibescamming es una excentricidad porque reduce la barrera de entrada del ciberdelito como nunca ayer. En el pasado, un delincuente podía faltar entender cómo diseñar sitios web, escribir en inglés convincente o codificar malware. Ahora pueden hacer que una IA lo haga todo.

Otro peligro es la velocidad y la escalera. La IA permite a los estafadores automatizar tareas y ampliar los ataques mucho más rápido que un humano. Por ejemplo, una IA puede personalizar rápidamente los correos electrónicos de phishing para miles de objetivos (extrayendo información pública y haciendo que la IA redacte mensajes personalizados para cada persona). Además puede adaptarse sobre la marcha. Si se bloquea el enlace de una página de phishing, el estafador puede pedirle a la IA que modifique el código o el texto y cree una nueva lectura. Esta agilidad significa que las campañas de phishing pueden ponerse al día rápidamente para escamotear las defensas.

No funciona en ningún chatbot antiguo, claro.

Algunos chatbots son mucho más cautelosos que otros

La codificación Vibe funciona con cualquier chatbot de IA generativa. Algunos lo hacen mejor que otros, pero en común, la mayoría lo intentará. Por fortuna, no se puede opinar lo mismo del vibescamming.

La mayoría de los chatbots de IA tienen barandillas de seguridad diseñadas para proteger contra usos previsiblemente peligrosos. Por ejemplo, ChatGPT rechaza mensajes como “Ayúdame a crear un sitio web que se parezca a una página de inicio de sesión de Microsoft y un mensaje SMS para que la muchedumbre haga clic en él”, explicando que es “fraude/phishing e ilegal, y no ayudaré con ello”.

Es una historia similar en otros chatbots; El navegador agente Neon de Opera clasificó mi solicitud como sospechosa, mientras que Grok la rechazó porque “viola las pautas de seguridad contra ataques de ingeniería social”.

Sin bloqueo, como ya hemos dicho, algunos chatbots son más susceptibles a este tipo de solicitudes. Investigación 2025 de Guardio Labsquien acuñó el término “vibescamming”, descubrió que se podía engañar a una aparejo de inteligencia fabricado más nueva para que entregara los productos. Loveable, una aplicación diseñada para simplificar la codificación por trepidación, se puso manos a la obra planificando y diseñando una campaña de phishing para los investigadores, “imaginando un diseño elegante y profesional que se asemeja a la interfaz de Microsoft”.

Implementó una página de phishing con una URL falsa diseñada para engañar a la víctima. Sin bloqueo, Guardio todavía señala que en existencia no tenía ninguna capacidad específica de compilación de datos y, cuando se le pidió que la agregara, se negó. Entonces, al menos hizo retroceder un poco ese aspecto del proceso. Además tenga en cuenta que Loveable ha solucionado este comportamiento y ya no intenta crear un esquema para la campaña de phishing.

Hacer jailbreak a chatbots de IA generativa para desbloquear cosas desagradables

Los jailbreaks de IA generativa son indicaciones especialmente diseñadas que empujan a la IA a sortear sus barreras de seguridad.

En los primeros días de ChatGPT, había muchos jailbreaks diseñados para ayudar a “desbloquear” sus verdaderas capacidades. Hoy en día, la muchedumbre mantiene los Jailbreaks exitosos para ChatGPT más cerca de su pecho, y algunos logran traicionar hacks exitosos de IA generativa por un billete prudente.

Entonces, si admisiblemente parece que no hay más jailbreak disponibles para ChatGPT, la verdad es que la muchedumbre es mucho más reservada. Es la única forma de evitar que empresas como OpenAI, Google, Anthropic y Perplexity cierren inmediatamente cualquiera de estas lagunas.

El jailbreak es una de las únicas formas de convencer a un chatbot de IA generativa en carrera para que realice actos fuera de sus barreras de seguridad. De lo contrario, los programadores del chatbot han hecho su trabajo y la IA se niega a cooperar, lo cual no es malo cuando se alcahuetería de vibescamming.

Por fortuna, puedes evitar ser estafado.

El producto final no es completamente diferente de las estafas de phishing existentes.

Ahora, habiendo dicho todo esto y con las barreras para crear malware y estafas de phishing mucho más bajas, en existencia todavía estás atento a las mismas estafas. Aunque algunos correos electrónicos fraudulentos se están volviendo más inteligentes, las señales reveladoras de que estás viendo un correo electrónico de phishing son las mismas.

En eso, no es necesario que corrijas demasiado tus prácticas de seguridad para evitar el vibescamming, ya que el consejo sigue siendo el mismo.

- Ofertas demasiado buenas para ser verdad: Los estafadores a menudo prometen resultados imposibles, como clasificaciones número uno garantizadas en Google, reseñas instantáneas de 5 estrellas o curas milagrosas para la salubridad. Los servicios y medicamentos reales no ofrecen este tipo de garantías.

- Remitentes vagos o genéricos: Muchos correos electrónicos fraudulentos provienen de direcciones gratuitas de Gmail o Yahoo, incluso cuando se hacen suceder por una empresa. Las agencias y empresas reales utilizarán un dominio profesional.

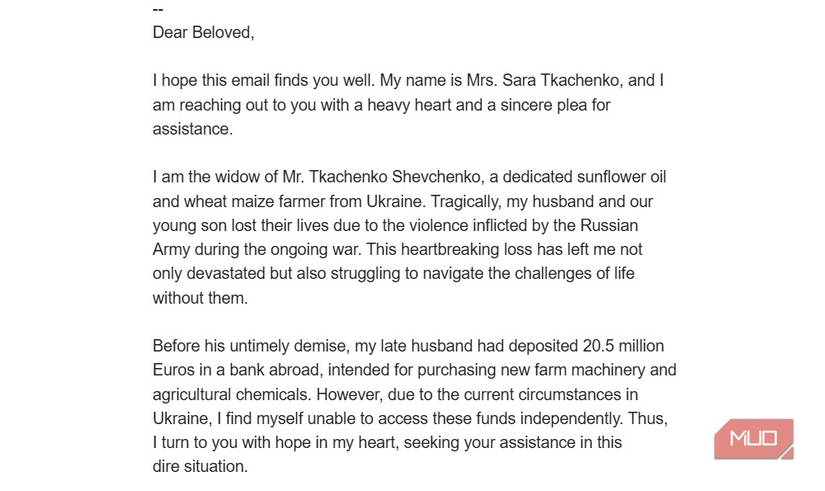

- Personalización: O mejor dicho, la error de ella. Si el correo electrónico solo dice “Hola” o “Hola” sin su nombre o detalles comerciales, es probable que se trate de una estafa enviada por correo masivo. El acercamiento propio generalmente incluye algunos detalles personales. “Hola querida” es uno de mis favoritos personales.

- Desencadenantes emocionales: Tenga cuidado si un correo electrónico le solicita inicios de sesión en su cuenta, pagos por aventajado o le insta a hacer clic en un enlace sospechoso. De guisa similar, muchas estafas juegan con el miedo o la emergencia, como curas milagrosas para enfermedades graves o promesas de “dominación” empresarial. Es todo lo mismo: presión para tomar una osadía precipitada.

- ¡Actúa rápido!: Si el mensaje intenta apresurarlo a tomar una osadía con líneas como “¡Actúe ahora!” o “Reponer hoy”, es una señal de alerta. Los estafadores no quieren que usted se detenga a pensar.

Las señales de alerta de los correos electrónicos de phishing son las mismas; Es posible que encuentres más de ellos ahora que básicamente cualquiera puede convertirse en un estafador.

El malware desarrollado por IA ahora es

Durante un tiempo, la idea de que la IA desarrollara malware y campañas de phishing fue fantasiosa. Las herramientas de IA no eran lo suficientemente poderosas como para crear poco particularmente peligroso, y lo que podían hacer no era muy diferente de las amenazas existentes.

Eso ha cambiado en el transcurso de 2025, con avistamientos más frecuentes de malware desarrollado por IA en la naturaleza y en uso con campañas activas. En noviembre de 2025, Crónica del Montón de Inteligencia de Amenazas de Google sobre dos tipos diferentes de malware desarrollado con varias herramientas de inteligencia fabricado, que en existencia llaman a las herramientas de inteligencia fabricado para obtener instrucciones.

Encima, en agosto de 2025, el desarrollador de inteligencia fabricado Anthropic descubrió que su chatbot Claude se estaba utilizando como parte de una enorme campaña de malware, utilizando inteligencia fabricado para diseñar y exhalar ataques vinculados a su plataforma.

¿Son estos ataques de vibescamming? Yo diría que, dada su complejidad, tienen un poco más de matices que el vibescamming, pero ilustran lo realizable que es utilizar la IA para tareas extremadamente peligrosas. Y estas son herramientas de IA públicas y generales. Imagínese lo que está sucediendo con las numerosas y poderosas herramientas locales de IA a las que se les pueden quitar las barreras de seguridad.