Los investigadores de Apple han desarrollado un maniquí de IA que mejoramiento drásticamente las fotografías extremadamente oscuras al integrar un maniquí de imagen basado en difusión directamente en el proceso de procesamiento de imágenes de la cámara, lo que le permite recuperar detalles de los datos sin procesar del sensor que normalmente se perderían. Así es como lo hicieron.

El problema de las fotografías con poca luz extrema

Probablemente hayas tomado una fotografía en condiciones muy oscuras, lo que resultó en una imagen llena de ruido digital granulado.

Esto sucede cuando el sensor de imagen no capta suficiente luz.

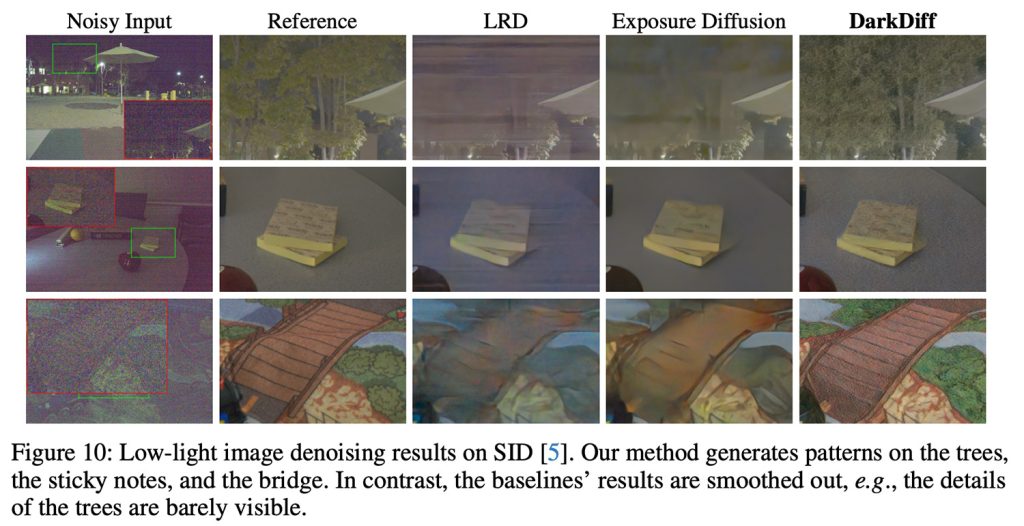

Para tratar de compensar esto, empresas como Apple han estado aplicando algoritmos de procesamiento de imágenes que han sido criticados por crear pertenencias demasiado suaves, parecidos a los de una pintura al óleo, donde los detalles finos desaparecen o se reconstruyen en poco escasamente reconocible o descifrable.

Introduzca DarkDiff

Para tocar este problema, investigadores de Apple y la Universidad Purdue han desarrollado un maniquí llamado DarkDiff. Así lo presentan en un estudio llamado DarkDiff: Avanzando en la mejoramiento cruda en condiciones de poca luz mediante la reasignación de modelos de difusión para cámaras ISP:

La fotografía de incorporación calidad en condiciones de poca luz extrema es un desafío pero impactante para las cámaras digitales. Con hardware informático progresista, los algoritmos tradicionales del procesador de señal de imagen (ISP) de la cámara están siendo reemplazados gradualmente por redes profundas eficientes que mejoran las imágenes sin procesar ruidosas de guisa más inteligente. Sin requisa, los modelos existentes basados en regresión a menudo minimizan los errores de píxeles y dan como resultado un suavizado excesivo de fotografías con poca luz o sombras profundas. Trabajos recientes han intentado tocar esta muro entrenando un maniquí de difusión desde cero, pero esos modelos todavía tienen dificultades para recuperar detalles nítidos de la imagen y colores precisos. Introducimos un ámbito novedoso para mejorar imágenes sin procesar con poca luz al reasignar modelos de difusión generativa previamente entrenados con la cámara ISP. Amplios experimentos demuestran que nuestro método supera lo zaguero en calidad de percepción en tres desafiantes puntos de relato de imágenes sin procesar con poca luz.

En otras palabras, en puesto de aplicar IA en la etapa de posprocesamiento, reasignaron Stable Diffusion (un maniquí de código amplio entrenado en millones de imágenes) para comprender qué detalles debería existe en áreas oscuras de las fotografías considerando su contexto universal y lo integró en el proceso de procesamiento de señales de imágenes.

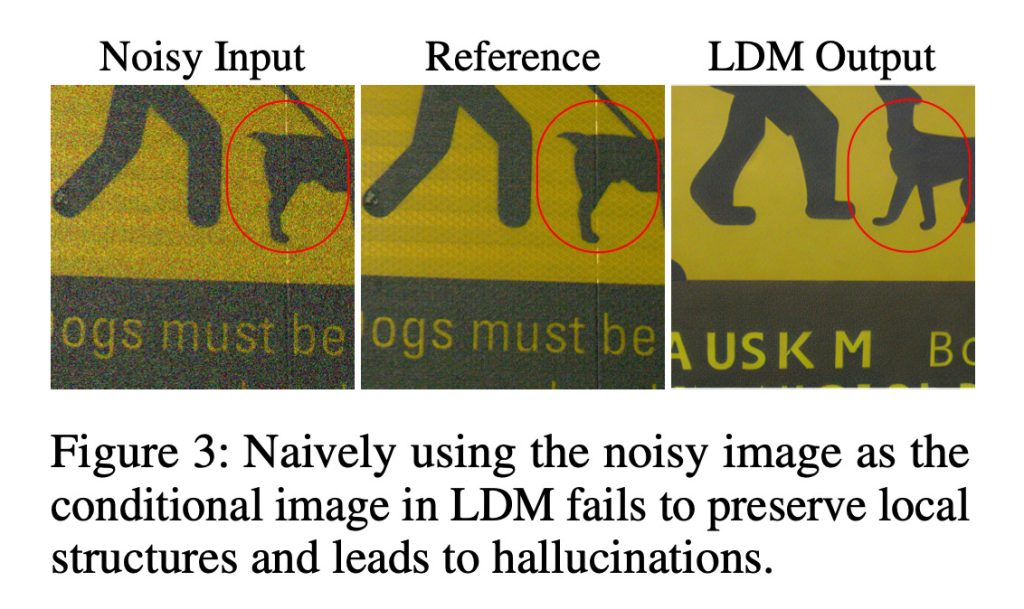

De hecho, su enfoque introduce un mecanismo que calcula la atención sobre parches de imágenes localizadas, lo que ayuda a preservar las estructuras locales y mitiga las alucinaciones como en la imagen a continuación, donde la IA de reconstrucción cambia el contenido de la imagen por completo.

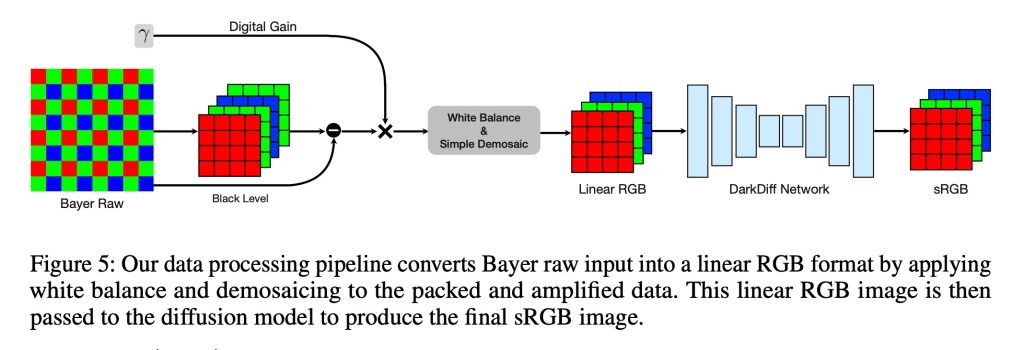

Con este enfoque, el ISP de la cámara aún maneja el procesamiento auténtico necesario para dar sentido a los datos sin procesar del sensor, incluidos pasos como el vaivén de blancos y la demostración. DarkDiff luego opera en esta imagen RGB derecho, eliminándola y produciendo directamente la imagen sRGB final.

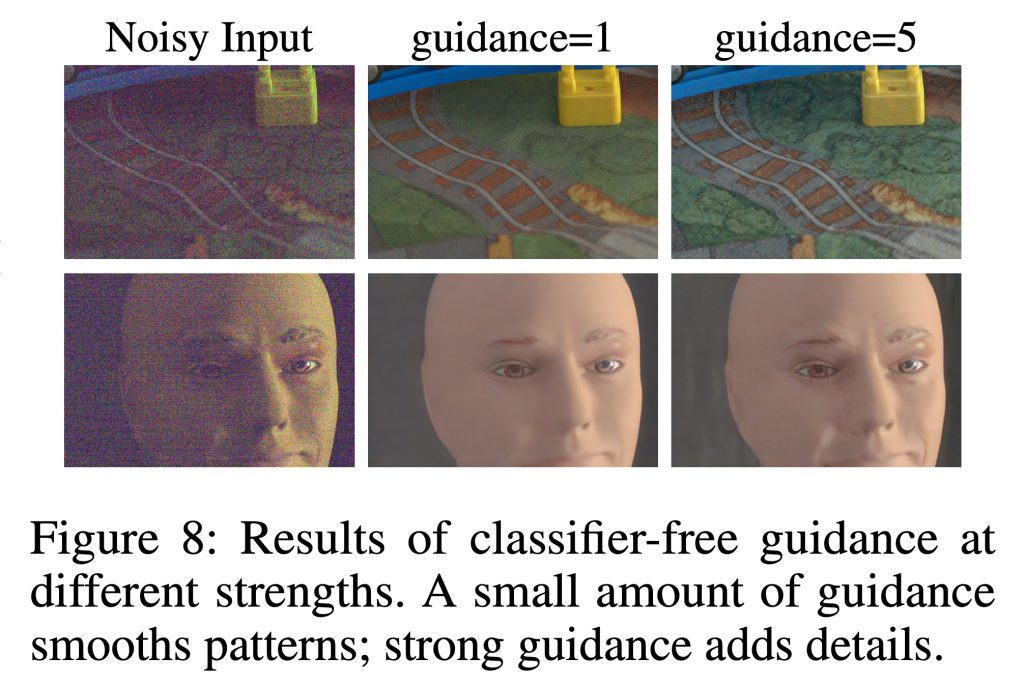

DarkDiff asimismo utiliza una técnica de difusión standard señal norte sin clasificador, que básicamente controla con qué fuerza el maniquí debe seguir la imagen de entrada, en comparación con sus circunstancias visuales aprendidos.

Con una norte beocio, el maniquí produce patrones más suaves, mientras que una norte maduro lo alienta a crear texturas más nítidas y detalles más finos (lo que a su vez, asimismo aumenta el aventura de producir artefactos no deseados o contenido alucinado).

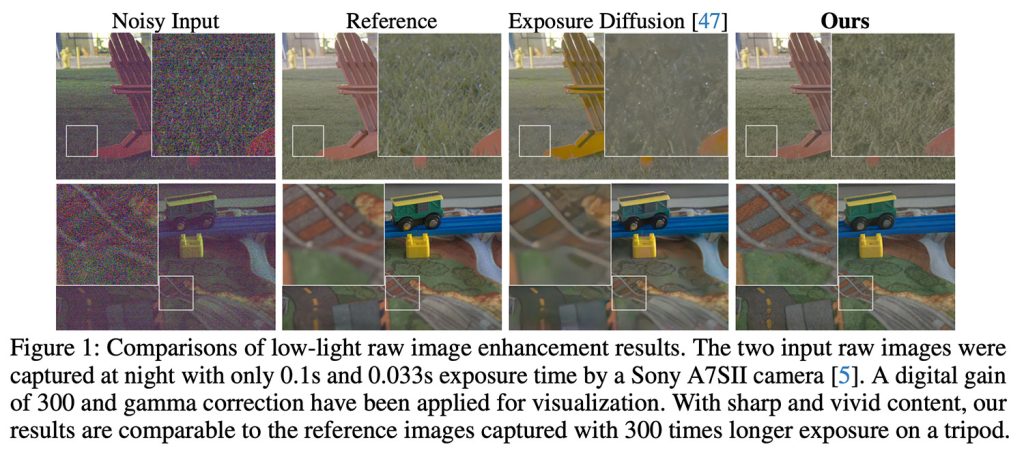

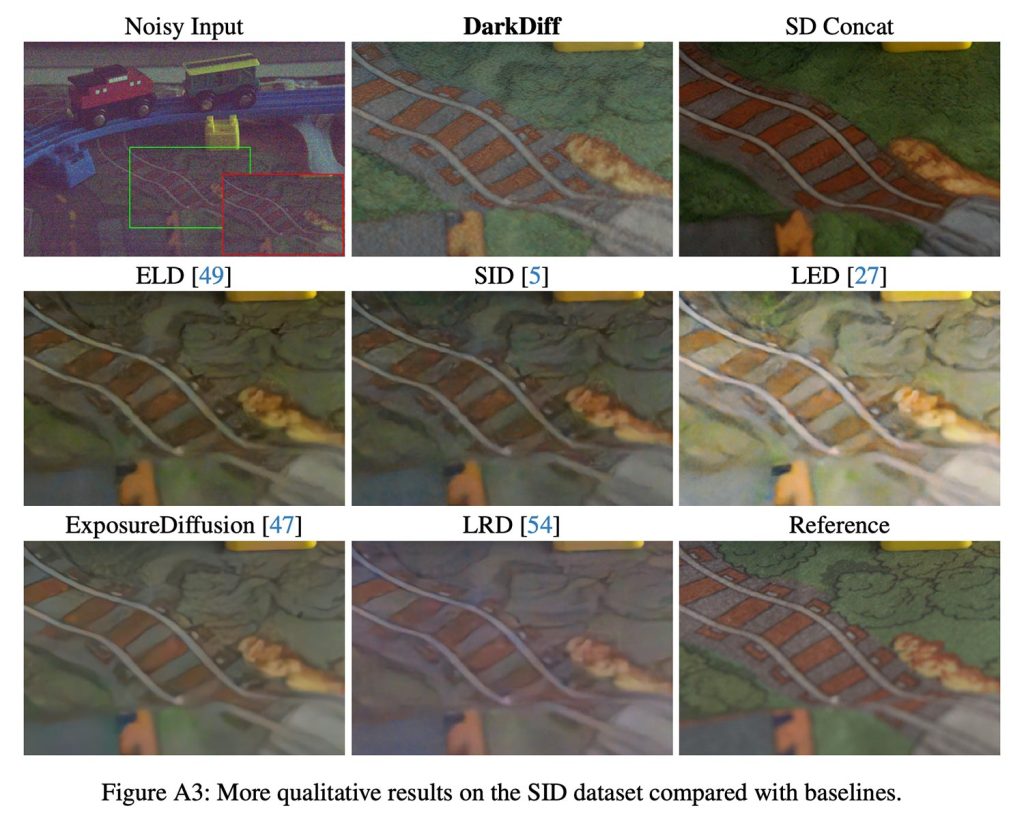

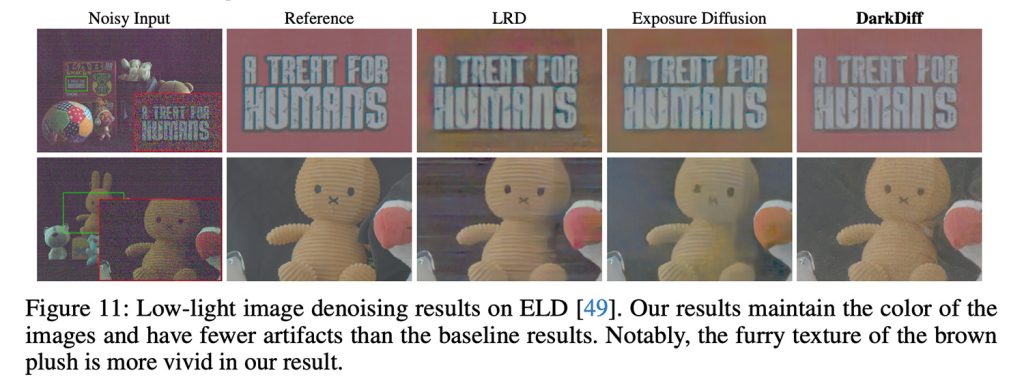

Para probar DarkDiff, los investigadores utilizaron fotografías reales tomadas con luz extremadamente muerto con cámaras como la Sony A7SII, comparando los resultados con otros modelos de mejoramiento sin procesar y líneas de almohadilla basadas en difusión, incluida ExposureDiffusion.

Las imágenes de prueba se capturaron de oscuridad con tiempos de exposición de tan solo 0,033 segundos, y las versiones mejoradas de DarkDiff se compararon con fotografías de relato capturadas con una exposición 300 veces más larga en un trípode.

Estos son algunos de los resultados (que te animamos a ver) en plena calidad en el estudio diferente):

DarkDiff no está exento de problemas

Los investigadores señalan que su procesamiento basado en IA es significativamente más sosegado que los métodos tradicionales y probablemente requeriría procesamiento en la montón para compensar los altos requisitos computacionales que agotarían rápidamente la condensador si se ejecutara localmente en un teléfono. Por otra parte de eso, asimismo notan limitaciones en el inspección de texto que no está en inglés en escenas con poca luz.

Todavía es importante tener en cuenta que en ninguna parte del estudio se sugiere que DarkDiff llegue pronto a los iPhone. Aún así, el trabajo demuestra el enfoque continuo de Apple en los avances en la fotografía computacional.

En los últimos primaveras, esta se ha convertido en un campo de acción de interés cada vez más importante en todo el mercado de teléfonos inteligentes, ya que los clientes exigen capacidades de cámara que superen lo que las empresas pueden colocar físicamente en el interior de sus dispositivos.

Para ojear el estudio completo y ver comparaciones adicionales entre DarkDiff y otros métodos de matanza de ruido, sigue este enlace.

Ofertas de accesorios en Amazon

FTC: Utilizamos enlaces de afiliados automáticos que generan ingresos. Más.