Un equipo de investigadores de Apple se propuso comprender qué esperan los usuarios reales de los agentes de IA y cómo preferirían interactuar con ellos. Esto es lo que encontraron.

Apple explora las tendencias de UX para la era de los agentes de IA

En el estudio, titulado Mapeo del espacio de diseño de la experiencia del favorecido para agentes de uso informáticoun equipo de cuatro investigadores de Apple dice que si aceptablemente el mercado ha estado invirtiendo mucho en el progreso y evaluación de agentes de IA, se han pasado por parada algunos aspectos de la experiencia del favorecido: cómo los usuarios podrían querer interactuar con ellos y cómo deberían hallarse estas interfaces.

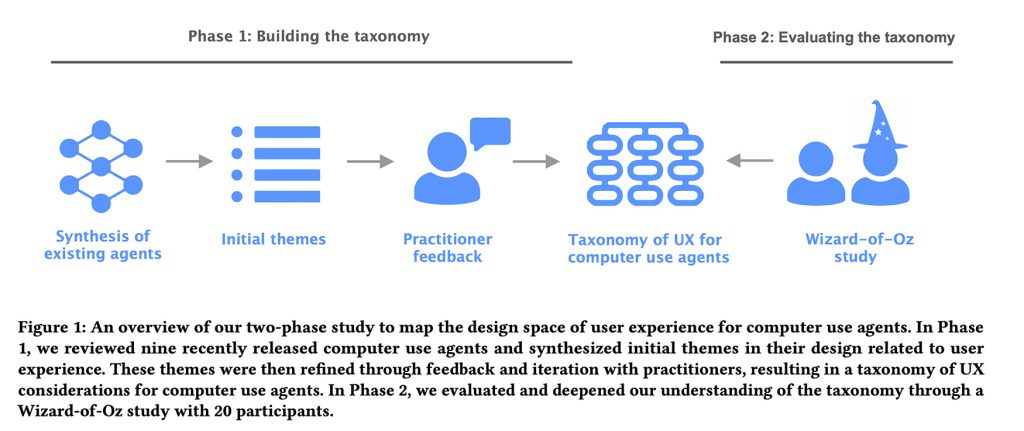

Para explorar eso, dividieron el estudio en dos fases: primero, identificaron los principales patrones de UX y las consideraciones de diseño que los laboratorios de IA han estado incorporando a los agentes de IA existentes. Luego, probaron y refinaron esas ideas mediante estudios prácticos de usuarios con un método interesante llamado Mago de Oz.

Al observar cómo esos patrones de diseño se mantienen en las interacciones de los usuarios del mundo auténtico, pudieron identificar qué diseños actuales de agentes de IA se alinean con las expectativas de los usuarios y cuáles se quedan cortos.

Escalón 1: La taxonomía

Los investigadores analizaron nueve agentes de escritorio, móviles y basados en la web, entre ellos;

- Útil de uso informático Claude

- Adepto

- Cámara OpenAI

- Alicia

- UI magnética

- UI-TARS

- Tesina Marinero

- TaxiAI

- AutoGLM

Luego, consultaron con “8 profesionales que son diseñadores, ingenieros o investigadores que trabajan en los dominios de UX o AI en una gran empresa de tecnología”, lo que les ayudó a trazar una taxonomía completa con cuatro categorías, 21 subcategorías y 55 características de ejemplo que cubren las consideraciones secreto de UX detrás de los agentes de AI que utilizan computadoras.

Las cuatro categorías principales incluyeron:

- Consulta de favorecido: cómo los usuarios ingresan comandos

- Explicabilidad de las actividades de los agentes: qué información presentar al favorecido sobre las acciones del agente

- Control de favorecido: cómo pueden intervenir los usuarios

- Maniquí mental y expectativas: cómo ayudar a los usuarios a comprender las capacidades del agente

En esencia, ese situación abarcaba todo, desde aspectos de la interfaz que permiten a los agentes presentar sus planes a los usuarios, hasta cómo comunican sus capacidades, descubren errores y permiten a los usuarios intervenir cuando poco sale mal.

Con todo eso en la mano, pasaron a la período 2.

Escalón 2: El estudio del Mago de Oz

Los investigadores reclutaron a 20 usuarios con experiencia previa con agentes de IA y les pidieron que interactuaran con un agente de IA a través de una interfaz de chat para realizar una tarea de inquilinato vacacional o una tarea de importación en partidura.

Del estudio:

A los participantes se les proporcionó una interfaz de chat de favorecido simulada a través de la cual podían interactuar con un “agente” interpretado por el investigador. Mientras tanto, al participante todavía se le presentó la interfaz de ejecución del agente, donde el investigador actuó como agente e interactuó con el Ul en la pantalla según el comando del participante. En la interfaz de chat del favorecido, los participantes podían ingresar consultas textuales en lengua natural, que luego aparecían en el hilo del chat. Luego, el “agente” comenzó la ejecución, donde el investigador controlaba el mouse y el teclado de su extremo para afectar las acciones del agente en la página web. Cuando el investigador completó la tarea, ingresó una tecla de golpe directo que publicó un mensaje de “tarea completada” en el hilo del chat. Durante la ejecución, los participantes podrían usar un gema de interrupción para detener al agente y aparecería un mensaje “agente interrumpido” en el chat.

En otras palabras, sin que los usuarios lo supieran, el agente de IA era, en verdad, un investigador sentado en la habitación de al banda, que leía las instrucciones en texto y realizaba la tarea solicitada.

Para cada tarea (inquilinato vacacional o compras en partidura), se pidió a los participantes que realizaran seis funciones con la ayuda del agente de IA, algunas de las cuales el agente fallaría intencionalmente (como quedarse atascado en un tirabuzón de navegación) o cometería errores intencionales (como distinguir poco diferente de las instrucciones del favorecido).

Al final de cada sesión, los investigadores pidieron a los participantes que reflexionaran sobre su experiencia y propusieran características o cambios para mejorar la interacción.

Igualmente analizaron grabaciones de video y registros de chat de cada sesión para identificar temas recurrentes en el comportamiento del favorecido, expectativas y puntos débiles al interactuar con el agente.

Hallazgos principales

Una vez que todo estuvo dicho y hecho, los investigadores descubrieron que los usuarios quieren tener visibilidad de lo que están haciendo los agentes de IA, pero no microgestionar cada paso, de lo contrario podrían simplemente realizar las tareas ellos mismos.

Igualmente concluyeron que los usuarios quieren diferentes comportamientos de los agentes dependiendo de si están explorando opciones o ejecutando una tarea descendiente. Asimismo, las expectativas de los usuarios cambian según si están familiarizados con la interfaz. Cuanto menos familiarizados estaban, más querían transparencia, pasos intermedios, explicaciones y pausas de confirmación (incluso en escenarios de bajo peligro).

Igualmente descubrieron que las personas quieren tener más control cuando las acciones conllevan consecuencias reales (como realizar compras, cambiar detalles de cuenta o de plazo, o contactar a otras personas en su nombre), y todavía descubrieron que la confianza se rompe rápidamente cuando los agentes hacen suposiciones o errores silenciosos.

Por ejemplo, cuando el agente encontró opciones ambiguas en una página, o se desvió del plan diferente sin marcarlo claramente, los participantes le indicaron al sistema que hiciera una pausa y pidiera una nota, en sitio de simplemente designar poco aparentemente al azar y seguir delante.

En el mismo sentido, los participantes informaron que se sentían incómodos cuando el agente no era transparente a la hora de tomar una intrepidez en particular, especialmente cuando esa dilema podía conducir a la selección del producto desacertado.

Considerándolo todo, este es un estudio interesante para los desarrolladores de aplicaciones que buscan adoptar capacidades de agencia en sus aplicaciones, y puedes leerlo en su totalidad. aquí.

Ofertas de accesorios en Amazon