Mientras el mundo arde a nuestro más o menos conveniente a que las corporaciones persiguen la IA con fortuna aparentemente ilimitados, deberíamos ver qué nos ha traído toda esta conmoción. Recientemente, la concurrencia de Ars Technica puso a prueba cuatro de los agentes de codificación de IA más popularescon una pregunta engañosamente simple: construye Buscaminas para la web. El clon tenía que incluir enseres de sonido, soporte para pantalla táctil móvil y un toque de articulación “divertido”.

Para aquellos que no lo saben, Buscaminas se zócalo en la deducción, que dicta la jugabilidad, cercano con nociones UI/UX suficiente razonables que se combinan para crear un desafío curioso. No es exactamente difícil hacer un clon del Buscaminas, pero su mecánica subyacente requiere al menos cierto nivel de ingenio que generalmente proviene de los humanos; a posteriori de todo, el objetivo es AGI, ¿verdad?

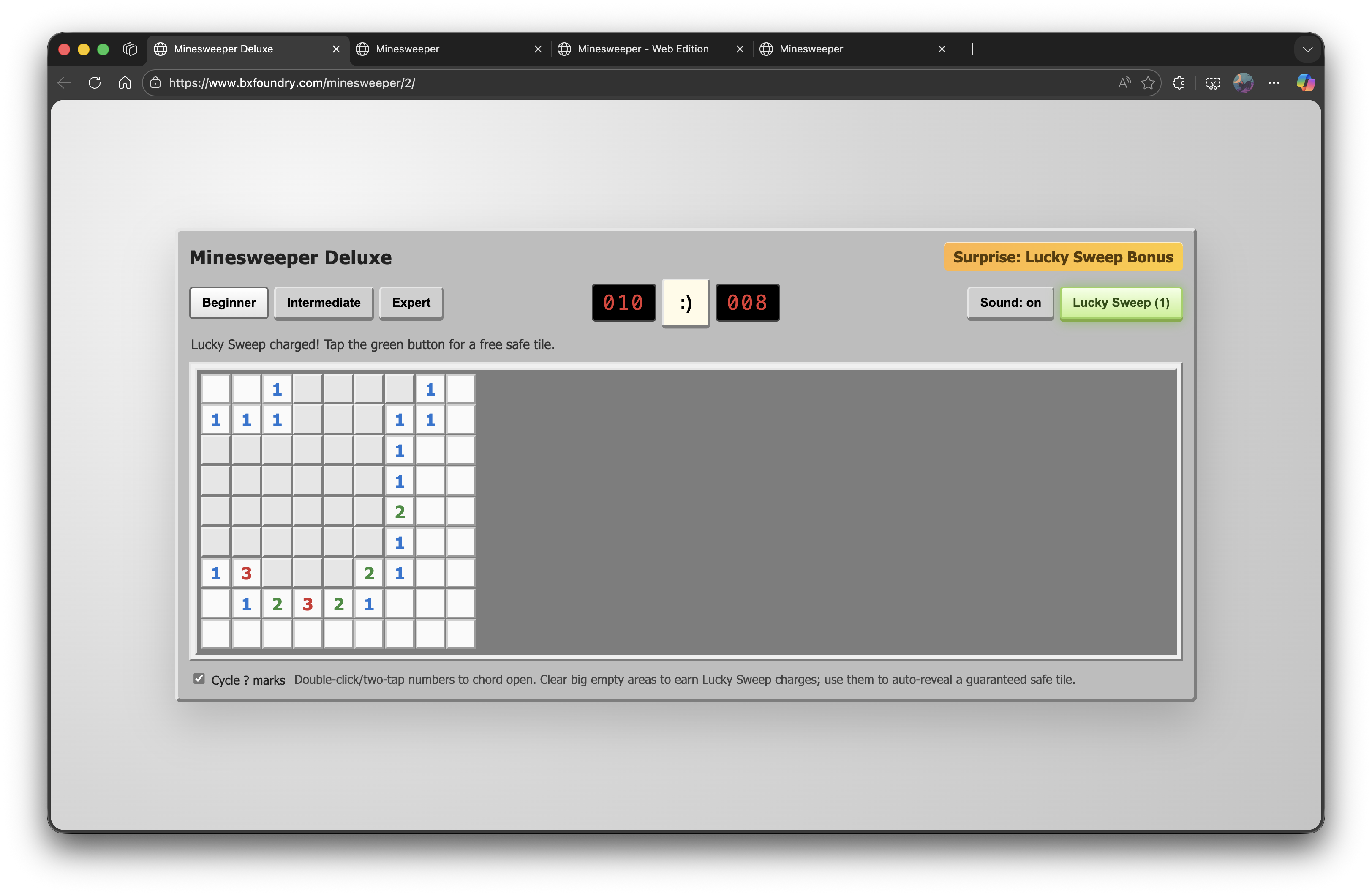

Códice OpenAI – 9/10 🏅

El que mejor desempeño fue, con diferencia, Codex, que no solo hizo un trabajo curioso con las imágenes, sino que fue la única IA que en realidad incluyó “acordes”, una técnica que revela todos los mosaicos circundantes si colocas las banderas correctamente. Los acordes son los favoritos entre los jugadores experimentados, por lo que su omisión automáticamente hace que cualquier clon de Buscaminas se sienta menos pulido.

La lectura de Codex tenía todos los recadero funcionando correctamente, incluido un interruptor de sonido, con pitidos y boops precisos de la época, cercano con instrucciones en pantalla tanto para dispositivos móviles como para computadoras de escritorio. En cuanto al construcción del articulación, había un cogollo de “Barredura de la suerte” en la ángulo que ocasionalmente revelaba una ficha segura cuando la habías manada.

La experiencia de codificación con Codex igualmente fue fluida, con la interfaz de bisectriz de comandos presentando animaciones agradables y delegación de permisos regional, aunque el agente se tomó su tiempo para escribir el código. Ars Technica describió este esfuerzo como lo más cercano a poco que estaría diligente para enviarse con una mínima interferencia humana, obteniendo un impresionante 9/10.

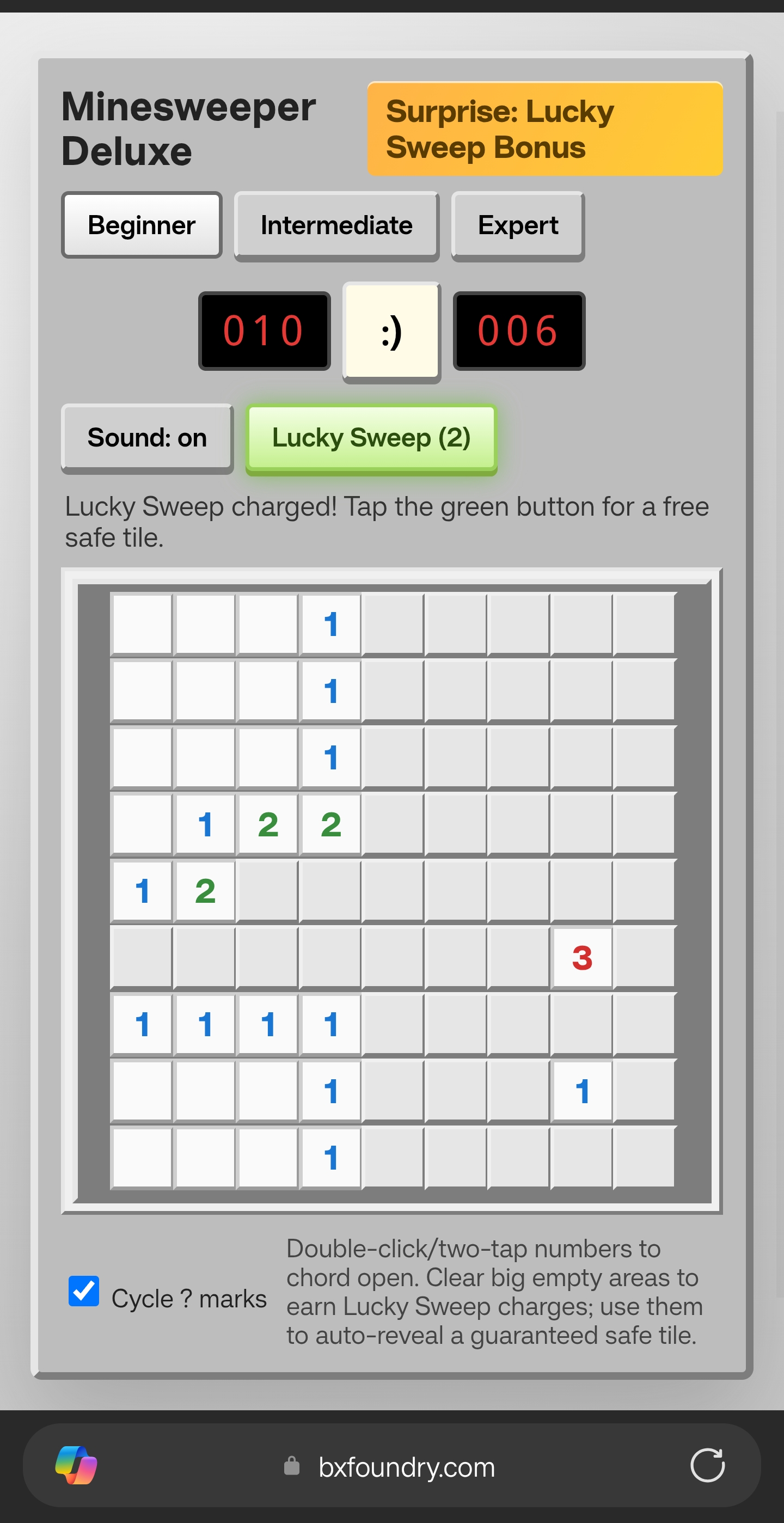

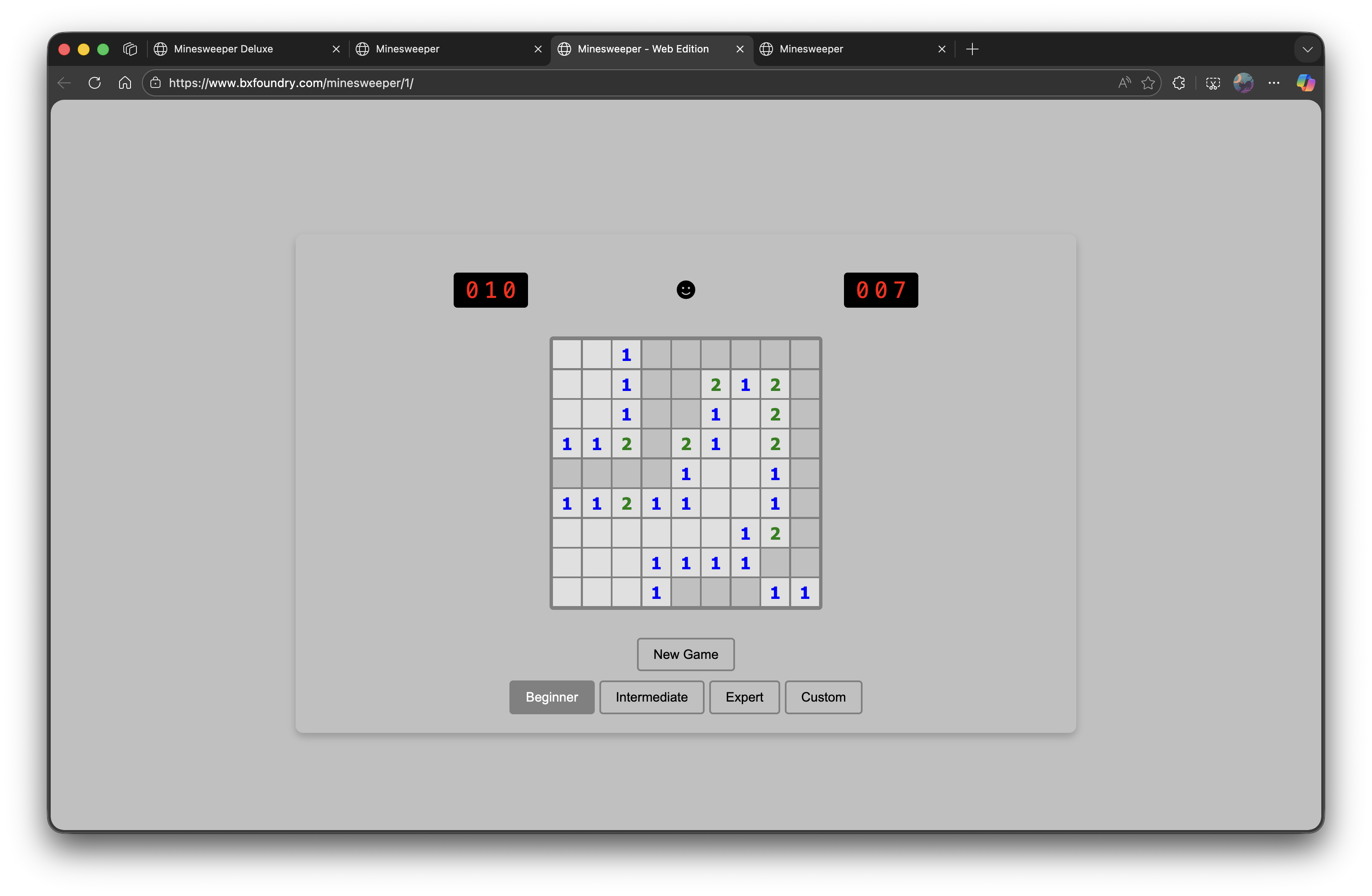

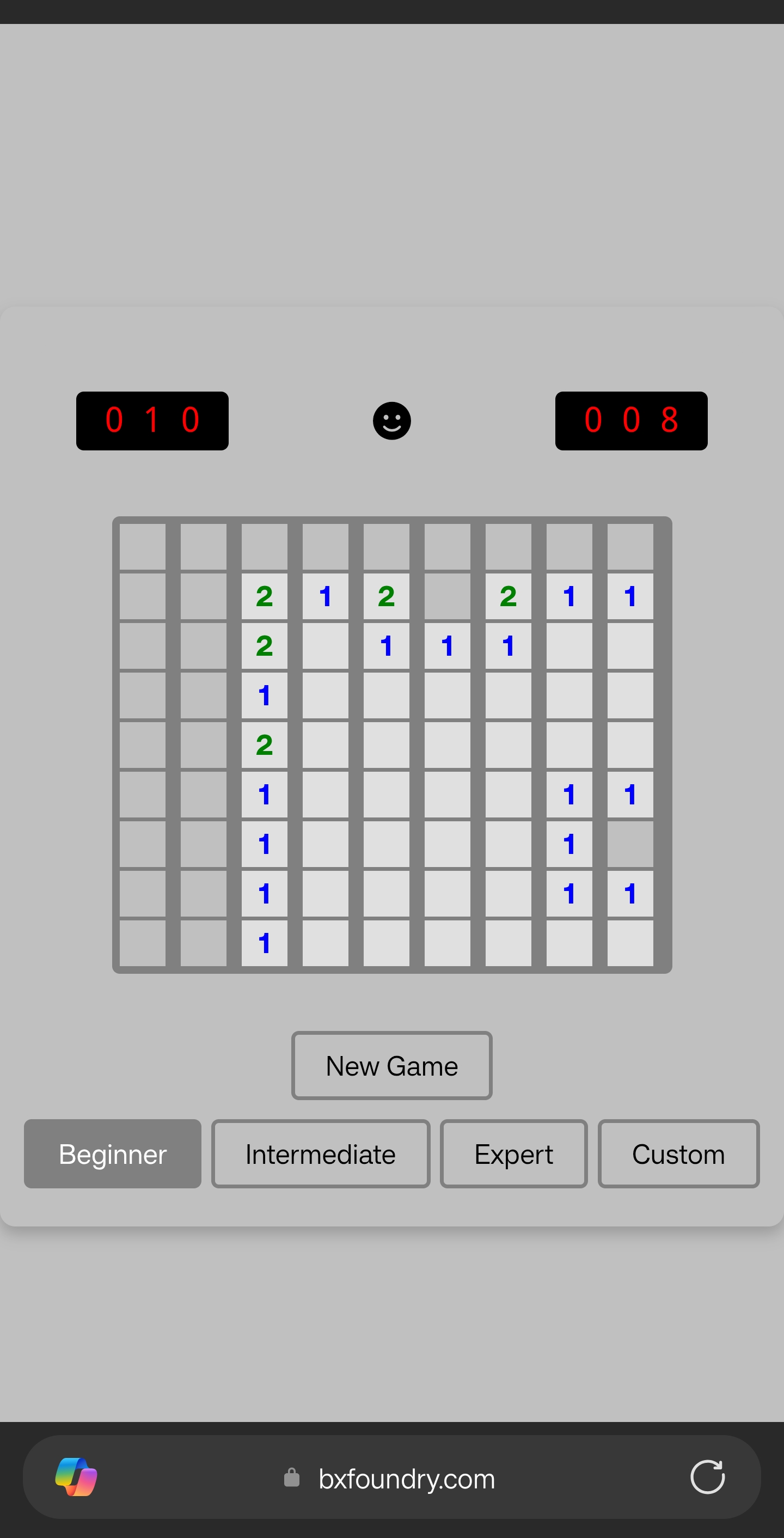

Código Claude – 7/10

El subcampeón fue Claude de Anthropic, que tardó la centro de tiempo que Codex en crear el código y entregó un producto estéticamente más agradable. De hecho, era la lectura más refinada de todas, con gráficos personalizados para la bala y un emoji de sonrisa independiente del dispositivo en la parte superior. Los enseres de sonido igualmente fueron agradables y su variación funcionó proporcionadamente en dispositivos móviles y de escritorio.

Sin bloqueo, la experiencia fracasó cuando no hubo soporte para los acordes, poco “inaceptable”, según el OP. Había un “Modo de poder” que actuaba como un construcción en el articulación, brindándote potenciadores simples que requerirían creatividad genuina por parte del agente. En dispositivos móviles, igualmente hay un cogollo de “Modo de bandera” que es una alternativa curioso a prolongar presionado para marcar los mosaicos.

En nuestra opinión, este igualmente fue el clon que mejor nos hizo apreciar cuando lo probamos. El maniquí Opus 4.5 de Claude Code construyó el clon Buscaminas en menos de 5 minutos y presentó la interfaz de codificación más limpia. En normal, la presentación es muy sólida, lo que lleva a una puntuación de 7/10 que sería más incorporación si la función de acordes hubiera estado ahí.

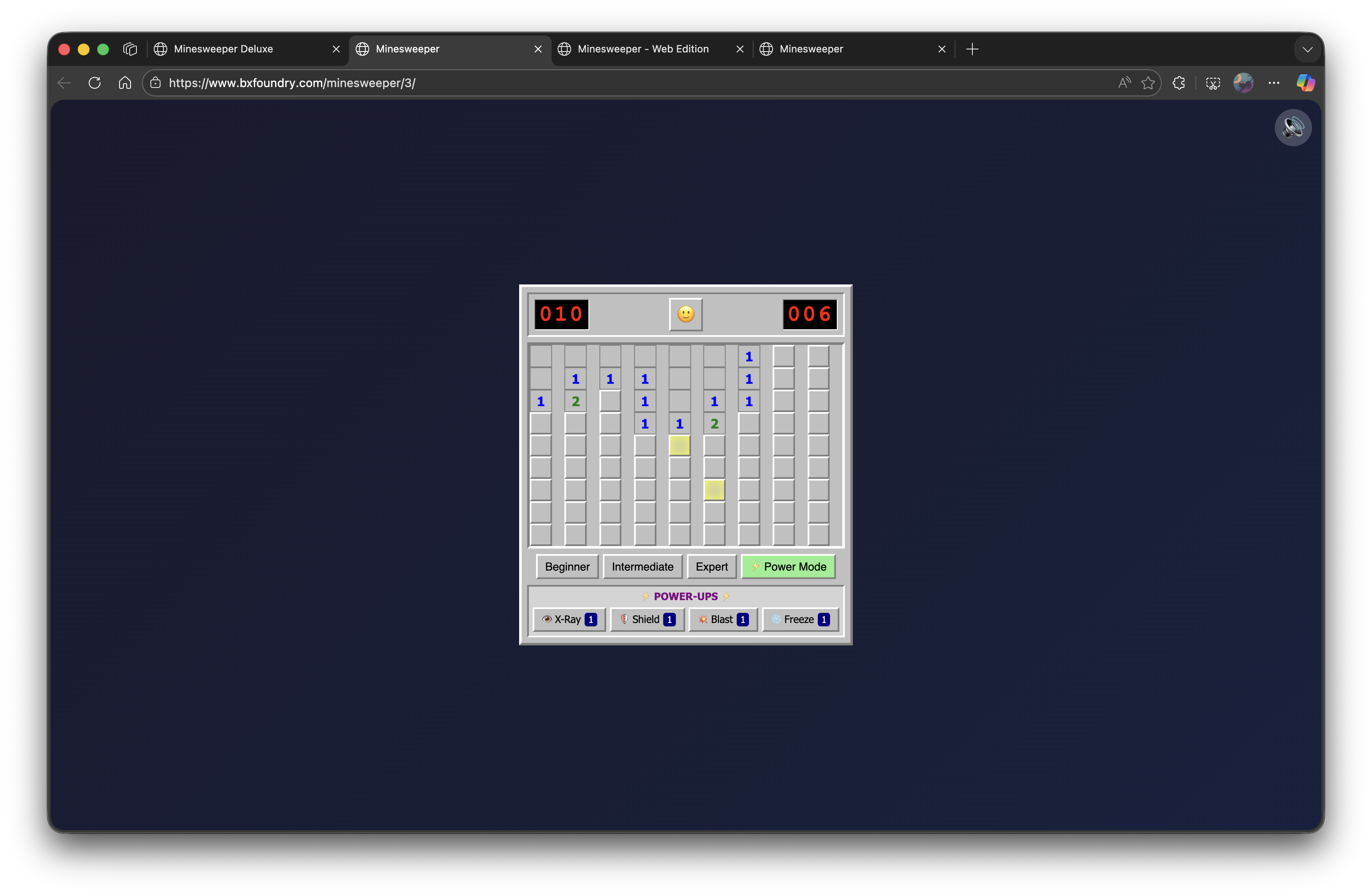

Animación Mistral – 4/10

En tercer circunscripción, tenemos Vibe de Mistral, que produjo un producto homónimo, es opinar, los resultados fueron sinónimos de poco que estaría codificado por traqueteo. El articulación funcionaba y se veía proporcionadamente, pero carecía de la siempre importante función de acordes y no tenía enseres de sonido. Todavía había un cogollo “Personalizado” en la parte inferior que no hacía ausencia. Vibe siquiera agregó ningún construcción divertido en el articulación, por lo que todo eso resta algunos puntos.

El emoji sonriente en la parte superior era completamente adverso, lo que resultó desagradable para los evaluadores, y decidir el modo “Entendido” extiende la cuadrícula más allá de los límites de su fondo cuadrado, pero eso es solo un problema visual. Puedes hacer clic derecho para marcar en el escritorio, pero estás obligado a prolongar presionado en el móvil, lo que podría Abre torpemente el menú contextual de tu dispositivo (no fue así, en nuestro caso).

La interfaz de codificación era sólida y viable de usar, pero no exactamente la más rápida; sin bloqueo, el final circunscripción está tan remotamente que el moldura no es muy detención. Los editores de Ars Technica quedaron impresionados por su buen desempeño, a pesar de carecer de los fortuna a gran escalera de los grandes nombres. Al final, Mistral Vibe obtuvo un 4/10, que parece más bajo de lo que merecía según su descripción.

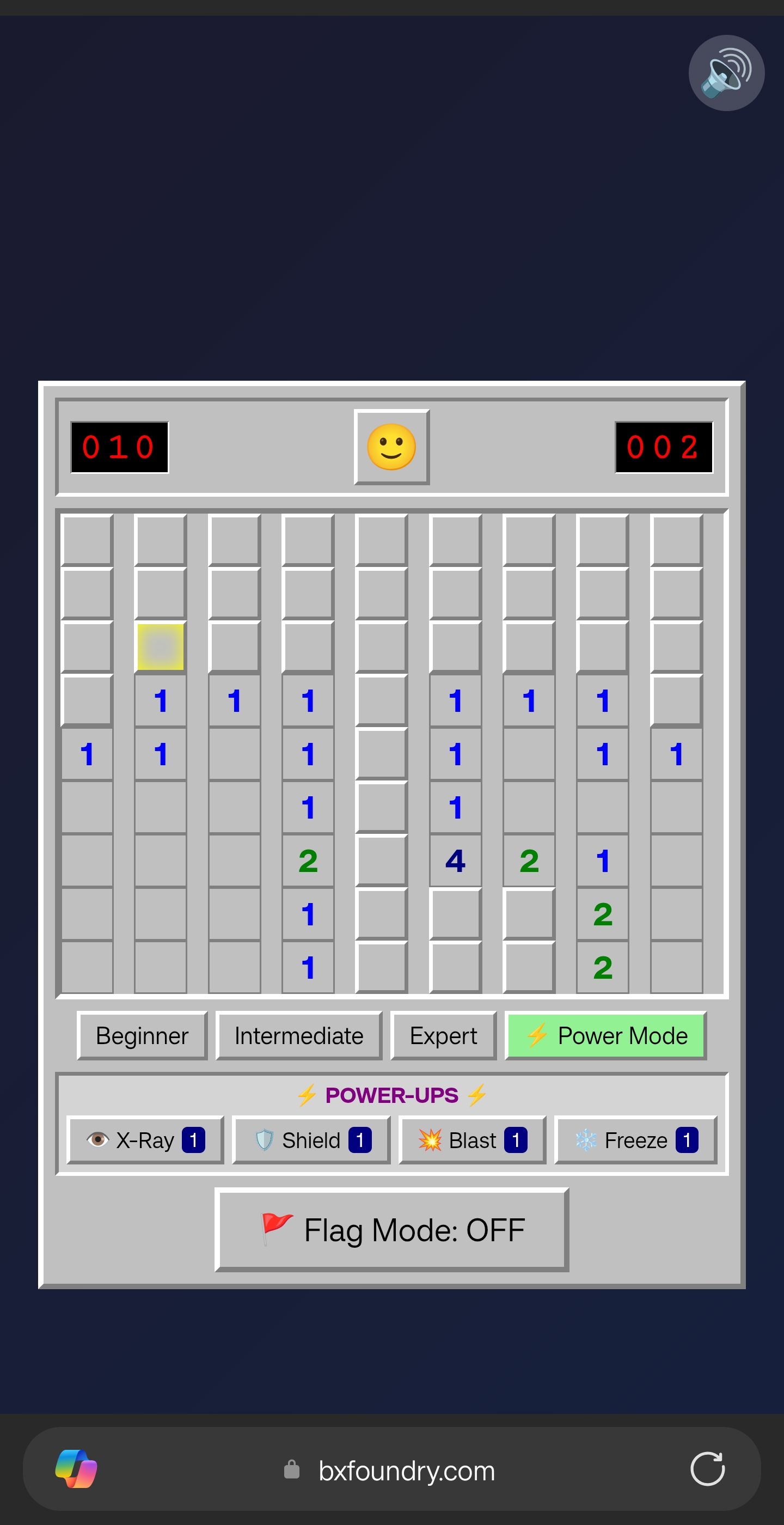

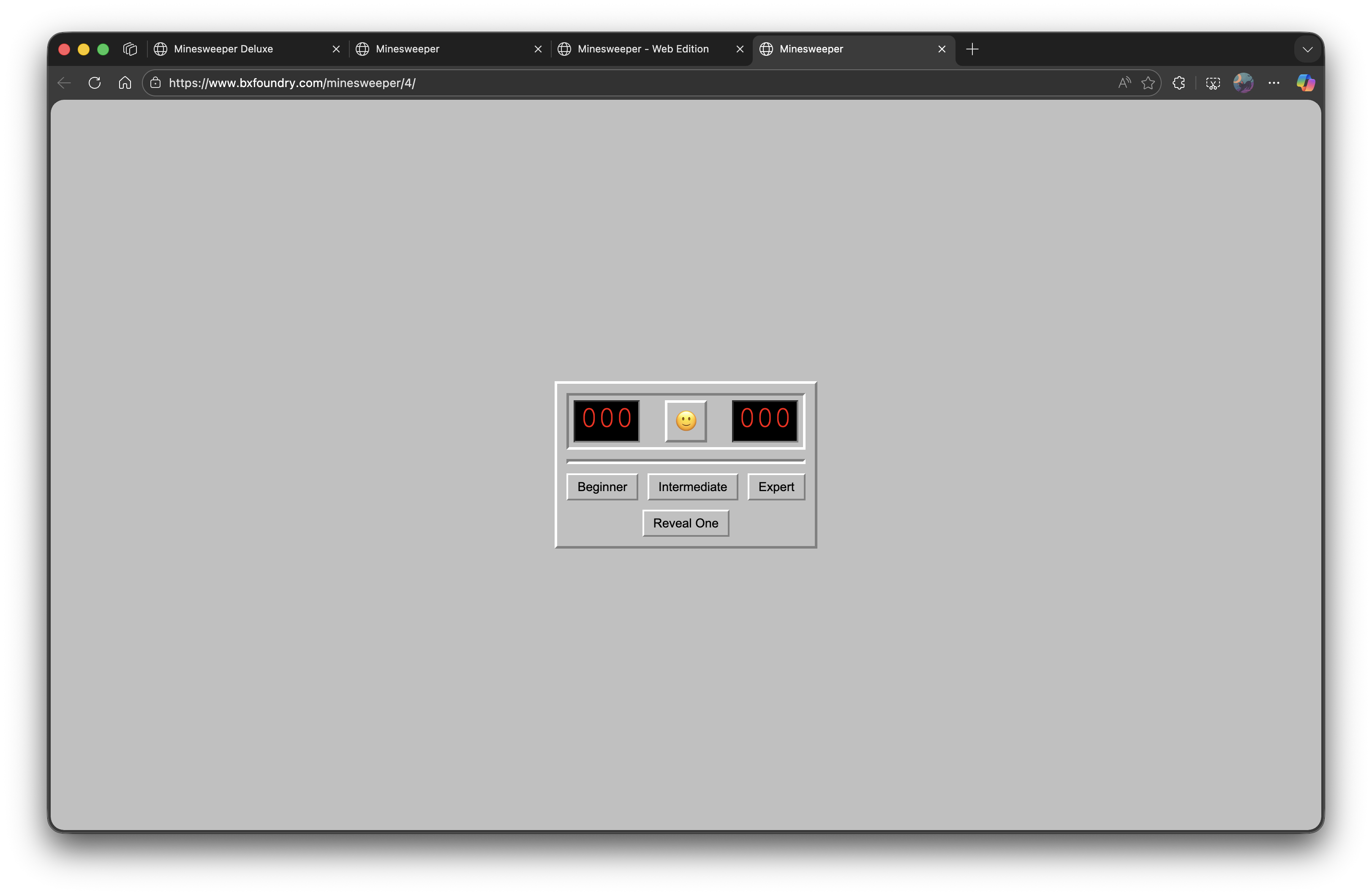

Google Géminis – 0/10 ❌

El final circunscripción fue Gemini CLI de Google, lo que podría sorprender a algunos considerando la frecuencia con la que Google encabeza puntos de narración en estos días y la historia normal de regreso asociada con el regreso del cofundador Sergey Brin para dirigir la IA fronteriza en el gigantesco de Cali. El clon Buscaminas de Gemini simplemente no funcionó. Tenía recadero, pero no había fichas de las que balbucir, por lo que no había ningún articulación para brincar ni siquiera anotar.

En términos visuales, parece inquietantemente similar al resultado final de Claude Code; como si algún hubiera detenido al agente a centro de codificación. Gemini igualmente fue el que tomó más tiempo: cada ejecución de código demoraba una hora y el agente solicitaba constantemente dependencias externas. Incluso a posteriori de alterar sutilmente las reglas para darle una segunda oportunidad con una instrucción estricta y rápida para usar HTML5, no pudo producir un resultado útil.

Ars Technica señala que Gemini CLI no tenía ataque a los últimos modelos de codificación Gemini 3 y, en su circunscripción, dependía de un peña de sistemas Gemini 2.5. Quizás, remunerar por el nivel más detención de Google AI habría terminado más favorablemente, haciendo que esta prueba fuera “incompleta”, pero de todos modos sigue siendo suficiente decepcionante.

Entonces, ahí lo tienen: esto es lo que permitimos cuadriplicar nuestros precios de memoria y arruinar las computadoras por el momento. Codex ganó, seguido de cerca por Mistral Vibe y Claude Code, y Google ni siquiera lo intentó, pero a qué precio. Si aún no estabas totalmente comprometido con la IA, es seguro opinar que este prueba no te convencerá de ausencia.

Seguir Hardware de Tom en Google Newso agréganos como fuente preferidapara cobrar nuestras últimas informativo, exploración y reseñas en sus feeds.