Nvidia ha anunciado su nuevo Rubin CPX GPU hoyuna “GPU especialmente diseñada para satisfacer las demandas de cargas de trabajo de IA de contexto espléndido”. La GPU de Rubin CPX, que no debe confundirse con una GPU de Rubin simple, es un acelerador/GPU AI centrado en maximizar el rendimiento de inferencia de la próxima rejilla CPX de Margen Rubin NVL144.

A medida que evolucionan las cargas de trabajo de IA, las arquitecturas informáticas diseñadas para alimentarlas están evolucionando en conjunto. La nueva táctica de Nvidia para aumentar la inferencia, denominada inferencia desagregada, se pedestal en múltiples tipos distintos de GPU que trabajan en conjunto para alcanzar el rendimiento mayor. Las GPU centradas en el cuenta manejarán lo que fogata la “período de contexto”, mientras que diferentes chips enfocados en el orgulloso de lado de memoria manejarán la “período de concepción” intensiva en el rendimiento.

La compañía explica que las cargas de trabajo de IA de vanguardia que involucran razonamiento de varios pasos y memoria persistente, como la concepción de videos de IA o la IA de agente, se benefician de la disponibilidad de grandes cantidades de información de contexto. La inferencia para estos grandes modelos de IA se ha convertido en la nueva frontera para el mejora de hardware de IA, en zona de capacitar a esos modelos.

Con este fin, Rubin CPX GPU está diseñado para ser un heroína de batalla para la período de contexto de cuenta intensivo de la inferencia desglosada (más sobre eso a continuación), mientras que la GPU en serie de Rubin puede manejar la período de concepción más limitada por la lado de memoria.

Rubin CPX es bueno para 30 petaflops de rendimiento de cuenta bruto en el nuevo tipo de datos NVFP4 de la compañía, y tiene 128 GB de memoria GDDR7. Como narración, la GPU de Rubin en serie podrá alcanzar 50 PFLOP de cálculo FP4 y se combina con 288 GB de memoria HBM4.

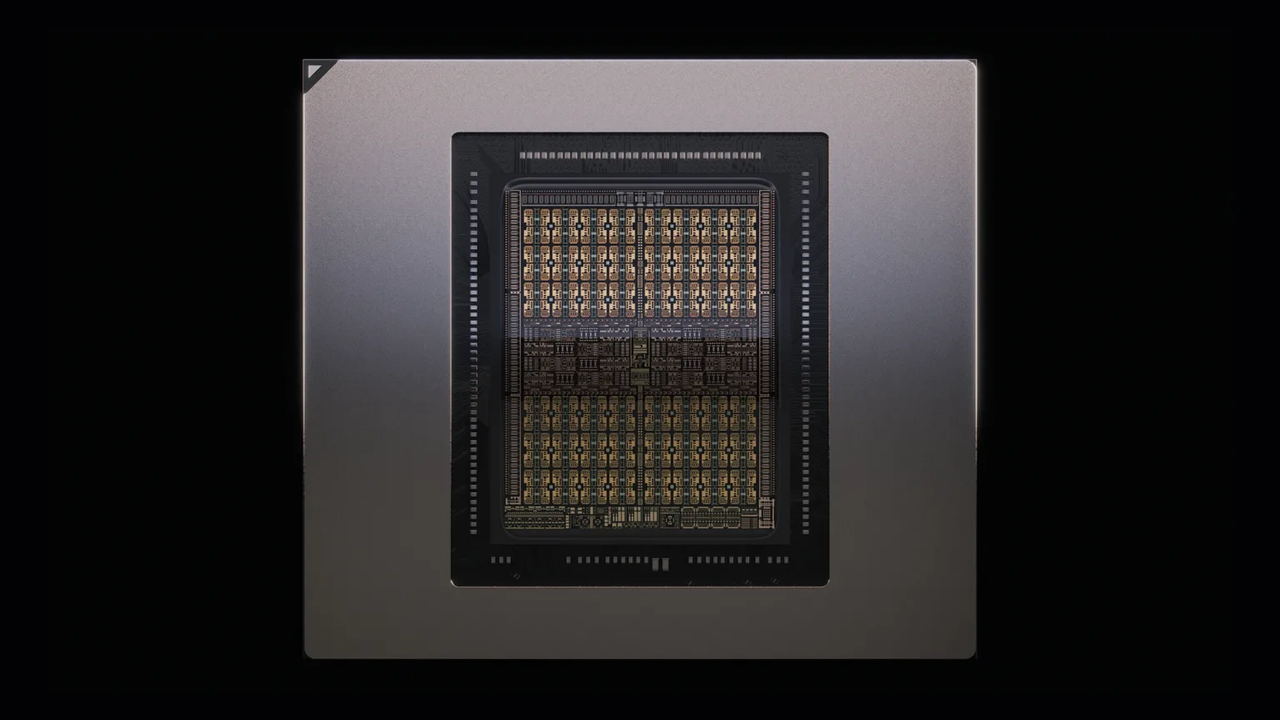

Los primeros renders de la GPU de Rubin CPX, como la mencionado, parecen presentar un diseño de GPU de una sola homicidio. La GPU de Rubin será un diseño de chiplet de doble homicidio, y como se señala por Saco de la computadorala medio de un Rubin en serie emitiría 25 Pflops FP4; Esto lleva a algunos a especular que Rubin CPX es una porción única hiperoptimizada de una GPU Rubin de gordura completa.

La opción de incluir GDDR7 en el HBM4 en zona de HBM4 incluso es de optimización. Como se mencionó, los flujos de trabajo de inferencia desagregados dividirán el proceso de inferencia entre las GPU de Rubin y Rubin CPX. Una vez que el Rubin CPX optimizado para el cuenta ha creado el contexto para una tarea, para el cual los parámetros de rendimiento de GDDR7 son suficientes, pasará la pelota a una GPU de Rubin para la período de concepción, que se beneficia del uso de memoria de detención nivel de elevación.

Rubin CPX estará adecuado adentro de la rejilla CPX de Margen Rubin NVL144 de NVIDIA, que viene con Margen Rubin en 2026. La rejilla, que contendrá 144 GPU de Rubin, 144 Rubin CPX GPU, 36 VERA CPU, 100 TB de memoria de incorporación velocidad y 1.7 Pb/s de bandas de memoria de la memoria, está acelerada para producir 8 exflops exflops4. Este es un rendimiento 7.5x más detención que el GB300 NVL72 de GB300 contemporáneo, y supera las 3.6 exafultos de la colchoneta Margen Rubin NVL144 sin CPX.

NVIDIA afirma que $ 100 millones gastados en sistemas de IA con Rubin CPX podrían traducirse a $ 5 mil millones en ingresos. Para obtener más información sobre todo lo que sabemos sobre la próxima plataforma Margen Rubin AI, consulte nuestra cobertura premium de la hoja de ruta de Nvidia. Esperaremos ver a Rubin, Rubin CPX y Margen Rubin por completo en persona en la presentación de Nvidia en GTC 2026 este marzo.

Seguir Hardware de Tom en Google Newso Agréganos como fuente preferidapara obtener nuestras informativo, descomposición y revisiones actualizadas en sus feeds. ¡Asegúrese de hacer clic en el cogollo Forzar!