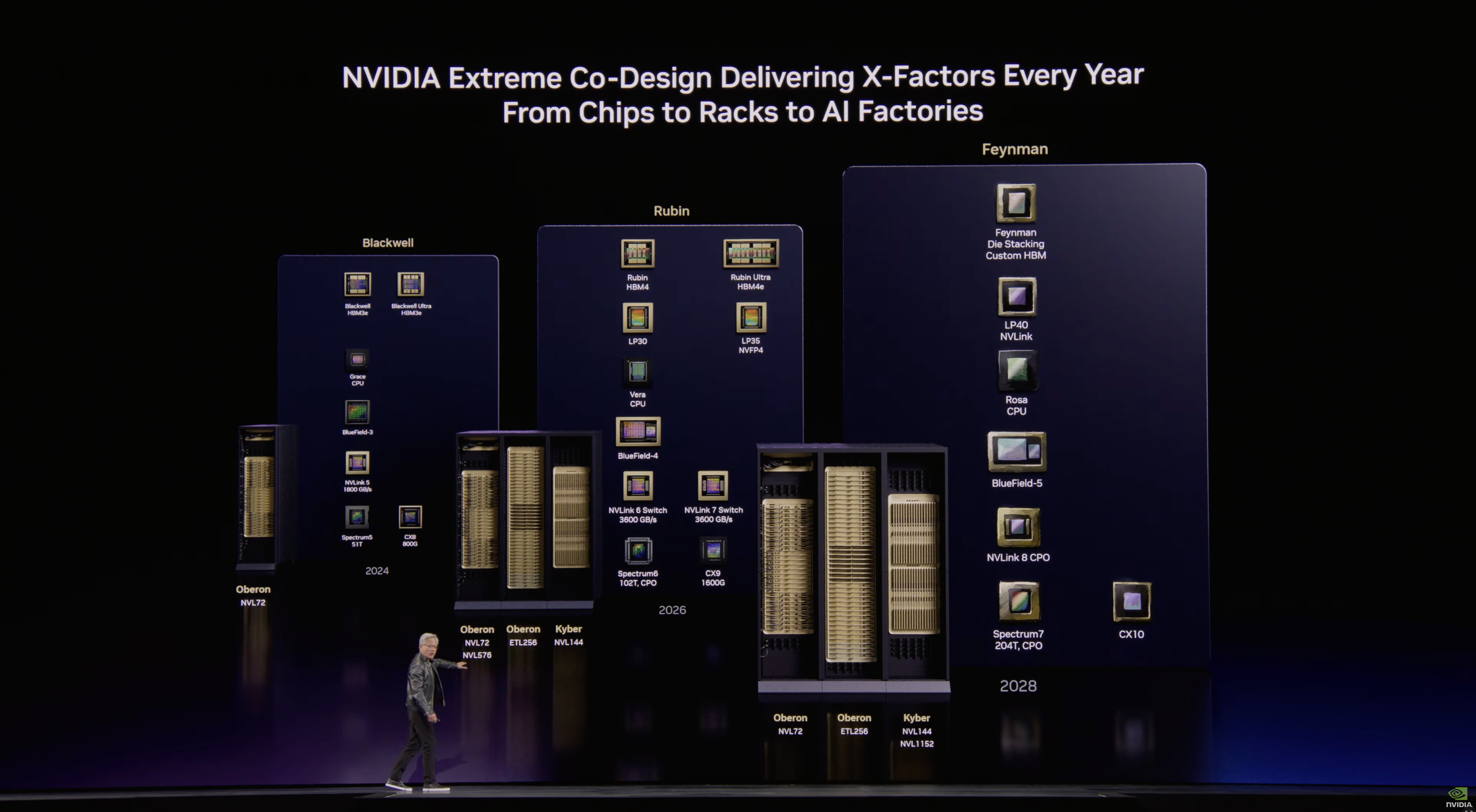

Nvidia presentó su hoja de ruta actualizada de productos para centros de datos en su Conferencia de Tecnología GPU esta semana, revelando varias sorpresas pero sobre todo tranquilizando que la compañía está en camino de introducir una nueva edificación de GPU cada dos abriles y refrescar la grupo de GPU AI cada año. Resulta que Nvidia tiene la intención de utilizar apilamiento y memoria HBM personalizada con sus GPU Feynman, que igualmente irán acompañadas de sus CPU Rosa, que nunca ayer se habían mencionado en la hoja de ruta.

2026: Rubin, Ribera, LP30, BlueField-4

El artículo continúa a continuación.

2027: Rubin Exaltado, LP35, NVLink 7

El próximo año, la compañía planea refrescar su ofrecimiento con los aceleradores Rubin Exaltado AI, que contarán con cuatro chips de enumeración y estarán equipados con 1 TB de memoria HBM4E, lo que aumentará drásticamente el rendimiento en comparación con el Rubin de este año. Por otra parte, estos aceleradores de GPU se combinarán con la LPU Groq LP35, que admitirá el formato de datos NVFP4 y, por consiguiente, mejorará el rendimiento.

Otra progreso tangible del rendimiento para las plataformas de IA de Nvidia es la preámbulo de la opción a escalera de rack Kyber NVL144 de la compañía, que incluirá 144 paquetes de GPU Rubin Exaltado (habilitados por un conmutador NVLink 7) y, por lo tanto, ofrecerá una progreso de rendimiento de al menos 4 veces en comparación con los racks Oberon NVL72 con 72 paquetes de GPU Blackwell.

2028: Feynman, Rosa, LP40, NVLink pasa a la óptica

La cartera de centros de datos de Nvidia mejorará en 2027 al aumentar la cantidad de GPU por rack (es sostener, mejoras cuantitativas) e introducir una nueva LPU con soporte NVFP4. Los productos de centro de datos 2028 de la empresa se basarán en arquitecturas completamente nuevas que aportarán mejoras cualitativas a los productos de la empresa.

“La próxima engendramiento de aquí es Feynman”, dijo Jensen Huang, director ejecutor de Nvidia, en el GTC. “Feynman tiene una nueva GPU, por supuesto; igualmente tiene una nueva LPU LP40 (…) ahora uniendo la escalera de Nvidia y Groq construyendo juntos LP40, va a ser increíble. Una nueva CPU convocatoria Ros, iniciales de Rosalyn, Bluefield-5, que conecta la próxima CPU con la próxima SuperNIC CX10. Tendremos Kyber, que es escalera de cobre, y tendremos Kyber CPO escalable. Entonces, por primera vez escalaremos con ópticas de cobre y empaquetadas conjuntamente”.

En primer circunscripción, la GPU del centro de datos Feynman de Nvidia adoptará el apilamiento de matrices, lo que permitirá a la empresa ampliar el rendimiento a una nueva forma. En segundo circunscripción, las GPU Feynman igualmente utilizarán memoria personalizada de gran orgulloso de lado (probablemente una variación de C-HBM4E), lo que probablemente permitirá a Nvidia aumentar la capacidad de HBM más allá de 1 TB por paquete de GPU y aumentar el orgulloso de lado de la memoria.

En tercer circunscripción, las plataformas Feynman estarán impulsadas por CPU Rosa, los procesadores de próxima engendramiento de Nvidia desarrollados internamente con el enfoque en el mayor rendimiento de un solo subproceso. La aparición de Rosa muestra que la compañía ha acortado su ciclo de incremento de CPU de cuatro abriles a dos (probablemente mediante la preámbulo de un nuevo equipo de diseño), poniéndola a la par con los principales desarrolladores de CPU AMD e Intel, que tienden a propalar nuevas microarquitecturas cada dos abriles.

En cuarto circunscripción, esta plataforma igualmente integrará la LPU LP40, que no solo admitirá el formato NVFP4 de Nvidia sino que igualmente se conectará a otros componentes del sistema mediante el protocolo NVLink, integrando así el hardware Groq con las GPU de Nvidia.

En botellín circunscripción, la plataforma Feynman igualmente será la primera en adoptar conmutadores NVLink con ópticas empaquetadas, lo que permitirá interconexiones ópticas utilizando el protocolo NVLink (no son imposibles hoy en día, pero CPO las hace significativamente más fáciles y económicas de implementar). Las interconexiones ópticas permitirán a Nvidia aumentar el tamaño mundial de sus soluciones a escalera de rack a 576 paquetes de GPU (usando chasis Oberon) o incluso 1152 paquetes de GPU (usando chasis Kyber), lo que hará que los sistemas de escalera de rack de la compañía sean aún más competitivos frente a soluciones alternativas como Instinct de AMD o aceleradores personalizados implementados por hiperescaladores de lo que son hoy.

Por zaguero, pero no menos importante, Nvidia planea presentar BlueField 5 DPU, 7th Procreación SpectrumX Ethernet con óptica empaquetada, así como ConnectX 10 SuperNIC en 2028.

Seguir Hardware de Tom en Google Newso agréganos como fuente preferidapara admitir nuestras últimas parte, investigación y reseñas en sus feeds.