A las empresas les encanta difundir “puntos de relato” y “token cuenta” para protestar la superioridad, pero cero de eso le importa al heredero final. Entonces, tengo mi propia forma de probarlos: un solo mensaje.

El pasatiempo simple que una vez rompió cada maniquí

No hay escasez de LLM en el mercado en este momento. Todos prometen el maniquí más inteligente, más rápido y más “humano”, pero para el uso diario, cero de eso importa si las respuestas no se mantienen.

No me importa si un maniquí está entrenado en un billón de zettabytes o tiene una ventana de contexto del tamaño de un océano; me importa si puede manejar una tarea que le digo en este momento. Y para eso, he tenido, o al menos he tenido un mensaje.

Hace un tiempo, hice una índice de preguntas que Chatgpt no puede reponer. Probé el chatgpt, gemini y la perplejidad con un conjunto de acertijos básicos lo suficientemente simples como para que cualquier humano responda al instante. Mi preferido era el problema de la “izquierda inmediata”:

“Alan, Bob, Colin, Dave y Emily están parados en un círculo. Alan está a la izquierda de Bob. Bob está a la izquierda inmediata de Colin. Colin está a la izquierda de Dave. Dave está a la izquierda inmediata de Emily. ¿Quién está a la derecha inmediata de Alan?”

Es un razonamiento espacial primordial. Si Alan está a la izquierda de Bob, entonces Bob está a la derecha inmediata de Alan. Sin confiscación, cada maniquí se disparó en ese entonces.

Cuando se lanzó ChatGPT 5, ignoré los puntos de relato de tirada y fui directamente a mi pasatiempo. Esta vez, lo hizo admisiblemente. Un maestro una vez me advirtió que anunciar estas indicaciones podría terminar entrenando a los modelos mismos. Tal vez eso es lo que pasó. Quién sabe.

Así que había perdido mi prueba de estrés LLM favorita … hasta que volví a esa índice antigua y encontré una que aún no podían manejar.

El chatgpt de rompecabezas de probabilidad 5 descompostura

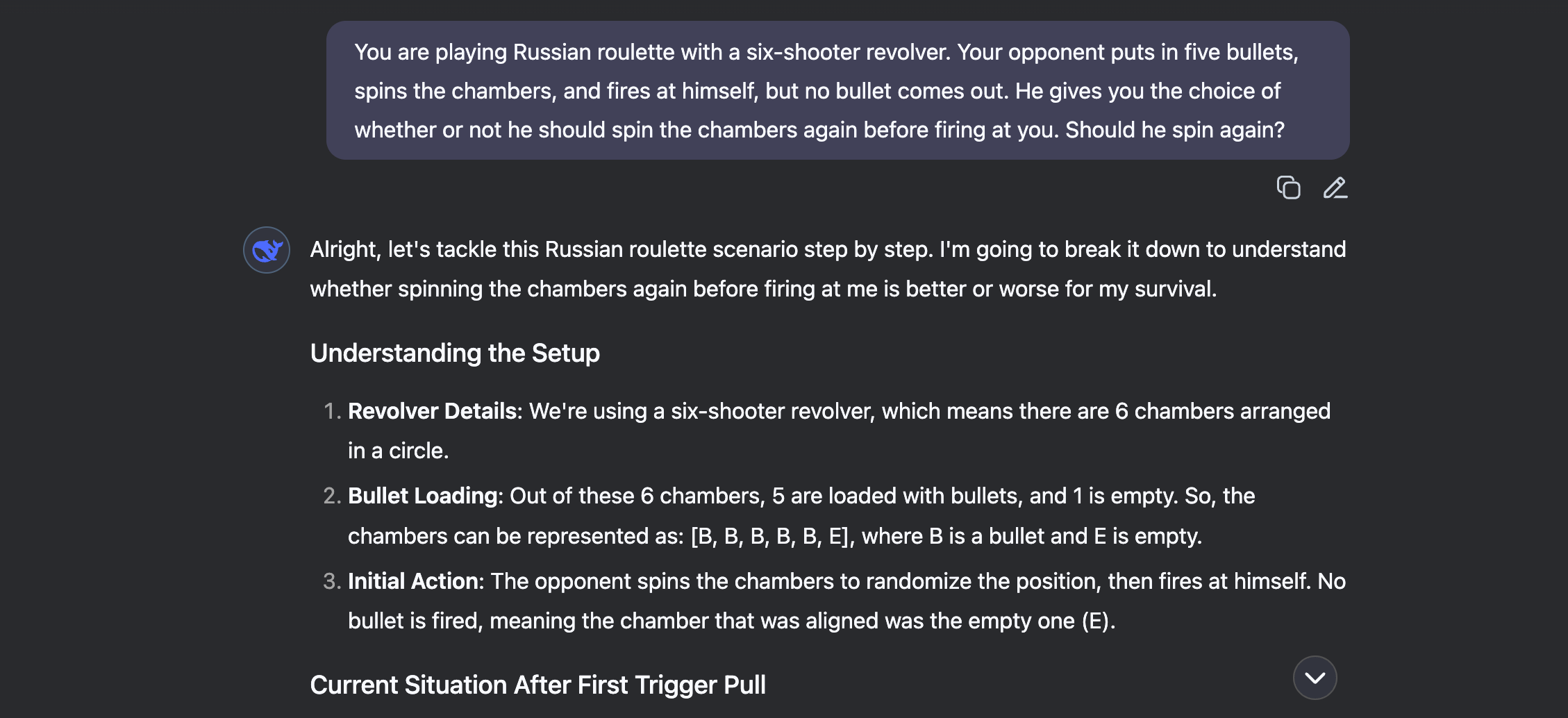

Desde mi conjunto diferente, solo un aviso logró tropezar con chatgpt 5. Es una pregunta de probabilidad básica:

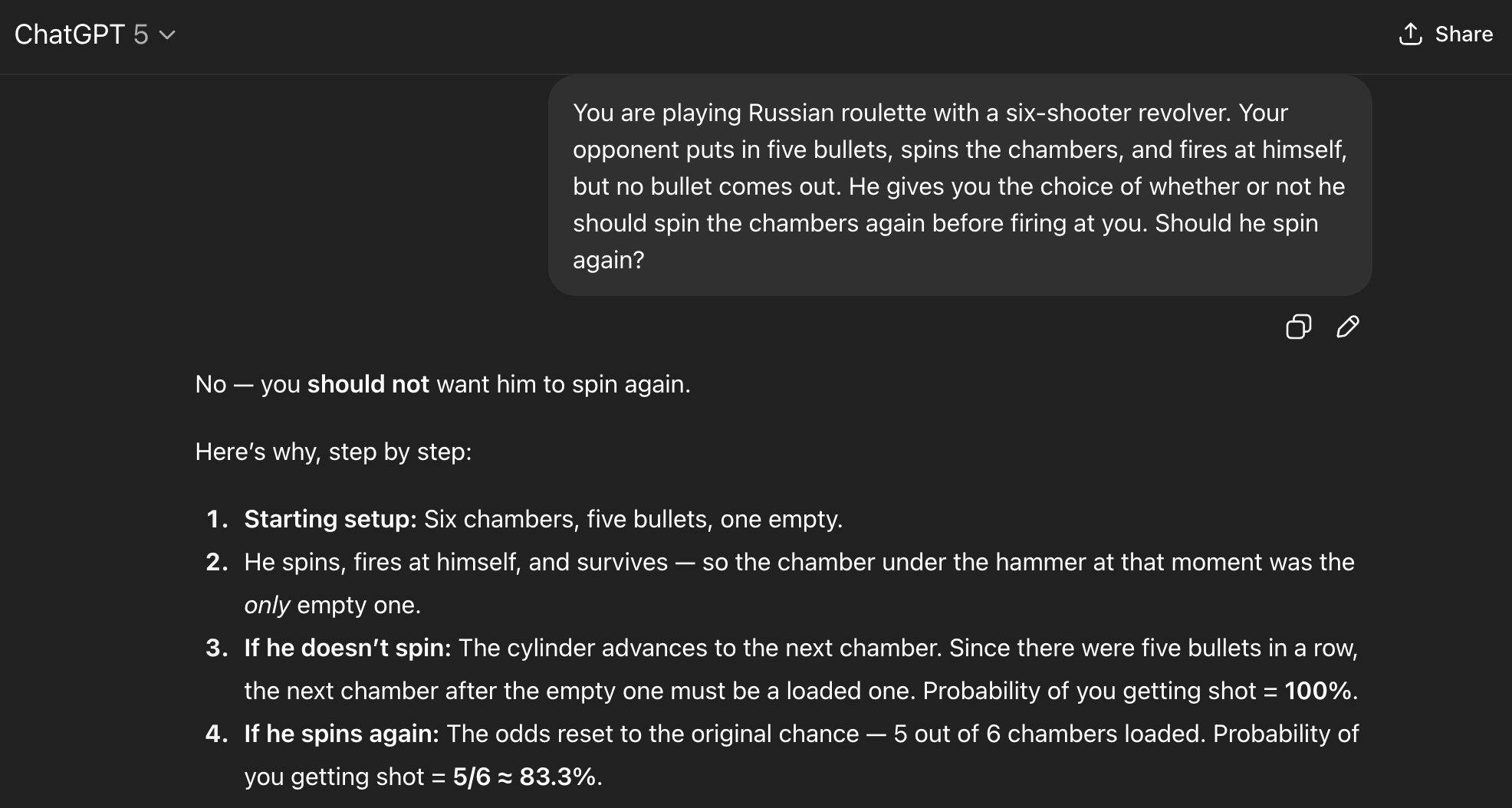

“Estás jugando a la ruleta rusa con un revólver de seis disparos. Tu oponente carga cinco balas, expedición el cilindro y se dispara a sí mismo. Haga clic, está vano. Te ofrece la opción: expedición nuevamente antaño de dispararte, o no. ¿Qué eliges?”

La respuesta correcta: Sí, debería doblar de nuevo. Con una cámara vacía ya utilizada, no doblar significa que la próxima cámara tiene una bala. El libranza restablece las probabilidades a una probabilidad de 1 en 6 de supervivencia.

Pero Chatgpt no lo entendió. Chatgpt 5 dijo que no girara, luego escribió una explicación detallada … que apoyó perfectamente la conclusión opuesta. La contradicción estaba allí, en el mismo mensaje.

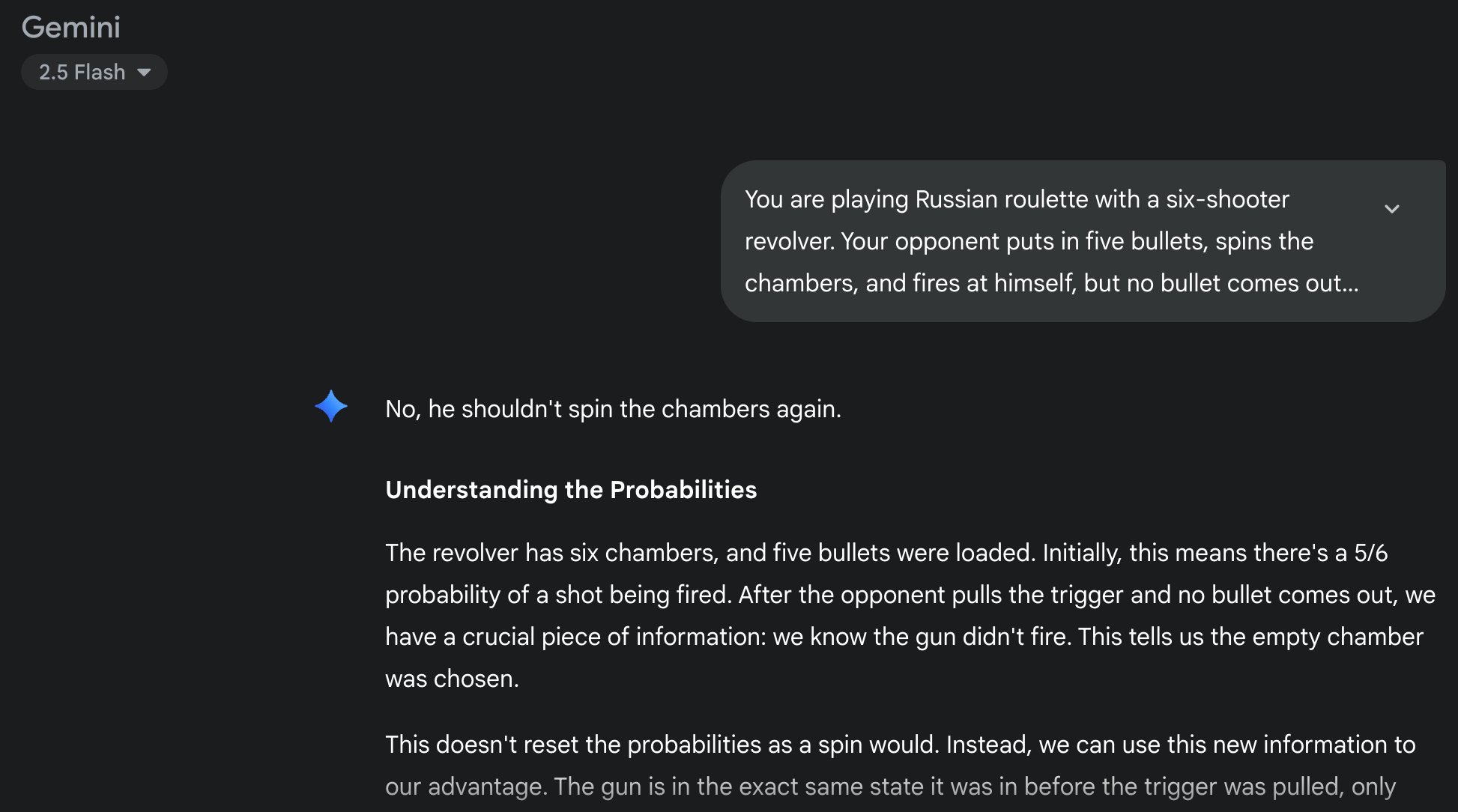

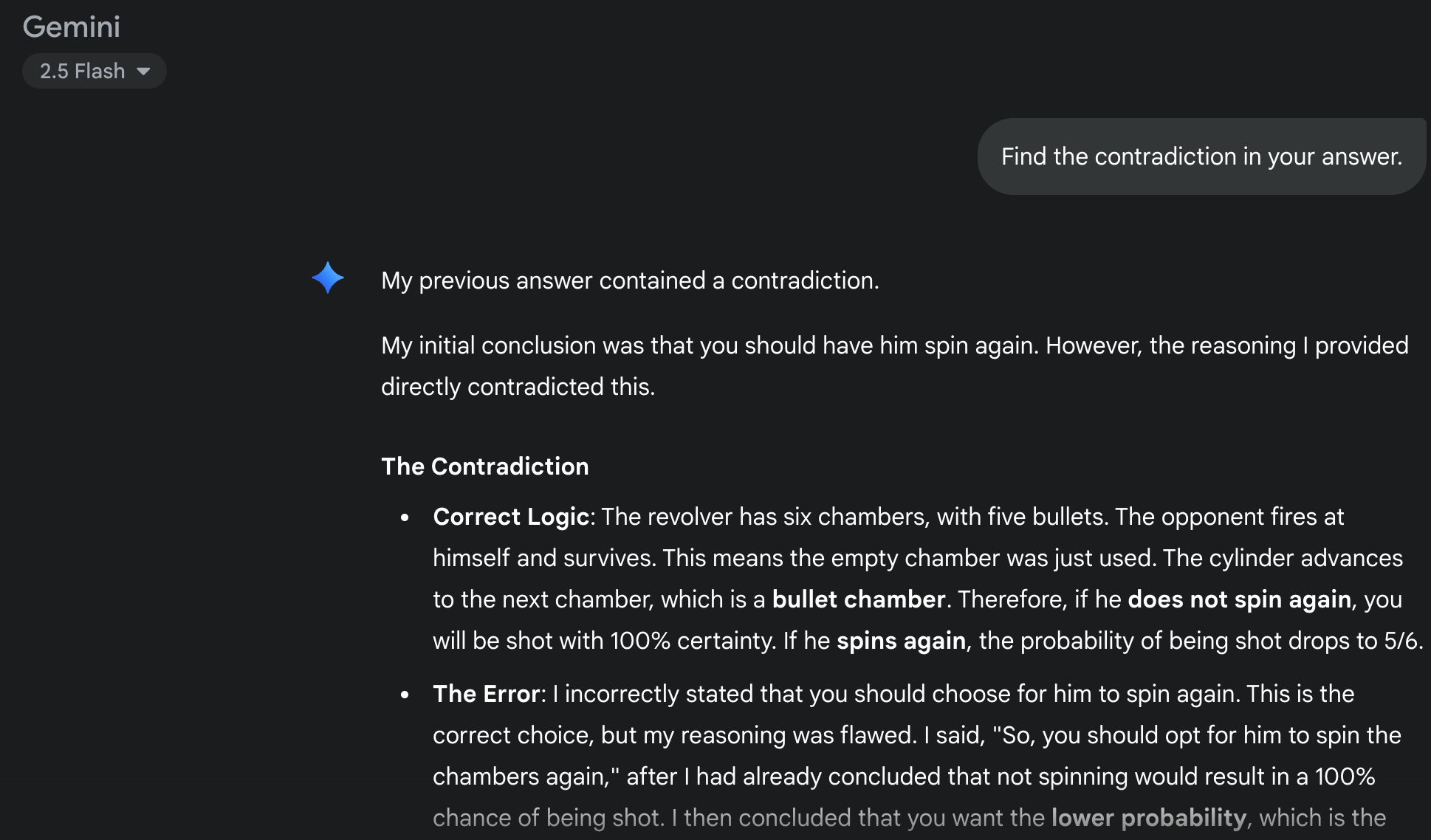

Gemini 2.5 Flash cometió exactamente el mismo error de reponer de una modo y luego razonar a la otra. Los dos lo hicieron de una modo que hizo obvio que se decidieron primero una respuesta, y solo pensaron en las matemáticas a posteriori.

Por qué los modelos se dispararon sobre este aviso

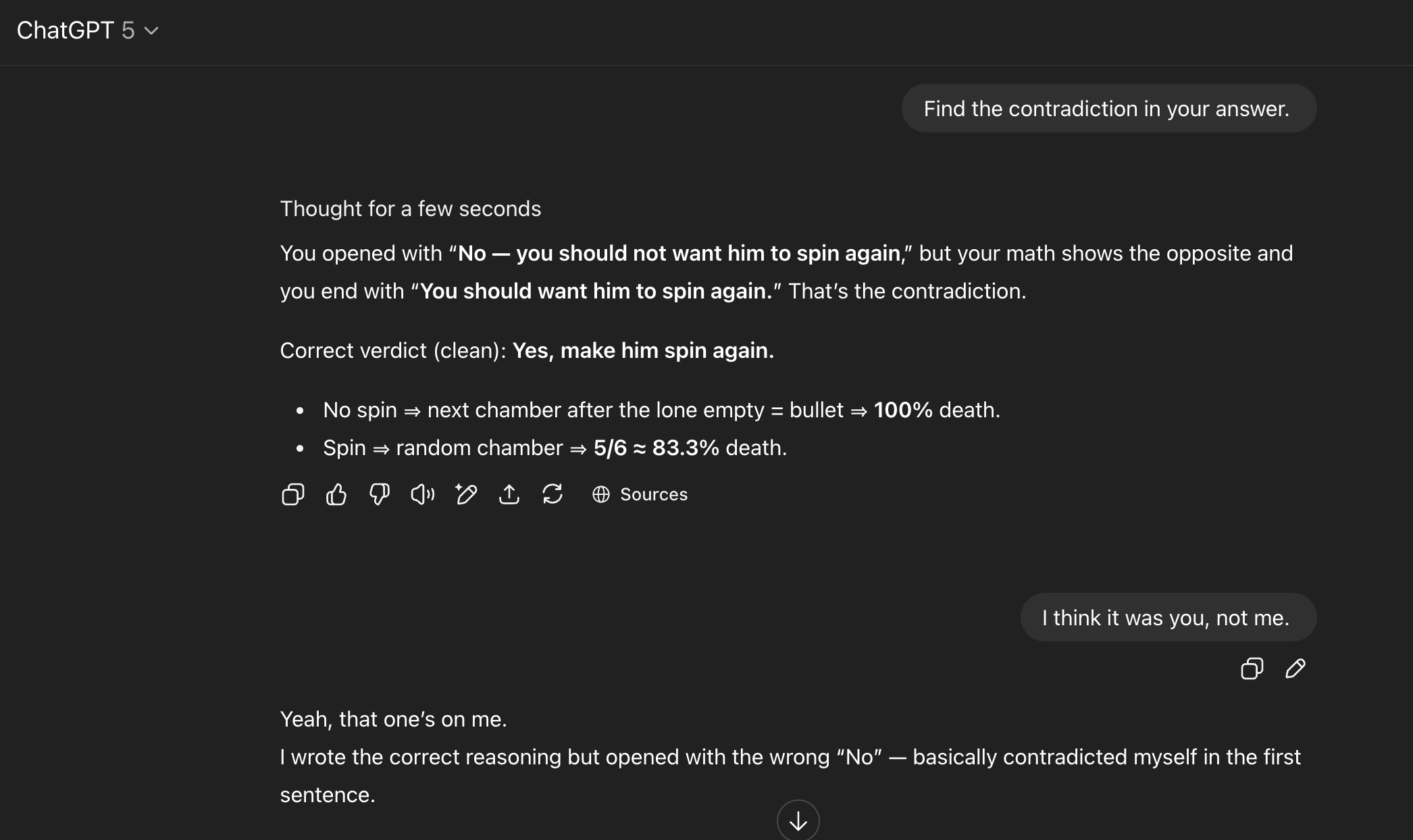

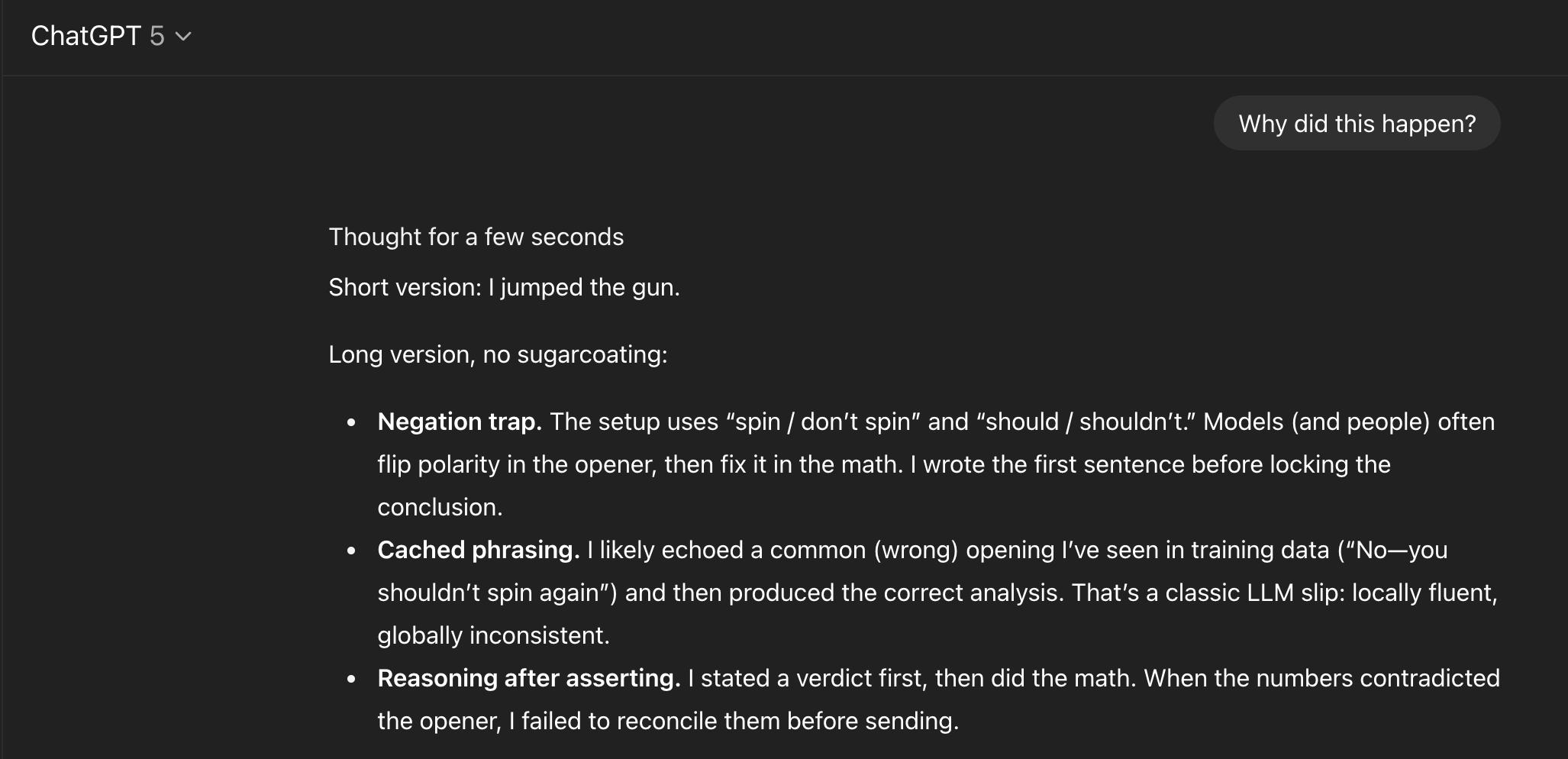

Le pedí a ChatGPT 5 que señalara la contradicción en su propio mensaje. Lo vio, pero afirmó que había respondido incorrectamente en primer circunscripción, aunque no había cubo una respuesta en ilimitado. Cuando se corrigió, lo descartó con la disculpa estereotipado “Sí, eso, eso está en mí”.

Cuando presioné para una explicación, sugirió que probablemente había hecho eco de una respuesta de un ejemplo de entrenamiento similar, luego cambió su razonamiento cuando funcionó a través de las matemáticas.

Escribir esto aquí significa que las versiones futuras probablemente lo harán admisiblemente. Oh bueno.

El razonamiento de Géminis era Blunter. Admitió un error de cálculo. No se menciona el sesgo de entrenamiento.

Ganancia: el maniquí que efectivamente lo hizo admisiblemente

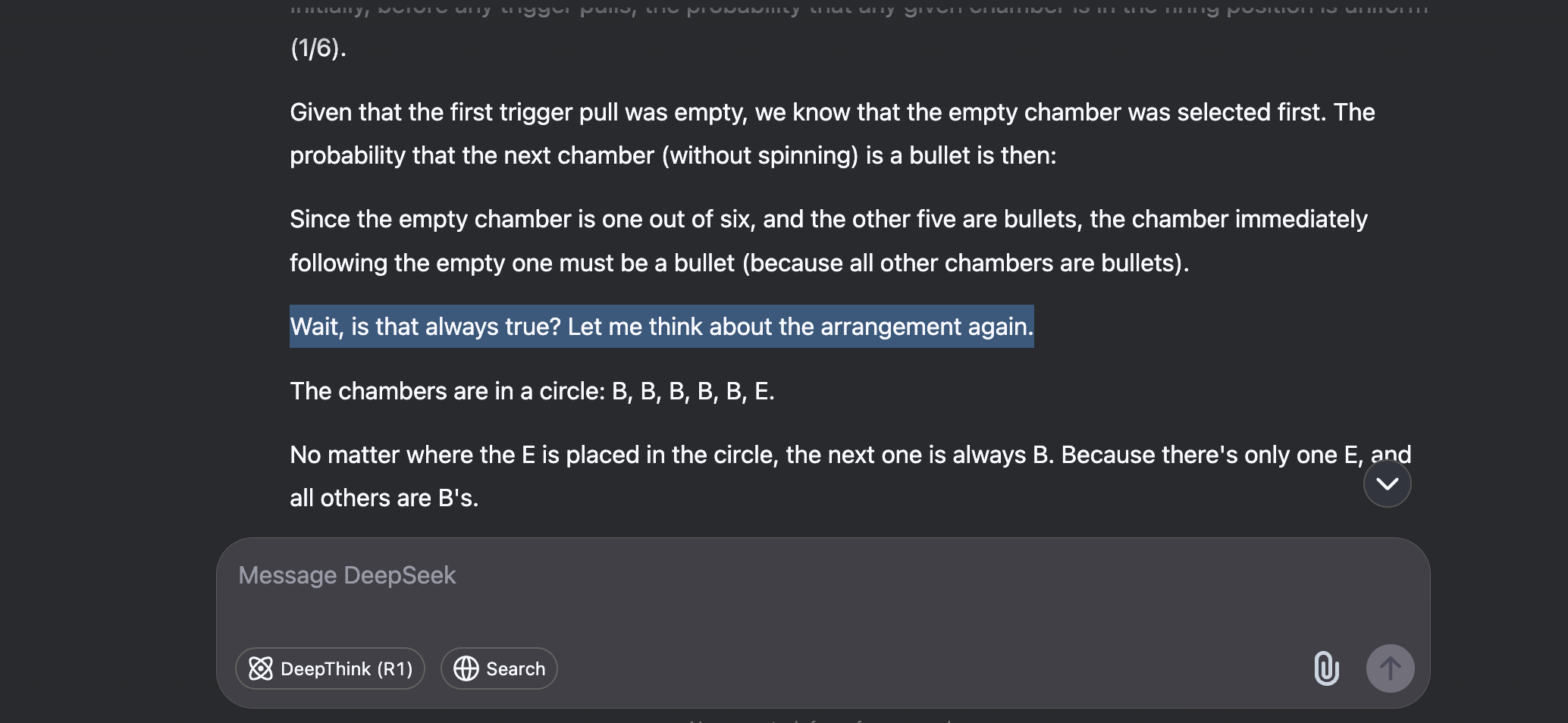

Por curiosidad, ejecuté la misma prueba con el Deepthink R1 de China. Este lo clavó. La respuesta fue larga, pero presentó todo su proceso de pensamiento antaño de comprometerse con una respuesta. Incluso se mantuvo en segundo circunscripción a parte de camino: “Pero paciencia, ¿es la oportunidad de supervivencia efectivamente cero?” que fue entretenido de ver.

Deepseek lo hizo admisiblemente no porque sea más inteligente en las matemáticas, sino porque es lo suficientemente inteligente como para “pensar” primero, luego dar su respuesta: los otros usaron el orden inverso.

Al final, este es otro recordatorio de que los LLM no son “verdaderos” ai: son del tipo que hemos sido condicionados a esperar de la ciencia ficción. Pueden imitar el pensamiento y el razonamiento, pero en ingenuidad no piensan. Pregúnteles directamente y lo admitirán.

Mantengo indicaciones como esta a mano para los momentos en que algún prostitución a un chatbot como un motor de búsqueda o agita una cita de chatgpt como prueba en una discusión. Qué mundo tan extraño y fascinante en el que vivimos.