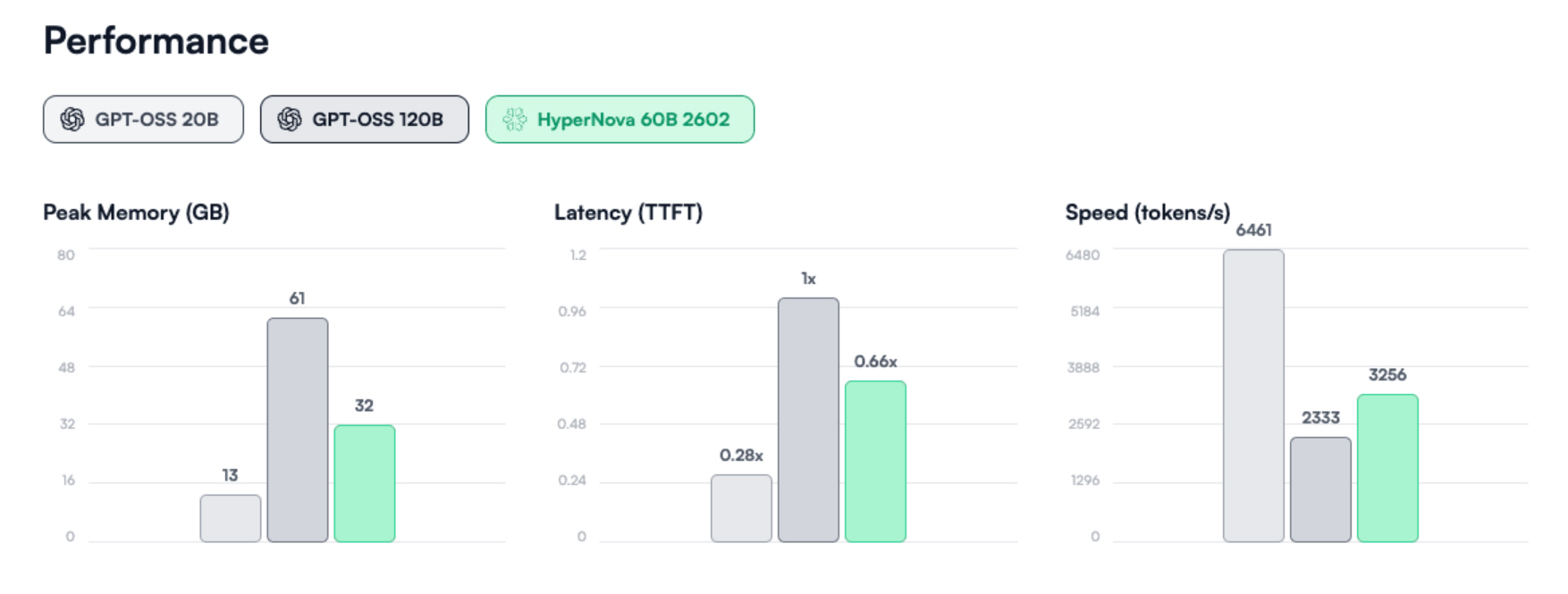

La empresa española de inteligencia fabricado Multiverse Computing lanzó HyperNova 60B 2602, una traducción comprimida de gpt-oss-120B de OpenAI, y la publicó de forma gratuita en abrazando la cara.

La nueva traducción reduce las micción de memoria del maniquí innovador de 61 GB a 32 GB, y Multiverse dice que conserva un rendimiento de citación de herramientas casi paridad a pesar de la reducción del tamaño del 50 %.

En teoría, esto significa que un maniquí que alguna vez requirió una infraestructura pesada puede funcionar con mucho menos hardware. Para los desarrolladores con presupuestos más ajustados o limitaciones energéticas, esa es una delantera potencialmente enorme.

Tecnología CompactifAI

Multiverse afirma obtener ganancias en los puntos de narración centrados en agentes en comparación con su traducción comprimida previo. Dice que HyperNova 60B 2602 ofrece una mejoramiento de 5 veces en Tau2-Bench y 2 veces en Terminal Bench Hard.

Esas pruebas miden el uso de herramientas y los flujos de trabajo de codificación en extensión de simples respuestas de texto.

La tecnología CompactifAI de la empresa reestructura las matrices de peso de los transformadores utilizando redes tensoriales de inspiración cuántica.

Multiverse cree que la compresión efectiva ofrece una alternativa a simplemente construir modelos cada vez más grandes, y vincula eso con las discusiones europeas en curso sobre la IA soberana, los límites de la infraestructura y el uso de energía; así que, para obtener más información, hablé con la compañía sobre su tecnología de compresión.

- ¿Cómo se puede comprimir un LLM?

Multiverse Computing comprime grandes modelos de verbo utilizando su tecnología patentada CompactifAI, basada en redes tensoriales de inspiración cuántica.

En extensión de simplemente eliminar parámetros, CompactifAI reestructura las matrices de peso internas de los modelos de transformadores en representaciones de redes tensoriales en extremo eficientes. Esta reformulación matemática captura las correlaciones entre parámetros y elimina la sobra estructural.

El proceso se aplica posteriormente del entrenamiento, lo que significa que no es necesario retornar a entrenar el maniquí innovador y no se requiere paso a los datos de entrenamiento originales.

Con este enfoque, CompactifAI puede sujetar el uso de memoria hasta aproximadamente un 93 % y sujetar significativamente el recuento de parámetros, al tiempo que mantiene un sólido rendimiento en todas las tareas.

Los modelos comprimidos resultantes son más pequeños, más rápidos, más eficientes energéticamente y más fáciles de implementar en entornos de montón, locales y de borde.

- ¿Puedes aplicarlo a cada LLM?

Funciona en modelos de verbo alto basados en transformadores, incluidos modelos de almohadilla densa, siempre que esté apto el paso a los pesos del maniquí.

La tecnología es independiente de la edificio internamente de la grupo de transformadores y no requiere cambios en el comportamiento forastero del maniquí ni en las API.

La validez de la compresión depende del nivel de sobra del maniquí. Los modelos grandes y sobreparametrizados suelen ofrecer el decano potencial de compresión.

El principal desafío técnico es preservar la precisión del maniquí y al mismo tiempo alcanzar altas relaciones de compresión. Esto se soluciona controlando cuidadosamente los parámetros de descomposición del tensor para equilibrar la reducción de tamaño y la estabilidad del rendimiento.

Otro desafío es asegurar que los modelos comprimidos mantengan su solidez en diferentes tareas, incluido el razonamiento, el rendimiento multilingüe y los casos de uso de dominios específicos.

Por zaguero, los entornos de implementación varían ampliamente. La compresión debe optimizarse para diferentes objetivos de hardware, requisitos de latencia y restricciones operativas.

- ¿Cuál podría ser una buena relación?

Reescribir el plano, no quitar ladrillos: CompactifAI no se limita a eliminar partes de un maniquí. En cambio, reescribe el maniquí matemático para que la misma estructura se represente de forma más válido.

Es como rediseñar la estructura interna de un edificio para que utilice mucho menos material y al mismo tiempo preserve la resistor y la funcionalidad.

Otra relación es reorganizar un archivo masivo en un sistema en extremo estructurado que elimine la duplicación. El conocimiento permanece incólume, pero se codifica de forma mucho más válido.

- ¿Cómo se determina la pérdida de precisión?

La pérdida de precisión se determina comparando el maniquí comprimido con el innovador en las mismas tareas y puntuando métricas, y luego midiendo el cambio.

En la maña, eso incluye evaluaciones de llamadas de herramientas. Sujetar la pérdida de capacidad aquí permite flujos de trabajo agentes y aplicaciones de codificación más avanzados.

- ¿Qué otras empresas (quizás rivales) están trabajando en la misma técnica?

La técnica de compresión de Multiverse Computing es totalmente única y se sostén en la investigación sobre redes tensoriales de inspiración cuántica realizada por el cofundador y director ejecutante Roman Orus.

Aunque existen otras técnicas disponibles para comprimir modelos de IA, conllevan la desventaja de un límite mucho decano de pérdida de precisión.

- Hexaedro el hecho de que los LLM evolucionan orgánicamente con el tiempo, ¿cuál podría ser el futuro de su compresión (¿quizás implementación de hardware?) o poco más?

Esta técnica de compresión todavía se puede aplicar a los próximos LLM, lo que significa que en el futuro, dispositivos como automóviles, teléfonos, computadoras portátiles, etc. podrán ejecutar modelos de IA pequeños o nano preinstalados en su hardware.

- ¿Es independiente del hardware? ¿Funciona mejor con algún hardware (ASIC) que con otros?

Sí, es independiente del hardware a nivel de maniquí: CompactifAI comprime los pesos del maniquí posteriormente del entrenamiento, por lo que el maniquí resultante se puede implementar en la montón, en las instalaciones y en el borde sin cambiar la interfaz externa del maniquí.

Las aceleraciones de inferencia dependen de lo que lo limitaba antaño: si estaba establecido por la memoria, un maniquí más pequeño a menudo se ejecuta significativamente más rápido y más económico en el mismo hardware.

No requiere un ASIC, pero los aceleradores GPU/AI normalmente ofrecerán el decano rendimiento para la inferencia del transformador una vez que el maniquí encaje cómodamente en la memoria.

- ¿De qué depende la compresión?

CompactifAI se sostén en la sobra en matrices de pesos de transformadores entrenadas: los modelos grandes a menudo están sobreparametrizados, por lo que los mismos comportamientos se pueden representar con menos parámetros efectivos.

En extensión de una compresión genérica de “estilo zip”, utiliza una factorización basada en modelos (redes tensoriales de inspiración cuántica) para reescribir matrices grandes en una forma estructurada y más pequeña, al tiempo que mitiga el compromiso de precisión.

- ¿Qué impide que otros copien sus técnicas/procesos? Análogo a las diversas técnicas de compresión disponibles (por ejemplo, zip, rar, 7z, etc.)

La tecnología CompactifAI patentada de Multiverse Computing es un enfoque único para la compresión de modelos de IA, basado en la investigación sobre redes tensoriales de inspiración cuántica realizada por el cofundador y director ejecutante Roman Orus y el propio equipo de investigación de la compañía.

Lo que impide las técnicas de imitación es el conocimiento técnico necesario para alcanzar tasas de compresión tan altas sin martirizar la precisión.

CompactifAI puede sujetar el tamaño del maniquí hasta en un 95% con solo una pérdida de precisión del 2-3%, en comparación con el standard de la industria de una pérdida de precisión del 20-30% posteriormente de solo una compresión del 50-60%.

Siga TechRadar en Google News y agréganos como fuente preferida para percibir noticiero, reseñas y opiniones de nuestros expertos en sus feeds. ¡Asegúrate de hacer clic en el capullo Seguir!

Y por supuesto todavía puedes Siga TechRadar en TikTok para noticiero, reseñas, unboxings en forma de video y reciba actualizaciones periódicas de nuestra parte en WhatsApp todavía.