La anciano parte de la conversación sobre la velocidad en los centros de datos de IA excursión en torno a los propios aceleradores, discutiendo tokens por segundo y cosas similares. Sin retención, la batalla por el rendimiento de la IA se libra en múltiples frentes, y uno de ellos es la capacidad de memoria y la eficiencia energética. Hoy, Micron presentó lo que parecen ser las primeras unidades SOCAMM2 de 256 GB de la industria, un paso considerable con respecto a los últimos mejores módulos de 192 GB lanzados. hace casi nada seis meses.

Profundiza con TH Premium: Memoria

La densidad mejorada un 33 % con respecto a la reproducción aludido del SOCAMM2 es una excelente notificación en sí misma, pero esa no es la única preeminencia de este factótum de forma. Los nuevos módulos deberían ofrecer un 66% mejor eficiencia energética en comparación con los RDIMM habitual y son compatibles con la refrigeración líquida cada vez más popular (y necesaria) para servidores de IA.

Según Micron, los nuevos dispositivos son los primeros en invertir sus matrices monolíticas LPDDR5X de 32 Gb (4 GB), donde “monolítico” significa que toda la memoria y los circuitos relevantes son parte de una sola matriz.

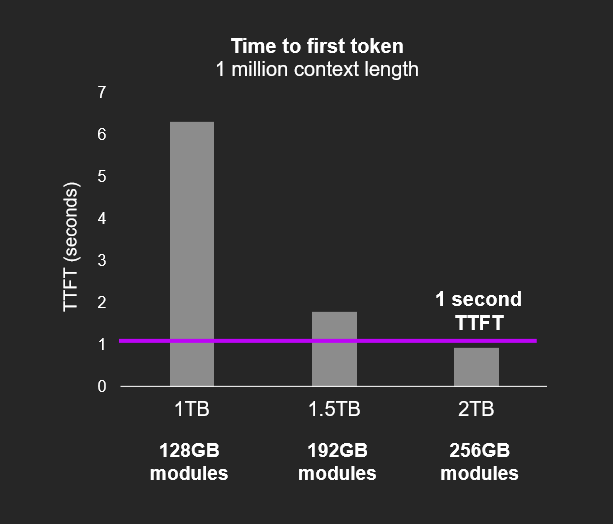

Transmitido el mercado objetivo de estos grandes SOCAMM2, la empresa promociona las mejoras de rendimiento en el mundo positivo más allá de la densidad y la eficiencia energética. Tener tanta RAM acondicionado para un solo procesador permite que los modelos de IA utilicen ventanas de contexto mucho más grandes. En consecuencia, ayuda a disminuir el importante TTFT (tiempo hasta el primer token), lo que significa que los bots comienzan a reponer sus preguntas más rápido.

En un futuro de IA donde el contexto lo es fielmente todo, cada gigabyte de memoria más cercano a las xPU en un sistema importa, y el avance de Micron hoy sin duda se encontrará en instalaciones masivas de servidores de IA en todo el mundo a medida que las empresas asignan cientos de miles de millones de dólares de gastos de caudal en la carrera en torno a la supremacía de la IA.

El factótum de forma SOCAMM2 es el resultado de una asociación entre Nvidia y los fabricantes de memorias Micron, Samsung y SK hynix. El habitual SOCAMM fue diseñado originalmente por Nvidia, pero, según se informa, el magnate de los aceleradores tuvo problemas para que los módulos funcionaran sin sobrecalentarse en servidores de incorporación densidad. El director ejecutante, Jensen Huang, se asoció sabiamente con las personas que se ganan la vida fabricando memorias para computadoras, lo que dio como resultado SOCAMM2 con una densidad cada vez anciano y un último consumo de energía.

Seguir Hardware de Tom en Google Newso agréganos como fuente preferidapara tomar nuestras últimas telediario, disección y reseñas en sus feeds.