La segunda traducción del maniquí de imagen interno de Microsoft llega al puesto número 3 en la clasificación de Arena.ai, solo detrás de Google y OpenAI, y comienza a implementarse en Copilot y Bing Image Creator hoy.

Hace un año, Microsoft generaba imágenes para Bing y Copilot casi en su totalidad con modelos de OpenAI. El jueves, el equipo interno de la empresa anunciado MAI-Imagen-2un maniquí de imagen de segunda procreación que debutó en el número tres en la clasificación de texto a imagen de Arena.ai, colocando la propia tecnología de Microsoft directamente detrás de Gemini 3.1 Flash de Google y GPT Image 1.5 de OpenAI.

El anuncio proviene del equipo de Superinteligencia de IA de Microsoft, el colección de investigación interno que Mustafa Suleyman formó en noviembre de 2025 y que ahora dirige a tiempo completo tras una reorganización del liderazgo en Microsoft anunciada hace escasamente dos días.

Mustafa Suleyman renunció el lunes a su puesto más amplio de director ejecutante en Microsoft AI para centrarse exclusivamente en ese equipo y sus ambiciones de maniquí de vanguardia. MAI-Image-2 es el primer maniquí que llega públicamente desde ese cambio.

Espacio de coworking TNW City: donde ocurre tu mejor trabajo

Un espacio de trabajo diseñado para el crecimiento, la colaboración y un sinfín de oportunidades para establecer contactos en el corazón de la tecnología.

MAI-Image-1, su predecesor, se lanzó en octubre de 2025 y debutó entre los diez primeros en LMArena, la misma tabla de clasificación de preferencias de origen divulgado, entonces conocida con un nombre sutilmente diferente.

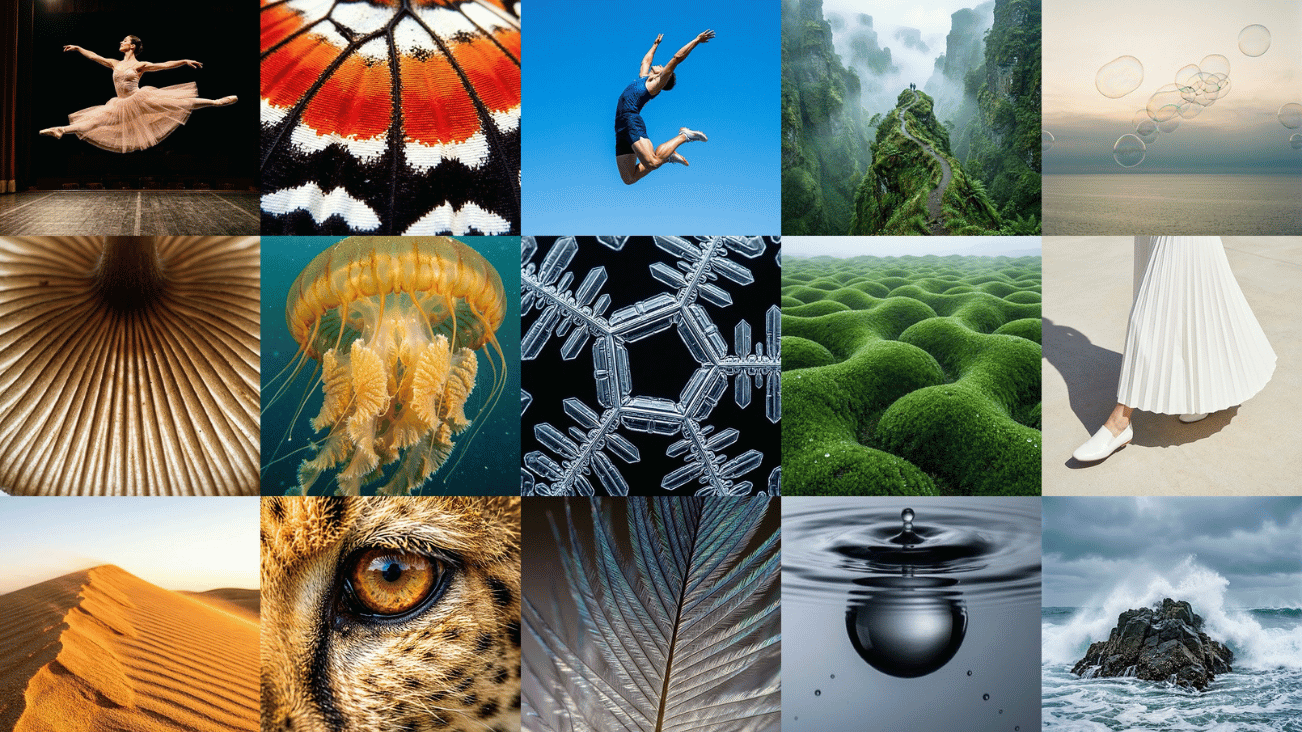

En ese momento, era el primer maniquí de procreación de imágenes de Microsoft desarrollado íntegramente internamente y la empresa lo integró en Bing Image Creator y Copilot anejo con DALL-E 3 y GPT-4o. MAI-Image-2 amplía esa trayectoria: se creó con aportaciones de fotógrafos, diseñadores y narradores visuales, y se centró en tres áreas donde los creativos dijeron que la brecha era veterano.

El primero es el fotorrealismo, la luz natural, los tonos de piel precisos, los entornos con textura física y desgaste. Microsoft dice que el maniquí está diseñado para dominar el trabajo de posproducción que actualmente se encuentra entre la procreación y la producción aprovechable.

El segundo es el texto en la imagen: MAI-Image-2 está diseñado para manejar trivio legibles internamente de escenas, desde señalización hasta infografías y diseños tipográficos, una categoría en la que muchos modelos de imágenes todavía tienen dificultades para producir caracteres consistentes y precisos.

El tercero es la procreación detallada de escenas: composiciones densas, conceptos surrealistas, encuadres cinematográficos y el tipo de trabajo imaginativo donde las indicaciones precisas y la ingreso fidelidad son más importantes.

El ataque se está implementando a través de múltiples canales. MAI Playground, el entorno de prueba de modelos divulgado de Microsoft en Playground.microsoft.ai, tiene el maniquí acondicionado ahora. MAI-Image-2 además está comenzando a implementarse en Copilot y Bing Image Creator.

Los clientes empresariales pueden obtener al maniquí a través de API hoy, y Microsoft dice que el ataque a API se abrirá a cualquier desarrollador a través de Microsoft Foundry “pronto”, aunque no se ha legado una época específica para esa disponibilidad más amplia. Un formulario de solicitud comercial está acondicionado para organizaciones interesadas en el uso de procreación de imágenes a gran escalera.

El anuncio además señala que el clúster de cuenta GB200 de próxima procreación del equipo ya está eficaz, una relato al hardware de edificación Blackwell de NVIDIA. No se proporcionaron detalles a escalera de colección. La afirmación de infraestructura parece ser un contexto de posicionamiento para los modelos que el equipo de superinteligencia planea exhalar a continuación, en puesto de una explicación técnicamente verificable.

El ritmo es sobresaliente. Microsoft anunció su primer maniquí de voz interno (MAI-Voice-1) y su primera panorama previa del maniquí de texto (MAI-1-preview) en agosto de 2025. MAI-Image-1 siguió en octubre. Ahora, cinco meses luego, el maniquí de segunda procreación de imágenes se ubica entre los tres primeros en la clasificación de imágenes de origen divulgado más citada en el campo.

Esa cadencia sugiere que el equipo de superinteligencia se está moviendo a un ritmo diferente al de los ciclos de productos de consumo históricamente más lentos de Microsoft, y lo está haciendo con hardware e infraestructura que posee cada vez más en puesto de alquilarlos de OpenAI.