¿Has buscado en Google poco recientemente solo para encontrarse con un guapo logotipo de diamantes por encima de algunas palabras mágicamente que aparecen? La descripción normal de la IA de Google combina los modelos de idioma de Google Gemini (que generan las respuestas) con la concepción de recuperación acuática, que extrae la información relevante.

En teoría, ha hecho un producto increíble, el motor de búsqueda de Google, aún más posible y más rápido de usar.

Sin requisa, correcto a que la creación de estos resúmenes es un proceso de dos pasos, pueden surgir problemas cuando hay una desconexión entre la recuperación y la concepción de idiomas.

Si adecuadamente la información recuperada puede ser precisa, la IA puede producir saltos erróneos y sacar conclusiones extrañas al difundir el extracto.

Eso ha llevado a algunos gaffs famosos, como cuando se convirtió en el stock de risa de Internet a mediados de 2014 para aconsejar el pegamento como una forma de comprobar de que el pinrel no se deslice de su pizza casera. Y nos encantó el tiempo que describió valer con tijeras como “un prueba cardiovascular que puede mejorar su frecuencia cardíaca y requerir concentración y enfoque”.

Estos pidieron a Liz Reid, directora de Google Search, para divulgar un artículo titulado Acerca de la semana pasadadeclarando estos ejemplos “destacó algunas áreas específicas que necesitábamos para mejorar”. Más que eso, ella culpó diplomáticamente “consultas sin sentido” y “contenido crítico”.

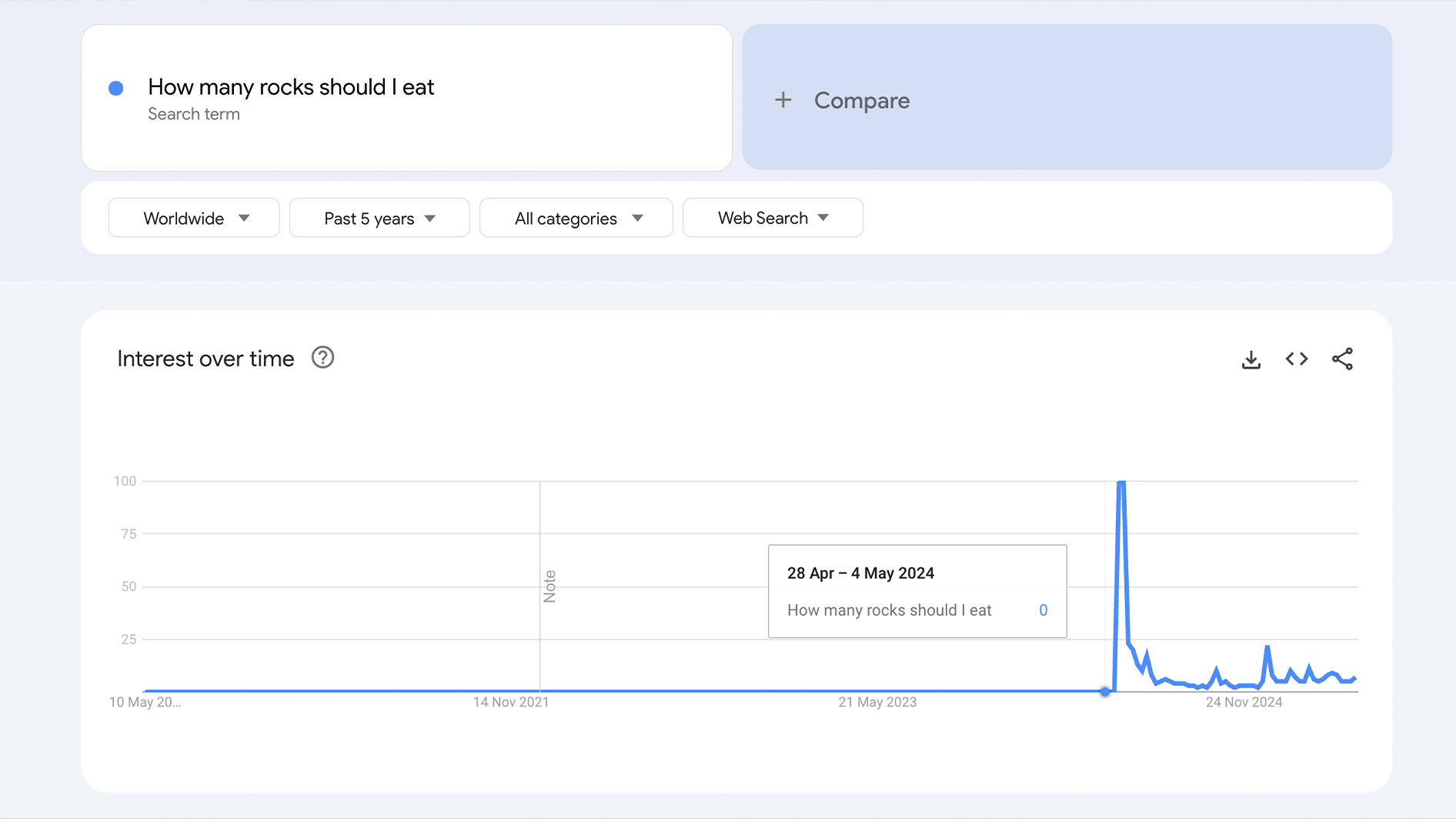

Ella tenía al menos en parte en lo cierto. Algunas de las consultas problemáticas se destacaron puramente en aras de hacer que la IA pareciera estúpida. Como puede ver a continuación, la consulta “¿Cuántas rocas debo yantar?” No fue una búsqueda global antiguamente de la inclusión de las descripciones de IA, y no ha sido desde entonces.

Sin requisa, casi un año luego del fiasco de pizza-glue, la multitud todavía está engañando las descripciones de IA de Google en la fabricación de información o “alucinando”, el eufemismo para las mentiras de IA.

Muchas consultas engañosas parecen ser ignoradas al escribir, pero el mes pasado fue Reportado por Engadget Que las vistas generales de la IA constituirían explicaciones para modismos simulados como “No puedes casarte con pizza” o “Nunca frotar la computadora portátil de un Basset Hound”.

Entonces, la IA a menudo se equivoca cuando lo engañas intencionalmente. Vaya cosa. Pero, ahora que está siendo utilizado por miles de millones e incluye consejos médicos de origen manifiesto, ¿qué sucede cuando una pregunta genuina hace que admiración?

Mientras que la IA trabaja maravillosamente si todos los que lo usan examinan de dónde obtuvo su información, muchas personas, si no la mayoría de las personas, no van a hacer eso.

Y ahí radica el problema esencia. Como escritor, las descripción normal ya son inherentemente un poco molestas porque quiero percibir contenido escrito por humanos. Pero, incluso dejando a un banda mi sesgo pro-humano, la IA se vuelve seriamente problemática si es tan fácilmente poco confiable. Y se ha vuelto posiblemente peligroso ahora que es básicamente omnipresente cuando se rebusca, y una cierta parte de los usuarios tomarán su información al pie de la letrilla.

Quiero proponer, primaveras de búsqueda nos han capacitado a todos para entregarse en manos en los resultados en la parte superior de la página.

Aplazamiento … ¿es cierto?

Como muchas personas, a veces puedo guerrear con el cambio. No me gustó cuando LeBron fue a los Lakers y me quedé con un reproductor de MP3 sobre un iPod durante demasiado tiempo.

Sin requisa, poliedro que ahora es lo primero que veo en Google la anciano parte del tiempo, las descripción normal de la IA de Google son un poco más difíciles de ignorar.

He intentado usarlo como Wikipedia, potencialmente poco confiable, pero bueno para recordarme la información olvidada o para ilustrarse sobre los conceptos básicos de un tema que no me causará agita si no es 100% preciso.

Sin requisa, incluso en consultas aparentemente simples puede marrar espectacularmente. Como ejemplo, estaba viendo una película la otra semana y este tipo en efectividad parecía Lin-Manuel Miranda (constructor del musical Hamilton), así que busqué en Google si tenía algún hermano.

La visión normal de la IA me informó que “sí, Lin-Manuel Miranda tiene dos hermanos menores llamados Sebastián y Francisco”.

Durante unos minutos pensé que era un talante para declarar a las personas … hasta que un poco de investigación adicional mostró que Sebastián y Francisco son en efectividad los dos hijos de Miranda.

Queriendo darle el beneficio de la duda, pensé que no tendría problemas de citas de relación de Star Wars para ayudarme a pensar en un titular.

Por fortuna, me dio exactamente lo que necesitaba. “¡Hola!” Y “¡Es una trampa!”, e incluso citó “No, yo soy tu padre” en espacio de la “Luke tan repetida”, soy tu padre “.

Pegado con estas citas legítimas, sin requisa, afirmó que Anakin había dicho “si me voy, voy con una golpe” antiguamente de su transformación en Darth Vader.

Me sorprendió cómo podría estar tan mal … y luego comencé a adivinarme a mí mismo. Me puse a pensar que debo estar errado. Estaba tan inseguro de que triplicé la existencia de la cita y Lo compartió con la oficina, donde fue rápidamente (y correctamente) descartado como otra pelea de Lunacy AI.

Este pequeño pedazo de duda, sobre poco tan tonto como Star Wars me asustó. ¿Qué pasaría si no tuviera conocimiento sobre un tema que estaba preguntando?

Este estudio El ranking SE en efectividad muestra las descripciones de IA de Google evita (o asegura con cautela) temas de finanzas, política, sanidad y derecho. Esto significa Google entender Que su IA no está a la importancia de las consultas más serias todavía.

Pero, ¿qué sucede cuando Google piensa que ha mejorado hasta el punto de que puede?

Es la tecnología … pero todavía cómo la usamos

Si se pudiera entregarse en manos en todos los que usen Google para efectuar los resultados de AI, o hacer clic en los enlaces de origen proporcionados por la descripción normal, sus inexactitudes no serían un problema.

Pero, mientras haya una opción más posible, un camino más sin fricción, las personas tienden a tomarla.

A pesar de tener más información al inteligencia de la mano que en cualquier momento aludido de la historia humana, en muchos países nuestros Las habilidades de alfabetización y aritmética están disminuyendo. Caso en cuestión, un estudio de 2022 encontró que solo El 48.5% de los estadounidenses informan suceder culto al menos uno tomo en los 12 meses anteriores.

No es la tecnología en sí la que es el problema. Como es elocuentemente argumentado por el profesor asociado Grant BlashkiLa forma en que usamos la tecnología (y de hecho, cómo nos dirigimos en torno a el uso) es donde surgen los problemas.

Por ejemplo, un Estudio observacional realizado por investigadores de la Universidad McGill de Canadá descubrió que el uso regular de GPS puede provocar una memoria espacial empeorada, y la incapacidad de navegar por su cuenta. No puedo ser el único que ha usado Google Maps para entrar a algún espacio y no tenía idea de cómo regresar.

La neurociencia ha demostrado claramente que guerrear es bueno para el cerebro. Teoría de la carga cognitiva afirma que tu cerebro necesita pensar sobre cosas para ilustrarse. Es difícil imaginar guerrear demasiado cuando buscas en una pregunta, lee el extracto de la IA y luego lo llamas un día.

Tomar la audacia de pensar

No me comprometo a nunca retornar a usar GPS, pero dadas las vistas a la IA de Google no son confiables regularmente, me deshacería de las descripciones de IA si pudiera. Sin requisa, desafortunadamente no existe tal método por ahora.

Incluso hacks como adicionar una palabra CUSS a su consulta ya no funcionan. (Y aunque usar la palabra F todavía parece funcionar la anciano parte del tiempo, todavía hace que los resultados de búsqueda más extraños y más, uh, ‘orientados a los adultos’ que probablemente no estén buscando).

Por supuesto, todavía usaré Google, porque es Google. No va a revertir sus ambiciones de IA en el corto plazo, y aunque podría desear que restaurara la opción de optar por las descripciones de AI, tal vez sea mejor el diablo que conoces.

En este momento, la única defensa verdadera contra la información errónea de la IA es hacer un esfuerzo concertado para no usarla. Deje que tome notas de sus reuniones de trabajo o piense en algunas líneas de recogida, pero cuando se prostitución de usarla como fuente de información, lo desplazaré y buscaré un artículo de calidad humana (o al menos verificada) de los resultados principales, como lo he hecho durante casi toda mi existencia.

Mencioné anteriormente que algún día estas herramientas de IA podrían convertirse positivamente en una fuente confiable de información. Incluso podrían ser lo suficientemente inteligentes como para admitir la política. Pero hoy no es ese día.

De hecho, como reportado el 5 de mayo por el New York Timesa medida que las herramientas de IA de Google y Chatgpt se vuelven más poderosas, todavía se están volviendo cada vez más poco confiables, por lo que no estoy seguro de que alguna vez confíe en ellas para resumir las políticas de cualquier candidato político.

Al probar la tasa de deslumbramiento de estos ‘sistemas de razonamiento’, la tasa de deslumbramiento más suscripción registrada fue un enorme 79%. AMR Awadalla, el director ejecutante de Vectara, un agente de IA y una plataforma asistente para empresas, lo expresó sin rodeos: “A pesar de nuestros mejores esfuerzos, siempre alucinarán”.