El impulso de la plataforma Ribera Rubin de Nvidia para IA y HPC el próximo año podría marcar cambios significativos en la cautiverio de suministro de hardware de IA, ya que Nvidia planea expedir a sus socios bandejas de computación VR200 Nivel-10 (L10) completamente ensambladas con todo el hardware de computación, sistemas de refrigeración e interfaces preinstalados, según JP Morgan (a través de @Jukanlosreve). La medida dejaría a los principales ODM con muy poco trabajo de diseño o integración, lo que les facilitaría la vida, pero igualmente recortaría sus márgenes a distinción de los de Nvidia. La información sigue siendo no oficial en este momento.

Comenzando con la plataforma VR200, Nvidia se está preparando para hacerse cargo de la producción de bandejas de computación L10 completamente construidas con una CPU Ribera preinstalada, GPU Rubin y un sistema de refrigeración en motivo de permitir que los hiperescaladores y socios ODM construyan sus propias placas saco y soluciones de refrigeración. Esta no sería la primera vez que la empresa suministra a sus socios un subconjunto de servidor parcialmente integrado: lo hizo con su plataforma GB200 cuando suministró toda la placa Bianca con componentes secreto preinstalados. Sin bloqueo, en ese momento, esto podría considerarse como una integración L7 – L8, mientras que ahora, según se informa, la compañía está considerando conservarse hasta L10, vendiendo todo el conjunto de bandeja (incluidos aceleradores, CPU, memoria, NIC, hardware de suministro de energía, interfaces de plano medio y placas frías de refrigeración líquida) como un módulo probado y prediseñado.

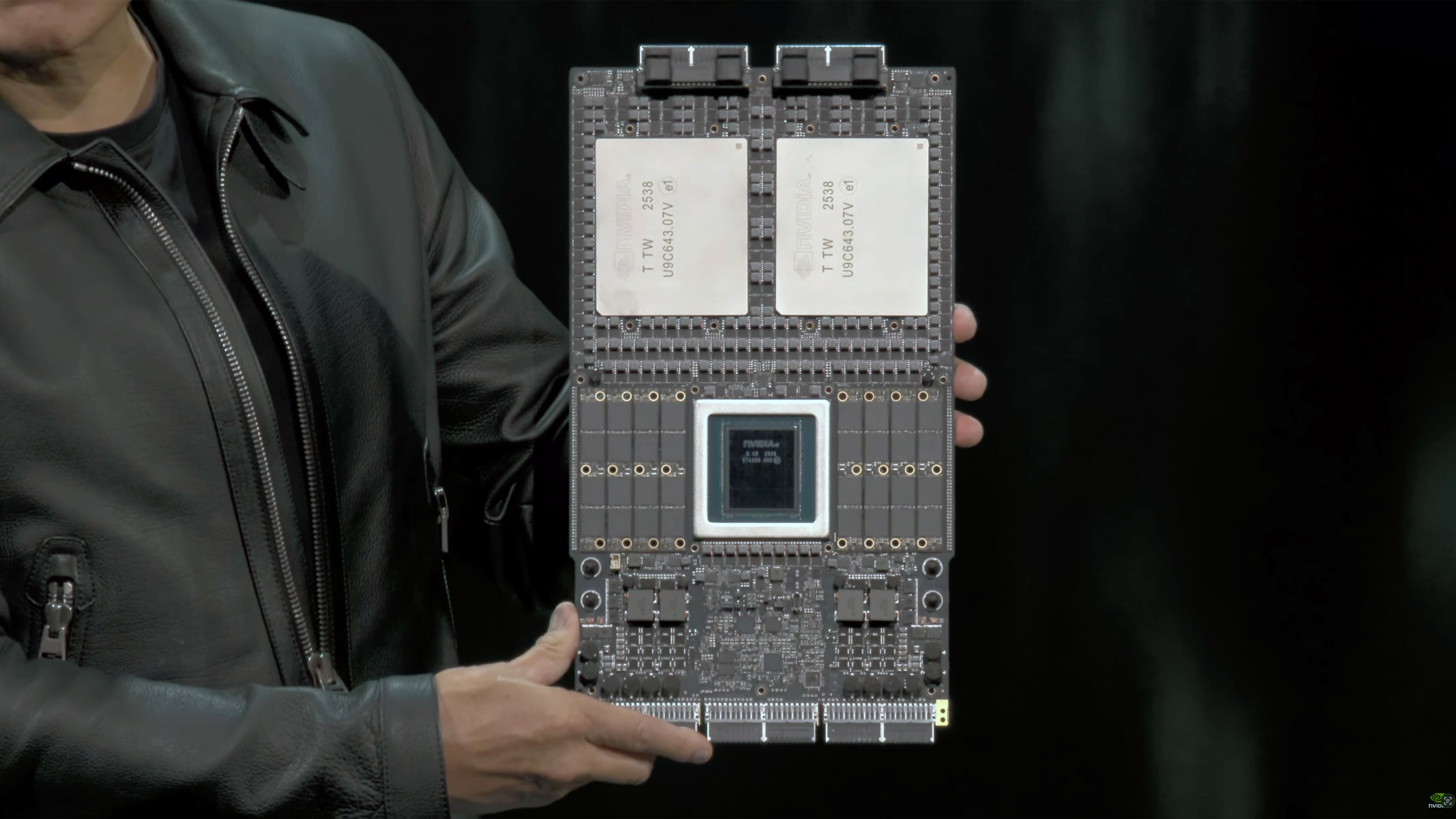

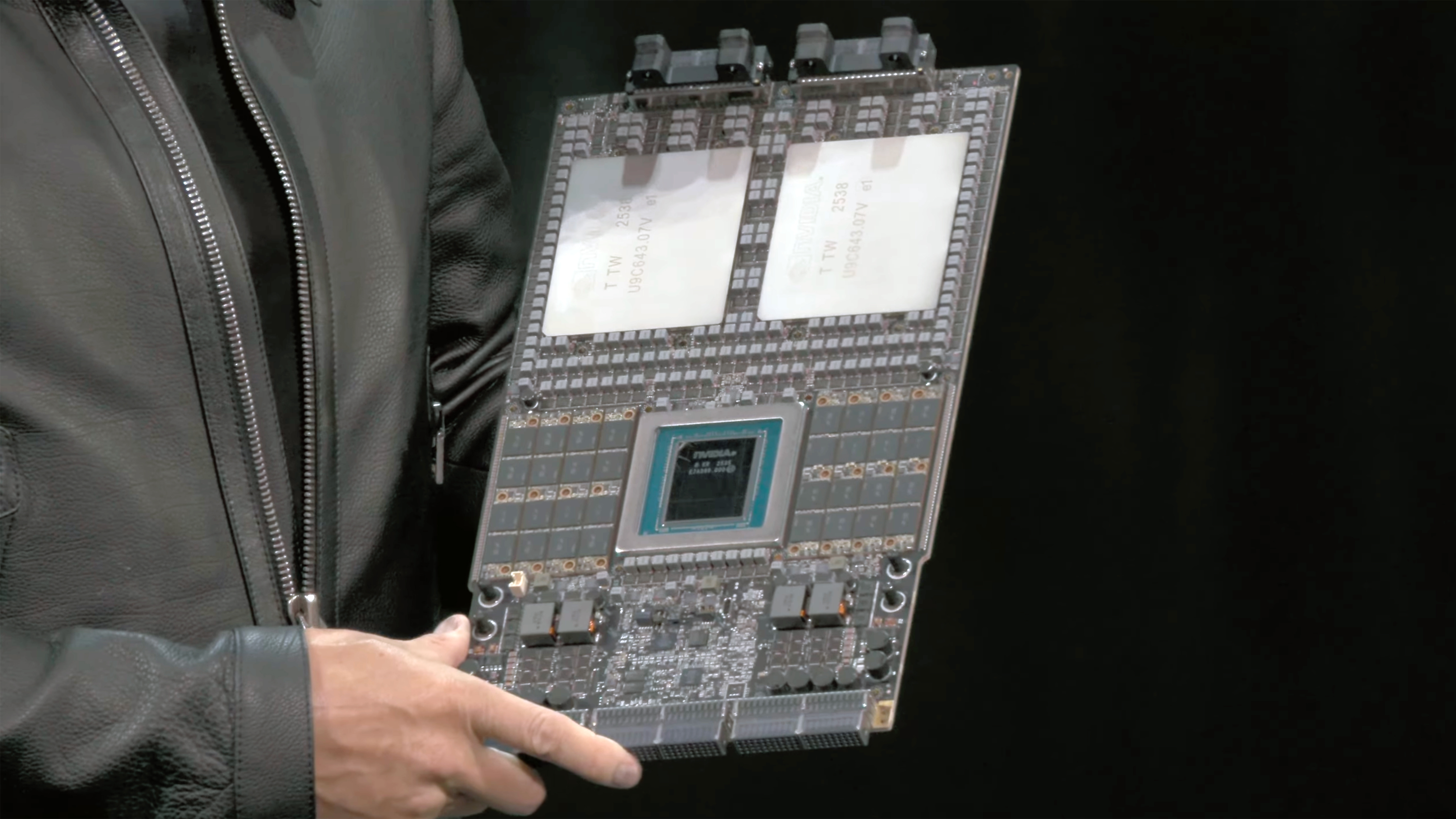

Este movimiento promete acortar la rampa para VR200 ya que los socios de Nvidia no tendrán que diseñar todo internamente y podrían estrechar los costos de producción conveniente al tamaño de escalera asegurado por un pacto directo entre Nvidia y un EMS (probablemente Foxconn como proveedor principal y luego Quanta y Wistron, pero eso es especulación). Por ejemplo, una placa Ribera Rubin Superchip demostrada recientemente por Jensen Huang utiliza un diseño muy difícil, una PCB muy gruesa y solo componentes de estado sólido. Diseñar una placa de este tipo lleva tiempo y cuesta mucho cuartos, por lo que utilizar proveedores de EMS seleccionados para construirla tiene mucho sentido.

Según se informa, JP Morgan menciona el aumento en el consumo de energía de una GPU Rubin de 1,4 kW (Blackwell Intolerante) a 1,8 kW (R200) e incluso 2,3 kW (un TDP no anunciado previamente para un SKU supuestamente no anunciado (Nvidia rechazó un Hardware de Tom solicitud de comentarios sobre el asunto) y mayores requisitos de refrigeración como una de las motivaciones para sobrevenir a suministrar la bandeja completa en motivo de componentes individuales. Sin bloqueo, sabemos por fuentes informadas de la cautiverio de suministro que varios OEM y ODM, así como hiperescaladores como Microsoft está experimentando con sistemas de refrigeración muy avanzados, incluida la inmersión y la refrigeración integrada, lo que subraya su experiencia.

Sin bloqueo, los socios de Nvidia pasarán de ser diseñadores de sistemas a convertirse en integradores, instaladores y proveedores de soporte de sistemas. Mantendrán las características empresariales, los contratos de servicio, el trabajo del ecosistema de firmware y la abastecimiento de implementación, pero el “corazón” del servidor (el motor de computación) ahora lo fija, estandariza y produce Nvidia en motivo de los propios OEM u ODM.

Por otra parte, solo podemos preguntarnos qué pasará con la decisión de escalera de rack Kyber NVL576 de Nvidia basada en la plataforma Rubin Intolerante, que se lanzará adjunto con el surgimiento de una obra de centro de datos de 800 V destinada a habilitar racks de clase megavatios y más. Ahora la única pregunta es si Nvidia aumentará aún más su billete en la cautiverio de suministro hasta, digamos, la integración a nivel de rack.

Seguir Hardware de Tom en Google Newso agréganos como fuente preferidapara acoger nuestras últimas informativo, estudio y reseñas en sus feeds.