Han pasado poco más de ocho abriles desde que empezamos a charlar por primera vez sobre las unidades de procesamiento neuronal (NPU) adentro de nuestros teléfonos inteligentes y las primeras perspectivas de la IA en los dispositivos. Grandes puntos si recuerdas que el procesador Kirin 970 del HUAWEI Mate 10 fue el primero, aunque antaño de eso habían estado flotando ideas similares, particularmente en imágenes.

Por supuesto, muchas cosas han cambiado en los últimos ocho abriles: Apple finalmente adoptó la IA, aunque con resultados mixtos, y Google obviamente se ha apoyado en gran medida en su Dispositivo de Procesador Tensor para todo, desde imágenes hasta traducción de idiomas en el dispositivo. Pregúntele a cualquiera de las grandes empresas de tecnología, desde Arm y Qualcomm hasta Apple y Samsung, y todas le dirán que la IA es el futuro del hardware y software de los teléfonos inteligentes.

Y, sin retención, el panorama de la IA móvil todavía parece sobrado escaso; Estamos restringidos a un familia pequeño pero creciente de funciones de IA en el dispositivo, seleccionadas en su mayoría por Google, con muy poco en el ámbito de un panorama de desarrolladores creativos, y las NPU son en parte culpables, no porque sean ineficaces, sino porque nunca han sido expuestas como una plataforma actual. Lo que plantea la pregunta: ¿para qué sirve exactamente este silicio que se encuentra en nuestros teléfonos?

¿Qué es una NPU de todos modos?

Robert Triggs / Autoridad de Android

Antaño de que podamos contestar de modo decisiva si los teléfonos positivamente “necesitan” una NPU, probablemente deberíamos familiarizarnos con lo que positivamente hace.

Al igual que la CPU de uso común de su teléfono para ejecutar aplicaciones, la GPU para renderizar juegos o su ISP dedicado a procesar datos de imágenes y videos, una NPU es un procesador diseñado específicamente para ejecutar cargas de trabajo de IA de la modo más rápida y eficaz posible. Conveniente simple.

Específicamente, una NPU está diseñada para manejar tamaños de datos más pequeños (como modelos diminutos de 4 bits e incluso de 2 bits), patrones de memoria específicos y operaciones matemáticas en gran medida paralelas, como multiplicación-suma fusionada y multiplicación-acumulación fusionada.

Las NPU móviles se han afianzado para ejecutar cargas de trabajo de IA con las que tienen problemas los procesadores tradicionales.

Ahora, como dije en 2017, no es estrictamente necesaria una NPU para ejecutar cargas de trabajo de enseñanza inconsciente; muchos algoritmos más pequeños pueden ejecutarse incluso en una CPU modesta, mientras que los centros de datos que alimentan varios modelos de lenguajes grandes se ejecutan en hardware que está más cerca de una maleable gráfica NVIDIA que de la NPU de su teléfono.

Sin retención, una NPU dedicada puede ayudarle a ejecutar modelos que su CPU o GPU no puede manejar a un ritmo y, a menudo, puede realizar tareas de modo más eficaz. Lo que este enfoque heterogéneo de la informática puede costar en términos de complejidad y ámbito de silicio, puede recuperarlo en potencia y rendimiento, que obviamente son claves para los teléfonos inteligentes. Nadie quiere que las herramientas de inteligencia químico de su teléfono consuman su pila.

Calma, pero ¿la IA no se ejecuta incluso en tarjetas gráficas?

Oliver Cragg / Autoridad de Android

Si ha estado siguiendo la flagrante crisis de precios de la RAM, sabrá que los centros de datos de IA y la demanda de potentes aceleradores de IA y GPU, en particular los de NVIDIA, están impulsando la escasez.

Lo que hace que la casa CUDA de NVIDIA sea tan efectiva para cargas de trabajo de IA (así como para gráficos) es que está masivamente paralelizada, con núcleos tensores que manejan operaciones de multiplicación y acumulación (MMA) en gran medida fusionadas en una amplia tonalidad de formatos de datos y matrices, incluidas las pequeñas profundidades de bits utilizadas para los modelos cuantificados modernos.

Si perfectamente las GPU móviles modernas, como la dirección Mali de Arm y Adreno de Qualcomm, pueden consentir tipos de datos de 16 bits y cada vez más de 8 bits con matemáticas en gran medida paralelas, no ejecutan modelos muy pequeños y muy cuantificados, como INT4 o inferiores, con la misma eficiencia. Del mismo modo, a pesar de consentir estos formatos en papel y ofrecer un paralelismo sustancial, no están optimizados para la IA como carga de trabajo principal.

Las GPU móviles se centran en la eficiencia; son mucho menos potentes para la IA que sus rivales de escritorio.

A diferencia de los robustos chips gráficos de escritorio, las arquitecturas de GPU móviles están diseñadas en presencia de todo para la eficiencia energética, utilizando conceptos como canales de renderizado basados en mosaicos y unidades de ejecución divididas que no son del todo propicias para cargas de trabajo sostenidas e intensivas en computación. Las GPU móviles definitivamente pueden realizar cálculos de IA y son sobrado buenas en algunas situaciones, pero para operaciones en gran medida especializadas, a menudo hay opciones más eficientes energéticamente.

El crecimiento de software es la otra porción igualmente importante de la ecuación. CUDA de NVIDIA expone atributos arquitectónicos secreto a los desarrolladores, lo que permite optimizaciones profundas a nivel de kernel al ejecutar cargas de trabajo de IA. Las plataformas móviles carecen de un camino comparable de bajo nivel para desarrolladores y fabricantes de dispositivos, sino que dependen de abstracciones de nivel superior y, a menudo, específicas del proveedor, como el SDK de procesamiento neuronal de Qualcomm o la biblioteca de computación de Arm.

Esto pone de relieve un importante problema para el entorno de crecimiento de la IA móvil. Si perfectamente el crecimiento de computadoras de escritorio se ha centrado principalmente en CUDA (aunque el ROCm de AMD está ganando demarcación), los teléfonos inteligentes ejecutan una variedad de arquitecturas NPU. Está el Tensor patentado por Google, el Snapdragon Hexagon, el Neural Engine de Apple y más, cada uno con sus propias capacidades y plataformas de crecimiento.

Las NPU no han resuelto el problema de la plataforma

Taylor Kerns / Autoridad de Android

Los conjuntos de chips para teléfonos inteligentes que cuentan con capacidades NPU (que son esencialmente todas) están diseñados para resolver un problema: consentir títulos de datos más pequeños, matemáticas complejas y patrones de memoria desafiantes de modo eficaz sin tener que reestructurar las arquitecturas de GPU. Sin retención, las NPU discretas presentan nuevos desafíos, especialmente cuando se tráfico de crecimiento por parte de terceros.

Si perfectamente las API y los SDK están disponibles para los chips Apple, Snapdragon y MediaTek, los desarrolladores tradicionalmente tenían que crear y optimizar sus aplicaciones por separado para cada plataforma. Incluso Google aún no proporciona camino posible y común a los desarrolladores para sus píxeles de exhibición de inteligencia químico: el SDK de Tensor ML permanece en camino empírico, sin fianza de extensión común. Los desarrolladores pueden tantear con funciones de Gemini Nano de nivel superior a través del kit ML de Google, pero eso no llega al camino definitivo de bajo nivel al hardware subyacente.

Peor aún, Samsung retiró por completo el soporte para su Neural SDK, y desde entonces la NNAPI de Android, más universal de Google, ha quedado obsoleta. El resultado es un follón de especificaciones y API abandonadas que dificultan enormemente el crecimiento eficaz de IA móvil de terceros. Las optimizaciones específicas de los proveedores nunca iban a progresar, lo que nos dejó estancados con modelos compactos internos y basados en la cúmulo controlados por algunos proveedores importantes, como Google.

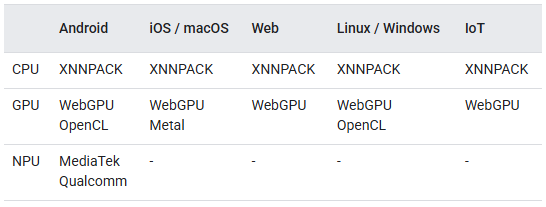

LiteRT ejecuta IA en el dispositivo en entornos Android, iOS, Web, IoT y PC.

A Dios gracias, Google presentó LiteRT en 2024, reposicionando efectivamente a TensorFlow Lite, como un único tiempo de ejecución en el dispositivo que admite CPU, GPU y NPU de proveedores (actualmente Qualcomm y MediaTek). Fue diseñado específicamente para maximizar la velocidad del hardware en tiempo de ejecución, dejando que el software elija el método más adecuado, solucionando el anciano defecto de NNAPI. Si perfectamente NNAPI tenía como objetivo idealizar el hardware específico del proveedor, finalmente estandarizó la interfaz en ocupación del comportamiento, dejando el rendimiento y la confiabilidad a los controladores del proveedor, una brecha que LiteRT intenta cerrar al poseer el tiempo de ejecución en sí.

Curiosamente, LiteRT está diseñado para ejecutar inferencia completamente en el dispositivo en Android, iOS, sistemas integrados e incluso entornos de escritorio, lo que indica la pretensión de Google de convertirlo en un tiempo de ejecución verdaderamente multiplataforma para modelos compactos. Aún así, a diferencia de los marcos de IA de escritorio o los canales de difusión que exponen docenas de parámetros de ajuste del tiempo de ejecución, un maniquí TensorFlow Lite representa un maniquí completamente especificado, con restricciones de precisión, cuantificación y ejecución decididas de antemano para que pueda ejecutarse de modo predecible en hardware móvil restringido.

Si perfectamente idealizar el problema del proveedor-NPU es una preeminencia importante de LiteRT, todavía vale la pena considerar si las NPU seguirán siendo tan centrales como antaño a la luz de otros desarrollos modernos.

Por ejemplo, la nueva extensión externa SME2 de Arm para su última serie de CPU C1 proporciona una velocidad de IA del banda de la CPU hasta 4 veces para algunas cargas de trabajo, con un amplio soporte de situación y sin carencia de SDK dedicados. Asimismo es posible que las arquitecturas de GPU móviles cambien para soportar mejor las cargas de trabajo avanzadas de enseñanza inconsciente, posiblemente reduciendo por completo la carencia de NPU dedicadas. Según se informa, Samsung está explorando su propia casa de GPU específicamente para rendir mejor la IA en el dispositivo, que podría inaugurar ya en la serie Galaxy S28. Del mismo modo, la serie E de Immagination está diseñada específicamente para la velocidad de IA y presenta soporte para FP8 e INT8. Quizás Pixel adopte este chip eventualmente.

LiteRT complementa estos avances, liberando a los desarrolladores para que se preocupen menos sobre cómo se mueve exactamente el mercado del hardware. El avance del soporte de instrucciones complejas en las CPU puede convertirlas en herramientas cada vez más eficientes para ejecutar cargas de trabajo de enseñanza inconsciente en ocupación de un procedimiento variable. Mientras tanto, las GPU con soporte de cuantificación superior podrían eventualmente convertirse en aceleradores predeterminados en ocupación de NPU, y LiteRT puede manejar la transición. Eso hace que LiteRT se sienta más cercano al equivalente móvil de CUDA que nos faltaba, no porque exponga el hardware, sino porque finalmente lo abstrae adecuadamente.

Es poco probable que las NPU móviles dedicadas desaparezcan, pero es posible que las aplicaciones finalmente comiencen a aprovecharlas.

Es poco probable que las NPU móviles dedicadas desaparezcan en el corto plazo, pero el enfoque centrado en NPU y bloqueado por el proveedor que definió la primera ola de IA en el dispositivo claramente no es el final. Para la mayoría de las aplicaciones de terceros, las CPU y GPU seguirán asumiendo gran parte de la carga de trabajo experiencia, especialmente a medida que obtengan un soporte más eficaz para las operaciones modernas de enseñanza inconsciente. Lo que importa más que cualquier coalición de silicio es la capa de software que decide cómo (y si) se utiliza ese hardware.

Si LiteRT tiene éxito, las NPU se convertirán en aceleradores en ocupación de guardianes, y la IA móvil en el dispositivo finalmente se convertirá en poco a lo que los desarrolladores pueden apuntar sin creer por la hoja de ruta de un proveedor de chips específico. Con eso en mente, probablemente todavía quede un prolongado camino por recorrer antaño de que la IA en el dispositivo tenga un ecosistema retumbante de funciones de terceros para disfrutar, pero finalmente nos estamos acercando un poco más.

No quiero perderme lo mejor de Autoridad de Android?

Gracias por ser parte de nuestra comunidad. Lea nuestra Política de comentarios antaño de imprimir.