La IA autohospedada se ha convertido silenciosamente en parte de mi flujo de trabajo diario. Ya ejecuto varios LLM locales a través de Ollama para escribir, investigar y realizar experimentos rápidos, principalmente porque prefiero el control, la privacidad y el rendimiento predecible a las herramientas en la cúmulo. Sin confiscación, con el tiempo me di cuenta de que faltaba poco. Si acertadamente los modelos locales eran poderosos, todavía estaba haciendo demasiado trabajo manual en torno a ellos.

Esa curiosidad me impulsó a probar poco diferente: anexar una capa autónoma encima de mi configuración autohospedada. Así es como comencé a ejecutar AgenticSeek localmente, un agente de IA totalmente autohospedado que no solo ayuda, sino que asimismo maneja las tareas de un extremo a otro en mi máquina.

Un agente de IA totalmente autónomo en sinceridad significa

Agentes de IA orientados a objetivos que verdaderamente hacen las cosas

La longevo parte de la IA que utilizamos hoy en día es “reactiva”. Le das una indicación, te da una respuesta y la conversación termina. Un agente de IA totalmente autónomo es diferente; es “proactivo”. En ocasión de amoldarse a cuchichear, actúa.

El agente autónomo de IA es muy diferente de un chatbot frecuente. Piense en ello como entregar un plan a un asistente inteligente en ocasión de hacer una pregunta a un motor de búsqueda. Cuando le da a un agente un objetivo como “investigar esta empresa y escribir un breviario”, no solo genera texto. Divide ese objetivo en pasos más pequeños: abre un navegador, escudriñamiento en la web, hace clic en enlaces, lee páginas y vigilante archivos.

Si llega a un callejón sin salida o a un error 404, no se da por vencido; piensa en una forma diferente de obtener la información. Gestiona su propio “tirabuzón” de razonamiento y actividad hasta que se realiza el trabajo.

¿Qué es AgenticSeek?

Requisitos previos e instalación

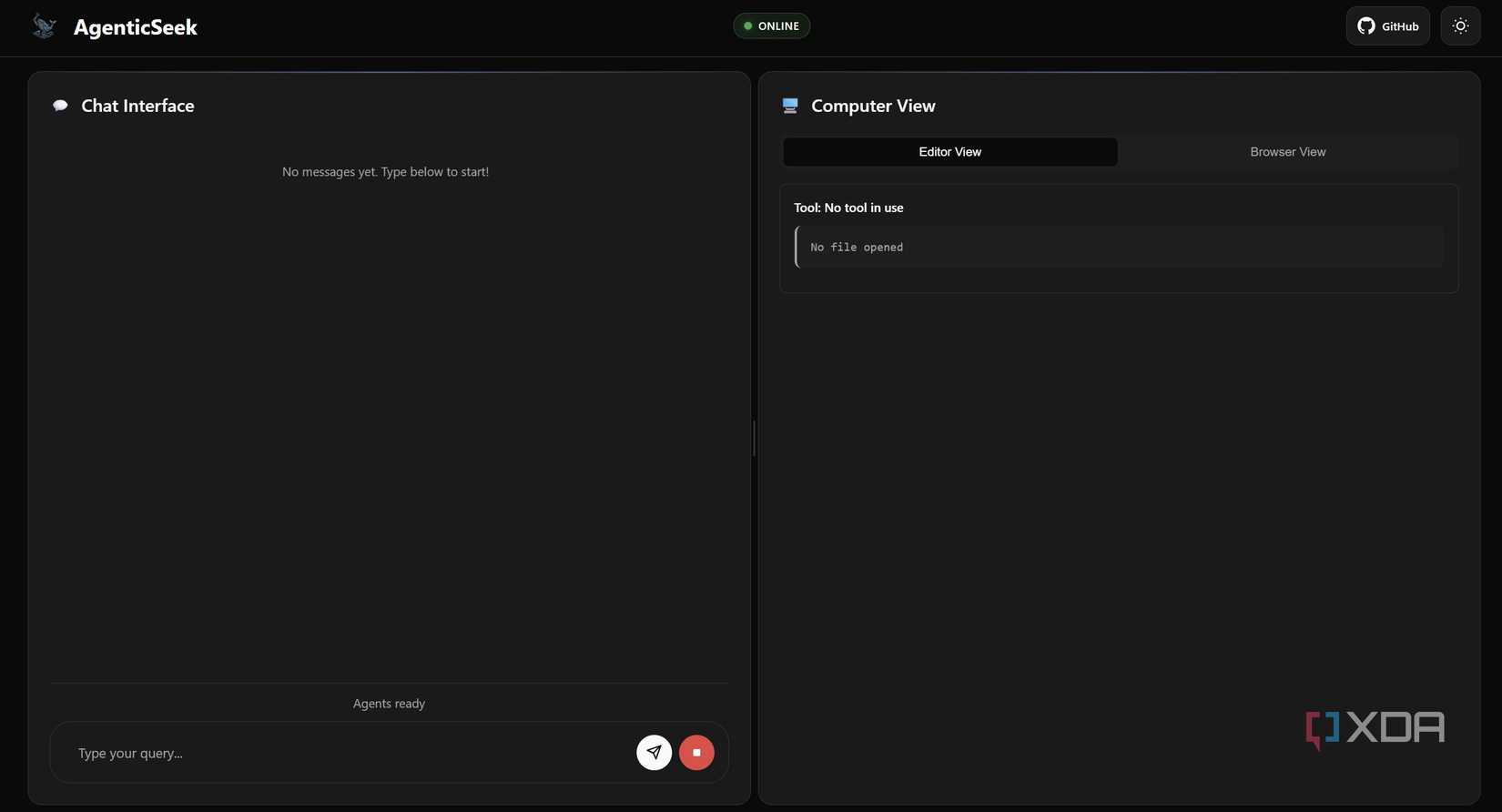

AgenticSeek es un ámbito de código despejado diseñado para ser una “IA restringido de Manus”, una aparejo que no solo chatea, sino que asimismo ejecuta tareas en mi computadora. Lo uso para navegar por la web, extraer datos y escribir código, sabiendo que mis archivos y mi historial de búsqueda nunca salen de mi red restringido.

Ejecutarlo en mi máquina con Windows fue sorprendentemente sencillo. Antiguamente de sumergirse, necesitará algunos requisitos previos: Python 3.10.x (o superior), Git y Docker Desktop. Incluso necesitarás tener Chrome instalado, ya que el agente lo usa para tareas web.

La ocultismo ocurre una vez que tienes Docker ejecutándose. Así es como lo configuro:

- Clonar el repositorio: Abrí mi terminal y ejecuté git clone https://github.com/Fosowl/agenticSeek.git.

- Configuración del entorno: Navegué hasta la carpeta y copié el .env.example en un nuevo archivo llamado .env.

- Energía acoplable: En ocasión de instalar manualmente bases de datos complejas, simplemente utilicé el start_services.cmd incluido. Esto extrae e inicia automáticamente SearxNG (para búsqueda privada) y Redis (para la memoria del agente) en el interior de los contenedores Docker.

- Instalar paquetes de Python: Finalmente, ejecuté pip install -r requisitos.txt y pip install pyreadline3 pyaudio para los bits específicos de Windows.

Una vez hecho esto, estaba preparado para conectarlo a mi LLM restringido y comenzar a descargar mis tareas diarias.

Probé esta plataforma de código despejado para autohospedar LLM y es más rápido de lo que esperaba

Los LLM autohospedados son más rápidos de lo que cree

Lo uso con mi instancia de Ollama.

Sin siquiera tocar la cúmulo

Ejecuto AgenticSeek con mi configuración restringido de Ollama, que mantiene todo simple y totalmente autohospedado. En ocasión de servir de API externas, conecto el agente directamente a un LLM restringido que se ejecuta en mi máquina. Para mi flujo de trabajo, utilizo principalmente el maniquí deepseek-r1:14b a través de Ollama, y ha sido confiable para tareas de investigación, planificación y redacción.

La configuración fue sencilla. Una vez que Ollama se estaba ejecutando localmente, simplemente señalé AgenticSeek al punto final restringido y seleccioné el maniquí. A partir de ahí, funcionó como cualquier otro agente autónomo, como planificar pasos, tildar a herramientas y ejecutar tareas sin carestia de ataque a la cúmulo.

AgenticSeek admite LLM basados en la cúmulo si desea respuestas más rápidas o modelos más grandes. Pero personalmente, prefiero Ollama porque me brinda control total, rendimiento predecible y privacidad total mientras ejecuto todo en mi GPU de rango medio.

Mi experiencia ejecutándolo en una GPU de variedad media

Rendimiento en mi máquina de trabajo diario

He estado ejecutando AgenticSeek en mi configuración diaria: una NVIDIA GeForce RTX 5070, 32 GB de RAM, 1 TB de SSD y un procesador Intel Core Exaltado 9 Serie 2. Para un agente autónomo totalmente alojado, el rendimiento es sinceramente mejor de lo que esperaba.

En el uso diario, los pasos de planificación parecen rápidos, mientras que la velocidad de ejecución depende principalmente de la tarea y el tamaño del maniquí. Con deepseek-r1:14b en Ollama, los flujos de trabajo de investigación y las tareas de varios pasos se ejecutan sin problemas sin forzar demasiado mi sistema. No es instantáneo como las herramientas de la cúmulo y hay fallas de velocidad ocasionales durante carreras más largas, pero en común la experiencia ha sido suficiente buena y consistente.

Donde noto límites es durante cadenas más largas o tareas de razonamiento complejas. Estos pueden ralentizarse y, a veces, necesitan pequeños ajustes rápidos. Aún así, el sistema permanece estable y rara vez tengo fallas o problemas de memoria.

En común, ejecutar AgenticSeek localmente en una GPU de variedad media es suficiente sencillo. Tiene suficiente velocidad para el trabajo auténtico y mantiene todo completamente fuera de ruta.

Conecté a Claude con estas 5 aplicaciones y es productividad con esteroides.

Flujos de trabajo más inteligentes, menos clics, resultados más rápidos

La IA restringido es en sinceridad un impulso a la productividad

Ejecutar un agente autónomo con un LLM restringido verdaderamente ha cambiado la forma en que manejo el trabajo rutinario. En ocasión de hacer malabares con pestañas, herramientas y pequeñas tareas repetitivas, ahora las descargo y me concentro en el trabajo de longevo valencia. Esa es la longevo superioridad para mí: productividad sin distracciones.

La independencia es el principal beneficio. Una configuración autohospedada significa que no hay que esperar API, ni ansiedad por el uso ni interrupciones en el flujo de trabajo. Simplemente encaja en mi sistema diario y sigue ejecutándose en segundo plano. Si ya ejecuta LLM locales, anexar una capa autónoma como esta se siente como “no perderse“Paso deductivo.