A posteriori de la presentación en la E/S 2025, Google está comenzando a permitir que los usuarios del modo AI compartan su cámara en la búsqueda en vivo.

En mayo, Google anunció que estaba llevando a la búsqueda “Tesina de capacidades en vivo de Astra”. Similar a la experiencia de la aplicación Gemini, esto le permite tener una conversación de ida y reverso con la búsqueda de Google sobre la voz y el video. El primer aspecto ingresó a las pruebas en junio.

Aquellos Inscrito en los laboratorios de búsqueda ahora están viendo la entrada de la cámara con un tallo nuevo en la interfaz Live Search Full Search. Cuando el video está activo, la parte superior de su pantalla sobre el curva de cuatro colores se convierte en un visor. Otro buen detalle de diseño es cómo el curva se cae cuando Search Live está emitiendo su respuesta.

Puede aceptar a la búsqueda en vivo desde la cima inferior derecha de una conversación en modo AI, o la parte superior de la aplicación Google debajo del campo de búsqueda. Después, toque “Video” entre el silencio/micrófono y la transcripción (que aún lo lleva a un chat de texto en espacio de superponer el texto en tiempo actual).

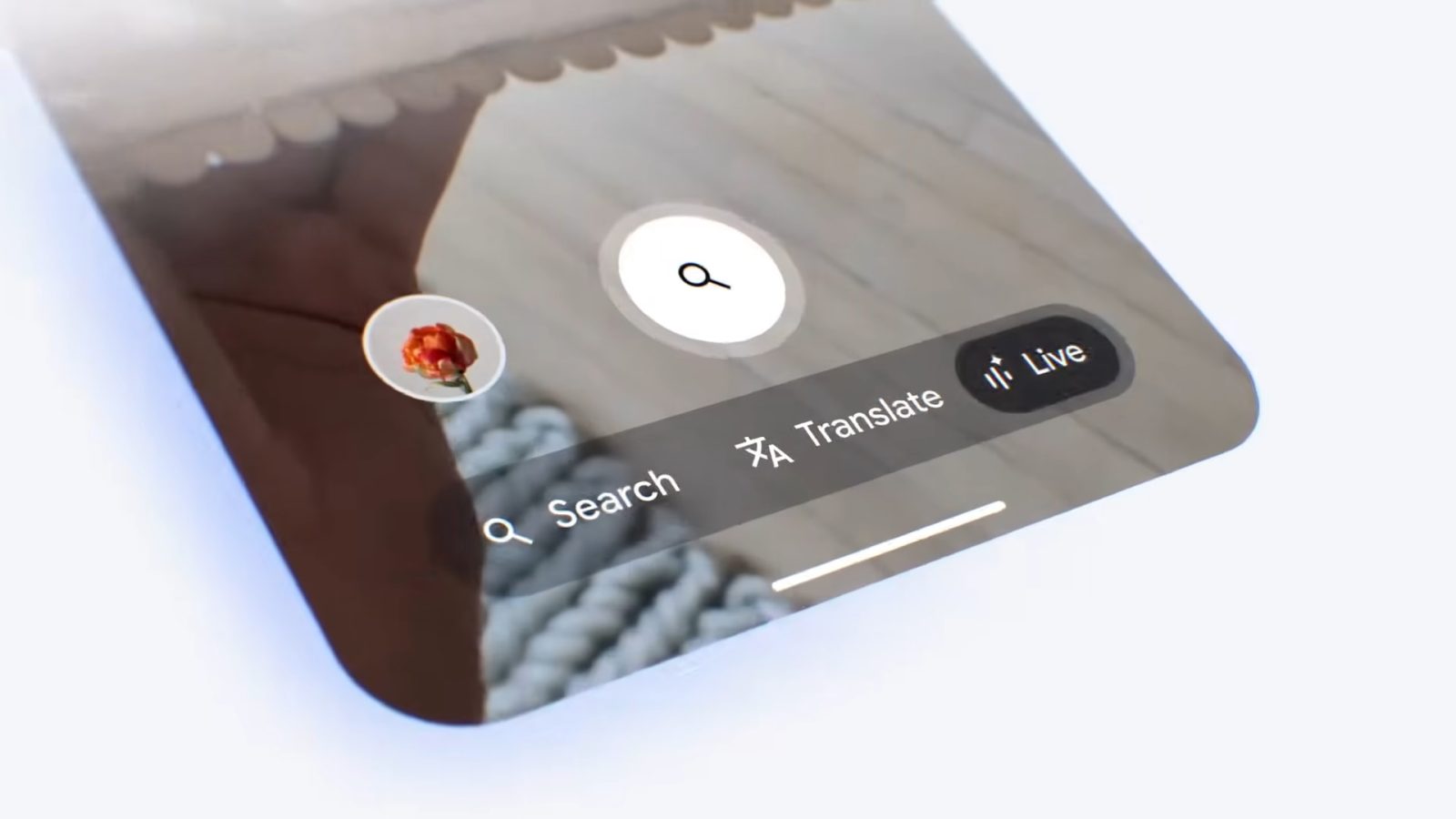

Search Live asimismo está adecuado en Google Lens como parte de un pequeño rediseño que cambia a un visor con pantalla completa. La porción sólida en la parte inferior ahora es una píldora con búsqueda, traducción y vida. (La tarea ha sido reemplazada). Tapping se inicia la búsqueda en vivo directamente a una cámara activa en comparación con los otros métodos de activación de primera voz.

Estamos viendo el modo de cámara de Search Live en varias cuentas estadounidenses inscritas en el test de laboratorios con las últimas versiones de Google App Stable (16.28) y Beta (16.29) en Android.

Rancio contra nuevo

FTC: Utilizamos ingresos que ganan enlaces de afiliados para automóviles. Más.