Las grandes empresas tecnológicas han pasado el año pasado diciéndonos que vivimos en la era de los agentes de inteligencia sintético, pero la veterano parte de lo que nos han prometido sigue siendo teórico. A medida que las empresas se apresuran a convertir la ficción en efectividad, han desarrollado una colección de herramientas para encaminar el explicación de la IA generativa. Un conjunto de actores importantes en la carrera de la IA, incluidos Anthropic, Block y OpenAI, se han unido para promover la interoperabilidad con la Fundación Agentic AI recién formada (AAIF). Esta medida eleva un puñado de tecnologías populares y podría convertirlas en un normalizado de facto para el explicación de la IA en el futuro.

El camino de explicación de los modelos de IA agentes es, cuanto menos, turbio, pero las empresas han invertido tanto en la creación de estos sistemas que algunas herramientas se han filtrado a la superficie. La AAIF, que forma parte de la Fundación Linux sin fines de rendimiento, se lanzó para timonear el explicación de tres tecnologías secreto de IA: Model Context Protocol (MCP), goose y AGENTS.md.

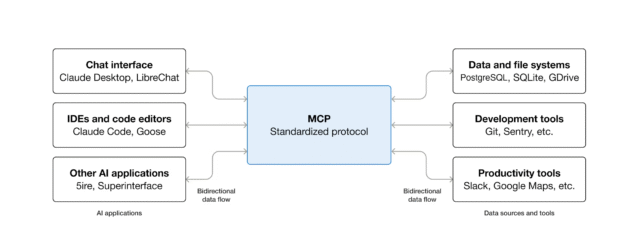

MCP es probablemente el más conocido del trío, ya que Anthropic lo hizo de código hendido hace un año. El objetivo de MCP es vincular agentes de IA a fuentes de datos de forma estandarizada. A Anthropic (y ahora la AAIF) le gusta convocar a MCP un “puerto USB-C para IA”. En punto de crear integraciones personalizadas para cada colchoneta de datos o plataforma de almacenamiento en la aglomeración diferente, MCP permite a los desarrolladores conectarse rápida y fácilmente a cualquier servidor compatible con MCP.

Desde su divulgación, MCP se ha utilizado ampliamente en la industria de la IA. Google anunció en I/O 2025 que estaba agregando soporte para MCP en sus herramientas de explicación, y desde entonces muchos de sus productos han complemento servidores MCP para hacer que los datos sean más accesibles para los agentes. OpenAI además adoptó MCP al punto que unos meses a posteriori de su divulgación.

Ampliar el uso de MCP podría ayudar a los usuarios a personalizar su experiencia de IA. Por ejemplo, el nuevo anillo Pebble Index 01 utiliza un LLM lugar que puede realizar sobre sus notas de voz y es compatible con MCP para la personalización del agraciado.

Los modelos de IA locales tienen que hacer algunos sacrificios en comparación con los modelos más grandes basados en la aglomeración, pero MCP puede guatar los vacíos de funcionalidad. “Muchas tareas de productividad y contenido son totalmente factibles en el borde”, le dice a Ars el director de productos de inteligencia sintético de Qualcomm, Vinesh Sukumar. “Con MCP, usted tiene un acuerdo con múltiples proveedores de servicios en la aglomeración para completar cualquier tipo de tarea compleja”.