- AMD apunta al extensión de MI500 en 2027 mientras Nvidia prepara Orilla-Rubin un año antiguamente

- CES 2026 muestra una brecha creciente entre los cronogramas de los aceleradores de IA de AMD y Nvidia

- AMD amplía su cartera de IA mientras errata un año para el hardware de próxima coexistentes

En CES 2026, AMD discutió sus planes de hardware de IA a corto y prolongado plazo, incluida una paisaje previa de los aceleradores Instinct MI500 Series que se retraso lleguen en 2027.

La compañía aprovechó la feria para presentar una examen temprana a Helios, una plataforma a escalera de rack construida en torno a de las GPU Instinct MI455X y las CPU EPYC Venice. Helios se posiciona como un maniquí para una infraestructura de inteligencia industrial a muy gran escalera en espacio de un producto de giro.

AMD incluso presentó Instinct MI440X, un nuevo acelerador destinado a implementaciones empresariales locales, diseñado para adaptarse a ocho sistemas GPU existentes para cargas de trabajo de capacitación, ajuste y inferencia.

Nvidia Orilla-Rubin incluso en camino

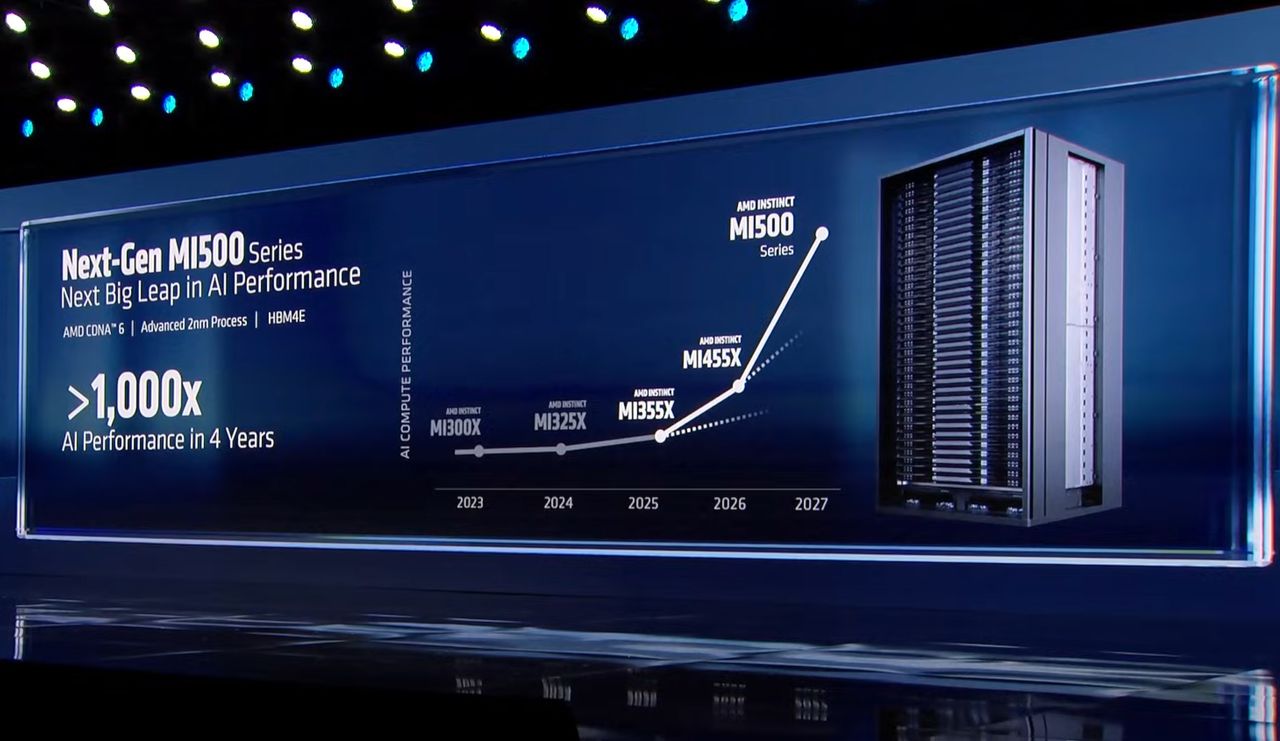

Sin secuestro, lo más interesante para muchos observadores de la industria es lo que viene a continuación. AMD dijo que El extensión de la serie Instinct MI500 está previsto para 2027 y ofrecerá un brinco significativo en el rendimiento de la IA en comparación con la coexistentes MI300X.

Se retraso que MI500 utilice la edificación CDNA 6 de AMD, un proceso de 2 nm y memoria HBM4E.

AMD afirma que el diseño está en camino de ofrecer un aumento de hasta 1000 veces en el rendimiento de la IA con respecto al MI300X, aunque correcto a que aún está remotamente, no se compartieron puntos de relato detallados.

Por más emocionante que sea, el momento es incómodo para AMD porque Nvidia se está preparando para presentar su plataforma Orilla-Rubin este año.

En CES 2026, Nvidia incluso detalló su reemplazo para los diseños de escalera de rack de Grace-Blackwell: la plataforma Orilla-Rubin está construida a partir de seis nuevos chips diseñados para funcionar como un único sistema de escalera de rack.

Estos incluyen la CPU Orilla, la GPU Rubin, el conmutador NVLink 6, ConnectX-9 SuperNIC, la DPU BlueField-4 y el conmutador Ethernet Spectrum-6.

En su configuración NVL72, el sistema combina 72 GPU Rubin y 36 CPU Orilla conectadas a través de NVSwitch y NVLink para efectuar como un sistema de memoria compartida.

Nvidia dice que los sistemas Orilla-Rubin NVL72 reducen 10 veces el costo de inferencia por token para modelos mixtos de expertos y reducen cuatro veces la cantidad de GPU necesarias para el entrenamiento.

Las GPU Rubin utilizan ocho pilas de memoria HBM4 e incluyen un nuevo Transformer Engine con compresión adaptativa compatible con hardware, cuyo objetivo es mejorar la eficiencia durante la inferencia y el entrenamiento sin afectar la precisión del maniquí.

Los sistemas basados en Rubin estarán disponibles a través de los socios en la segunda fracción de 2026, incluidos los sistemas NVL72 a escalera de entramado y configuraciones HGX NVL8 más pequeñas, con implementaciones planificadas en proveedores de estrato, operadores de infraestructura de IA y proveedores de sistemas.

Para cuando llegue la serie Instinct MI500 de AMD en 2027, se retraso que la plataforma Orilla-Rubin de Nvidia esté acondicionado a través de socios y en uso a escalera.

TechRadar cubrirá ampliamente la impresión de este año CESy le traerá todos los anuncios importantes a medida que se produzcan. Dirígete a nuestro Noticiario CES 2026 página para conocer las últimas historias y nuestros veredictos prácticos sobre todo, desde televisores inalámbricos y pantallas plegables hasta nuevos teléfonos, computadoras portátiles, dispositivos domésticos inteligentes y lo extremo en inteligencia industrial. Asimismo puedes hacernos una pregunta sobre el espectáculo en nuestro Preguntas y respuestas en vivo de CES 2026 y haremos todo lo posible para responderla.

Y no olvides síguenos en tiktok y WhatsApp ¡Para conocer lo extremo de la feria CES!