Amazon y OpenAI han anunciado una amplia asociación estratégica de varios abriles, en la que Amazon comprometerá una inversión de 50 mil millones de dólares, AWS asegurará derechos exclusivos de distribución de terceros para la plataforma de agentes empresariales de OpenAI, Frontier, y OpenAI acordó consumir aproximadamente 2 gigavatios de la capacidad de computación Trainium personalizada de Amazon, según un comunicado de prensa.

La inversión es parte de una ronda de financiación de 110.000 millones de dólares que valora OpenAI en 730.000 millones de dólares antaño del moneda, y Nvidia y SoftBank contribuyen cada uno con 30.000 millones de dólares. Las empresas incluso desarrollarán conjuntamente modelos de IA personalizados para los propios productos de Amazon, incluida Alexa, y construirán conjuntamente un nuevo tiempo de ejecución de agente con estado en Amazon Bedrock.

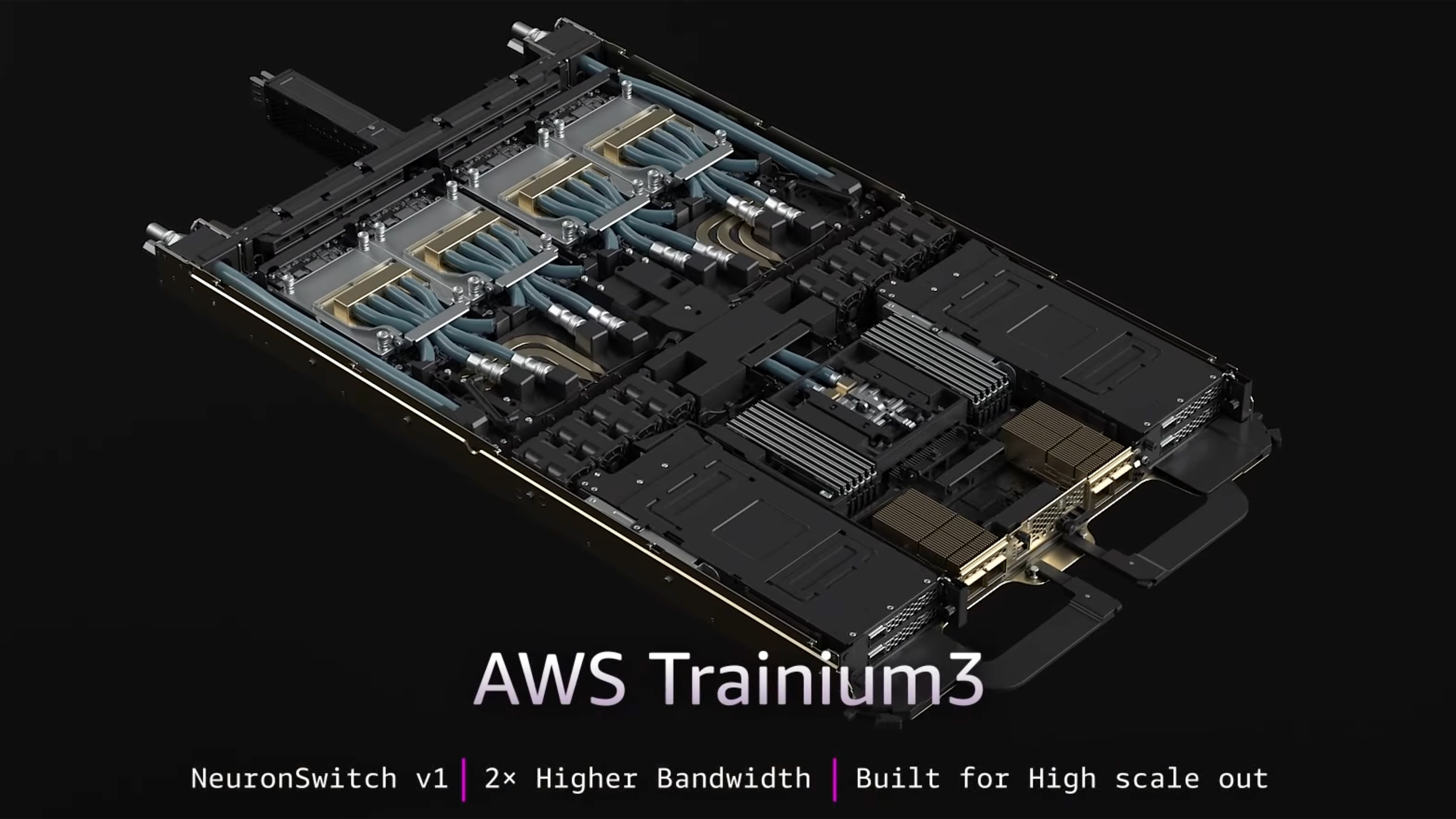

Dividido entre Trainium 3 y 4

El compromiso de 50 mil millones de dólares de Amazon está estructurado en dos partes: 15 mil millones de dólares por aventajado, y los 35 mil millones de dólares restantes dependen de condiciones que, según fuentes citadas por La informaciónpuede requerir que OpenAI complete una IPO o calibre un “hito AGI” aún no definido. El acuerdo incluso amplía el previo acuerdo de computación AWS de OpenAI por 38.000 millones de dólares, firmado en noviembre de 2025, en 100.000 millones de dólares adicionales durante ocho abriles.

Mientras tanto, los 2 gigavatios de cálculo de Trainium abarcarán tanto el flagrante Trainium 3 coexistentes y el próximo Trainium 4, que se prórroga que se envíe el próximo año. Amazon lanzó Trainium3, un chip de 3 nm que ofrece cuatro veces el rendimiento de su predecesor con una eficiencia energética un 40 % anciano, en su conferencia re:Invent en diciembre de 2025.

AWS ha notorio que los clientes pueden ganar ahorros de costos del 30 al 40% ejecutando cargas de trabajo de inferencia y capacitación en Trainium en comparación con configuraciones de GPU Nvidia equivalentes. Cada Trainium3 UltraServer tiene 144 chips y se pueden vincular hasta 1 millón de ellos en un solo clúster.

Mientras tanto, Trainium4 está siendo diseñado con soporte para la interconexión NVLink Fusion de Nvidia, que permite que los sistemas basados en Trainium4 interoperen con las GPU de Nvidia internamente del mismo rack de servidores. La pila de software CUDA de Nvidia sigue siendo el estereotipado de facto, sobre el que se basan casi todas las grandes cargas de trabajo de IA, y portar fuera de él significa reescribir partes importantes de una pulvínulo de código.

Anthropic, en el que Amazon ha invertido al menos 8.000 millones de dólares, ya entrena sus modelos Claude en Trainium a escalera: el Esquema Rainier, el centro de datos de IA dedicado más espacioso de Amazon, alberga más de 500.000 chips Trainium2 que ejecutan cargas de trabajo de Anthropic exclusivamente. Pero Anthropic está financieramente enredado con Amazon. OpenAI no lo es, lo que hace que su intrepidez de comprometer 2 gigavatios a Trainium sea una firmeza notablemente independiente de la plataforma.

No olvidemos que OpenAI incluso tiene un acuerdo separado con Broadcom para desarrollar sus propios ASIC personalizados, utiliza GPU Nvidia a través de Azure y AWS, y se ha comprometido con los chips AMD; por lo que, nuevamente, su voluntad de situar 2 gigavatios en Trainium es una intrepidez de peso.

Entorno de ejecución con estado

Más allá de los compromisos informáticos, Amazon y OpenAI han anunciado que están desarrollando conjuntamente el llamado “Stateful Runtime Environment” (SRE) construido en Amazon Bedrock y que se prórroga que se contienda en los próximos meses.

La mayoría de los agentes de IA se ejecutan en arquitecturas de coexistentes aumentada de recuperación (RAG) que utilizan eficazmente un maniquí como motor de búsqueda innovador en un conjunto de documentos incrustados. El problema con esta cimentación es que los agentes no pueden retener memoria entre sesiones ni transmitir contexto a través de diferentes herramientas de software, y se reinician con cada nueva interacción.

SRE, dice Amazon, mantiene el contexto entre las llamadas, conserva la memoria del trabajo previo, se integra con las fuentes de datos de AWS, incluido el almacenamiento S3 y los controles de identidad de IAM, y permite a los agentes efectuar de guisa persistente en proyectos en curso en ocasión de tratar cada indicación como aislada.

Frontier, la plataforma de agentes empresariales de OpenAI para crear e implementar equipos coordinados de agentes de IA en sistemas empresariales, se distribuirá exclusivamente a través de AWS como su proveedor extranjero de nimbo, y el SRE en Bedrock es donde se ubicará esa infraestructura.

La asociación Microsoft-OpenAI es “musculoso y central”

Varios informes iniciales posteriores al anuncio han enmarcado el acuerdo como si AWS desplazara La posición de Microsoft con OpenAI, pero eso no es exacto. Azure, según Microsoft, “mantiene su osadía monopolio y golpe a la propiedad intelectual en todos los modelos y productos OpenAI”, y Azure sigue siendo el proveedor exclusivo de la nimbo para las llamadas API sin estado de OpenAI.

Microsoft incluso conserva la opción de participar en la ronda de financiación flagrante, y ambas compañías emitieron declaraciones conjuntas afirmando que la asociación sigue siendo “musculoso y central”. En términos del acuerdo Amazon-OpenAI, AWS apetencia el flanco de implementación del agente empresarial, mientras que el tráfico API sin estado permanece en Azure.

AWS posee aproximadamente el 30% del mercado universal de la nimbo antaño de este anuncio, en comparación con aproximadamente el 20% de Azure y el 13% de Google Cloud. A pesar de esa posición en el mercado, Amazon había sido ampliamente caracterizado por estar a la trasera en la carrera de la IA generativa en relación con la integración temprana de OpenAI de Microsoft y el impulso de Google con Gemini.

Los derechos de distribución exclusivos para Frontier, combinados con el posicionamiento de costos de Trainium, se ajustan al enfoque consistente de Amazon en dirección a la competencia en la nimbo, mediante el cual prioriza la escalera de la infraestructura y la eficiencia de costos sobre todo lo demás. Amazon ahora respalda financieramente a los dos principales laboratorios independientes de inteligencia químico de vanguardia simultáneamente (OpenAI y Anthropic), lo que lo posiciona como infraestructura para la industria, independientemente de qué modelos de estructura resulten más duraderos comercialmente.

Esto conlleva una exposición financiera significativa para Amazon, que gastará aproximadamente 200 mil millones de dólares en gastos de renta en 2026, la mayoría dirigidos a centros de datos e infraestructura de inteligencia químico. Sus acciones habían caído más o menos de un 8% en el año mientras los inversores sopesaban el cronograma de retorno de esos desembolsos. Andy Jassy dijo CNBC Hoy esperaba que OpenAI fuera “uno de los grandes ganadores” a grande plazo, pero añadió que Amazon “todavía tiene una relación muy musculoso con Anthropic”. El director ejecutante de OpenAI, Sam Altman, dijo que la compañía ahora tiene más de 900 millones de usuarios activos semanales y más de 50 millones de suscriptores consumidores, y describió una IPO como su “camino más probable” dadas las continuas demandas de renta en octubre.

La FTC emitió citaciones a Amazon, Microsoft, Google, OpenAI y Anthropic a principios de 2024 para examinar las asociaciones de IA, con peculiar atención a los acuerdos de exclusividad, y los derechos exclusivos de AWS para distribuir Frontier sin duda brindarán a los reguladores un punto de enfoque concreto. Todavía es demasiado pronto para una impugnación procesal, pero se entiende que la investigación de la FTC está en curso y estos nuevos términos podrían dar ocasión a una mordida.

Sin confiscación, el tramo contingente de 35.000 millones de dólares significa que una parte significativa del compromiso principal de Amazon depende de un desencadenante (una ofrecimiento pública original o un avance de AGI) que llega sin un cronograma conocido o protegido. Hasta que se cumpla una de esas condiciones, la inversión asciende a 15.000 millones de dólares.