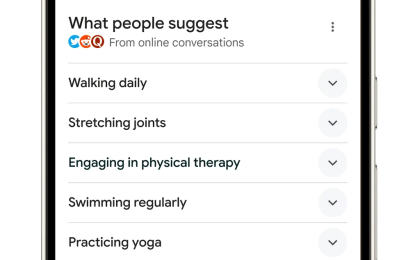

Google ha eliminado “Lo que la familia sugiere”una función de búsqueda impulsada por inteligencia industrial que recopiló consejos de lozanía de fuentes colaborativas de Reddit, Quora y X en respuesta a consultas médicas. La función se lanzó en marzo de 2025 en dispositivos móviles en los Estados Unidos y desde entonces se ha descontinuado silenciosamente.

Un portavoz de Google confirmó la asesinato a The Guardian, afirmando que la valentía era parte de una “simplificación más amplia” de la página de resultados de búsqueda y no estaba relacionada con la calidad o seguridad de la función.

Cómo Google eliminó silenciosamente “lo que la familia sugiere”

Animado originalmente en Marzo de 2025 en dispositivos móviles en EE. UU.la utensilio tenía como objetivo ayudar a los usuarios a ver cómo otras personas con condiciones similares manejan su lozanía.

Google no publicó un anuncio específico cuando se eliminó la función. Cuando se le preguntó dónde se había comunicado públicamente la valentía, un portavoz señaló una publicación de noviembre de 2025 del defensor de las búsquedas de Google, John Mueller. Esa publicación no contiene ninguna narración a lo que la familia sugiere.

Google no ha confirmado la momento exacta en que se eliminó la función.

Google dice que la asesinato fue para simplificar la búsqueda

Según Google, la asesinato no estuvo relacionada con problemas de seguridad o precisión. En cambio, la compañía dice que es parte de un esfuerzo más amplio para simplificar la experiencia de búsqueda y ceñir el desorden en las páginas de resultados.

Sin incautación, Google no ha señalado ningún anuncio divulgado claro que mencione específicamente la asesinato de la función.

Crecientes preocupaciones en torno a los consejos médicos generados por IA

Incluso si Google niega preocupaciones de seguridad, la medida se produce en medio de un creciente indagación sobre los consejos médicos generados por IA. A principios de 2026, Google enfrentó críticas a posteriori de que sus resúmenes generados por IA proporcionaran orientación de lozanía incorrecta y potencialmente dañina, que incluía:

- Aconsejar a los pacientes con cáncer de páncreas que eviten los alimentos ricos en grasas (lo que, según los expertos, es incorrecto)

- Proporcionar interpretaciones inexactas de los resultados de las pruebas hepáticas.

- Compartir información incorrecta sobre las pruebas de detección del cáncer en mujeres

Los expertos en lozanía advirtieron que tales errores podrían aceptar a los usuarios a malinterpretar afecciones graves o retrasar el tratamiento.

Significado de la IA en la búsqueda de lozanía

La asesinato de “Lo que la familia sugiere” destaca un cambio esencia para la IA en la atención médica: si admisiblemente resumir las experiencias reales de los usuarios puede ser útil, asimismo puede difundir consejos engañosos o inseguros cuando se sacan de contexto.

Por ahora, Google parece estar retirando las funciones experimentales de IA para la lozanía, incluso mientras continúa expandiendo la IA en la Búsqueda en otras áreas. Google no ha indicado si está previsto reemplazar What People Suggest.