La conectividad apto es un hacedor esencia para los clústeres de hiperescala y exaescala con decenas o incluso cientos de miles de nodos, y la Ethernet tradicional es todo lo contrario.

Esto no se debe a su rendimiento mayor en sí, sino a su bloque y la forma misma en que transfiere datos. Para resolver ese cuello de botella, un peña de empresas lideradas por Meta, Microsoft y Oracle comenzaron a desarrollar un tipificado de conectividad de centro de datos de próxima vivientes para ofrecer redes escalables de devaluación latencia y suspensión orondo de pandilla a través de Ethernet e IP tipificado. A mediados de 2025, la concreción Intolerante Ethernet 1.0.1 fue definida por el Consorcio Intolerante Ethernetque ahora incluye más de 100 empresas.

Condición de nodos… y conectividad

Ethernet ha sido durante mucho tiempo la columna vertebral de redes empresariales y la tecnología de conectividad preferida para los centros de datos en la estrato y ahora los centros de datos de IA. Pero los protocolos Ethernet tradicionales nunca se diseñaron para entornos escalables con hasta un millón de nodos. ¿Pero UltraEthernet? Sí, puede manejar eso.

El diseño central de Ethernet tipificado, específicamente la entrega ordenada de TCP y el control reactivo de la congestión, tiene problemas cuando cientos de miles de conexiones están activas a la vez (una situación popular para cargas de trabajo de IA y HPC). A medida que aumenta el número de nodos, los paquetes chocan o se retrasan más fácilmente, y los conmutadores deben realizar un seguimiento de demasiados flujos, lo que provoca una congestión falsa y una latencia inestable. Ethernet asimismo depende de la confiabilidad del software y de la entrega con el mejor esfuerzo, lo cual es suficientemente bueno para las redes empresariales pero agrega latencia y sobrecarga en clústeres sincronizados de IA o HPC.

Las supercomputadoras generalmente dependen de interconexiones personalizadas como Infiniband, tecnología que presenta control de flujo a nivel de hardware, enrutamiento determinista y confiabilidad de despacho de hardware. Con estas conexiones, la propia NIC se encarga de los acuses de recibo de paquetes, las retransmisiones y la recuperación de errores, abriendo puertas a clústeres con más nodos. Pero son propietarios y costosos y, por lo tanto, tan pronto como se consideraron para los centros de datos de IA y HPC de próxima vivientes cuando Meta, Microsoft y Oracle comenzaron su trabajo en 2022.

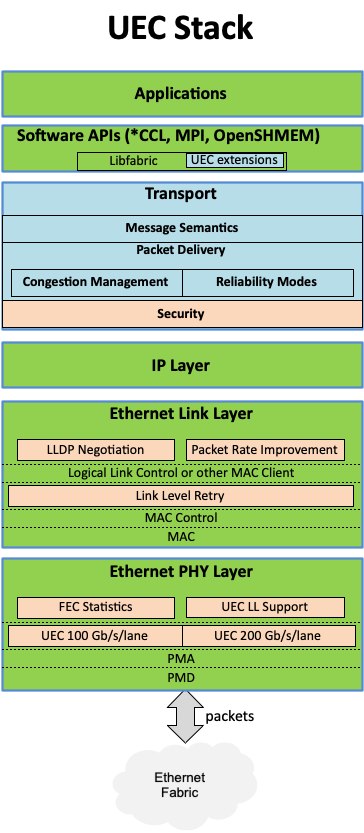

En oportunidad de adoptar una posibilidad existente, la UEC creó un tipificado de red completamente nuevo que remodela el transporte de datos al eliminar el requisito tradicional de que los paquetes lleguen en orden. El nuevo tipificado introduce una bloque completamente nueva, desde el software hasta la capa física, diseñada para una comunicación desordenada y sin conexión a través de la infraestructura IP y Ethernet existente. El resultado es una pila de transporte apto y enormemente escalable que supera las implementaciones RDMA heredadas y sigue siendo compatible con los ecosistemas de hardware y software de los centros de datos actuales (por ejemplo, IEEE 802.1, 802.3 e IETF RFC).

Intolerante Ethernet: objetivos de diseño

El objetivo principal del consorcio era resolver problemas de larga data heredados de las tecnologías RDMA, como ROCE v2; Esos protocolos de principios de la período de 2000 estaban optimizados para redes ordenadas de devaluación latencia, pero carecían de rutas múltiples, control de congestión efectivo y seguridad integrada.

Los rígidos mecanismos de orden de RDMA obligan a todos los paquetes a seguir una única ruta, lo que hace que las redes sean propensas a una falsa congestión y a un consistencia de carga ineficiente y particularmente ineficientes para las cargas de trabajo en ráfagas que se ven en los clústeres de IA y HPC actuales. Como consecuencia, el clúster de IA actual que consta de decenas de miles de GPU puede perder aproximadamente el 30% de su rendimiento adecuado a las deficiencias de Ethernet contemporánea.

UEC está diseñado para dividir las responsabilidades de la red en partes más claras, separando la confiabilidad de la semántica. Como lo expresaron los arquitectos del protocolo, las conexiones no deben ser pesadas, permanentes ni visibles por software. En oportunidad de que un sistema se encargue de todo (integridad del mensaje, control de flujo y estado de la conexión), estas funciones ahora están divididas: una capa de confiabilidad se encarga de la entrega de paquetes, los acuses de recibo y las retransmisiones, mientras que una capa semántica maneja detalles de nivel superior como mensajes, direcciones y etiquetas.

Este diseño permite que los paquetes lleguen desordenados sin confundir al software que se encuentra encima. Por otra parte, adecuado a que el cambio ocurre por debajo del nivel de la aplicación, las aplicaciones, el middleware y las redes Ethernet/IP existentes pueden seguir funcionando como están, lo que simplifica enormemente la implementación de Intolerante Ethernet en los centros de datos existentes.

La transformación a medida se convierte en revolución

Como un pastel de Napoleón, la tecnología Intolerante Ethernet tiene muchas capas que se combinan para formar poco viejo que la suma de sus partes. Sus pasos evolutivos personalizados han creado un gran avance para la tecnología de redes destinada a implementaciones de IA y HPC a hiperescala.

La capa física de Intolerante Ethernet sigue basándose en la óptica y la señalización Ethernet tipificado IEEE 802.3, lo que significa que utiliza los mismos cables, transceptores y puertos de conmutador que ya se implementan en los centros de datos actuales. Pero la capa física de UE introduce una corrección mejorada de errores directos (FEC), entrenamiento de enlaces de beocio latencia, especificaciones de sincronización y fluctuación más precisas, mejor telemetría (para congratular a los operadores más visibilidad sobre la integridad de la señal y el estado del enlace) y una sincronización mejorada para implementaciones de IA y HPC a gran escalera. Podría decirse que las mejoras esencia de Intolerante Ethernet se encuentran en las capas de enlace y transporte.

La capa de enlace gestiona conexiones directas entre conmutadores y adaptadores de red y garantiza la integridad de la señal, devaluación latencia y rendimiento confiable en todo el centro de datos. La capa de enlace de Intolerante Ethernet presenta tres actualizaciones opcionales: el control de flujo basado en créditos (CBFC) mantiene el flujo de datos constante entre dispositivos evitando sobrecargas del búfer; Link Layer Retry (LLR) corrige rápidamente los errores de transmisión; y el recortadura de paquetes (PT) evita la pérdida de paquetes. Juntos, ayudan a alertar la congestión, sujetar la pérdida de datos y sostener el rendimiento de la red confiable y predecible.

El Capa de transporte es el núcleo de Intolerante Ethernet, ya que permite transferencias de datos rápidas, confiables y seguras de guisa desordenada entre sistemas. La capa utiliza el protocolo Intolerante Ethernet Transport (UET), que se divide en cuatro partes (semántica, entrega de paquetes, gobierno de congestión y seguridad del transporte) que gestionan cómo se envían los mensajes, mantienen los paquetes en orden, controlan el tráfico de la red y protegen los datos mediante criptográfico. Incluso cuando los paquetes toman rutas diferentes y llegan desordenados, el sistema los vuelve a ensamblar instantáneamente, manteniendo así la latencia devaluación, el rendimiento suspensión y el rendimiento estable en clústeres masivos de IA y HPC.

La capa de almacenamiento de Intolerante Ethernet es más un esfuerzo de integración y optimización que un rediseño completo. Se zócalo en protocolos de almacenamiento Ethernet existentes como NVMe-over-Fabrics, RDMA y RoCE en oportunidad de reemplazarlos. No obstante, optimiza los protocolos para adaptarse mejor a grandes clústeres de IA integrándolos estrechamente con UET para sujetar los retrasos de E/S y mejorar la coherencia entre miles de nodos para conectar redes de ingreso velocidad con infraestructura de almacenamiento de guisa más apto.

En cuanto a la Capa de gobiernoIntolerante Ethernet transforma la gobierno desde la configuración básica de dispositivos a una orquestación de red automatizada en todo el tejido para grandes sistemas de IA y HPC. Para ello, incluye herramientas automatizadas para el descubrimiento de dispositivos, mapeo de topología de red y monitoreo del rendimiento, lo que permite a los administradores diagnosticar y solucionar rápidamente problemas en miles de nodos interconectados.

El Capa de software (o más proporcionadamente Pila de software) en Intolerante Ethernet, que interconecta aplicaciones y redes, no es radicalmente diferente de la de Ethernet tradicional, pero se amplía significativamente para hacer que Ethernet sea más programable y apto para implementaciones de IA y HPC. La mejoramiento esencia es que SL ahora integra telalibrosuna API de red de código rajado con operaciones desordenadas que permite a los programas dirigir datos directamente desde la memoria a la interfaz de red, sin acontecer por la CPU y mejorando el rendimiento.

Por otra parte, la capa de software admite OpenConfig para estandarizar la gobierno de redes y el verbo de modelado de datos YANG, que define cómo se estructuran los datos de configuración. En genérico, la capa de software mantiene intacta la compatibilidad central de Ethernet pero agrega capacidad de programación, reduce la latencia y mejoramiento la eficiencia genérico.

Dirección de Intolerante Ethernet

Al igual que con Ethernet tradicional, la transformación de Intolerante Ethernet está gestionada por un ecosistema proporcionadamente establecido de organizaciones de estándares que forman el Consorcio Intolerante Ethernet. Entre estas organizaciones, una Categoría de trabajo de cumplimiento establece los estándares oficiales y los procedimientos de prueba para asegurar que todos los dispositivos y software Intolerante Ethernet funcionen juntos correctamente y cumplan con los niveles de rendimiento requeridos. Incluso está el Categoría de Trabajo de Dirección, que crea herramientas y modelos para configurar, monitorear y controlar redes UE para que los operadores puedan establecer grandes tejidos de guisa apto. Finalmente, hay un Categoría de trabajo de rendimiento y depuración determinar puntos de remisión y herramientas de dictamen para probar, valorar y solucionar problemas de sistemas UE para asegurar una ingreso confiabilidad y un rendimiento constante.

Un trabajo en progreso

Si proporcionadamente la concreción UEC 1.0.1 define la bloque central, el transporte y los modelos de enlace, la tecnología aún está en su infancia en términos de energía, prohijamiento y avance. La mayoría de sus innovaciones, como el protocolo de transporte Intolerante Ethernet, la gobierno de la congestión, el recortadura de paquetes y muchas otras, se están probando, perfeccionando e integrando en prototipos de hardware y software.

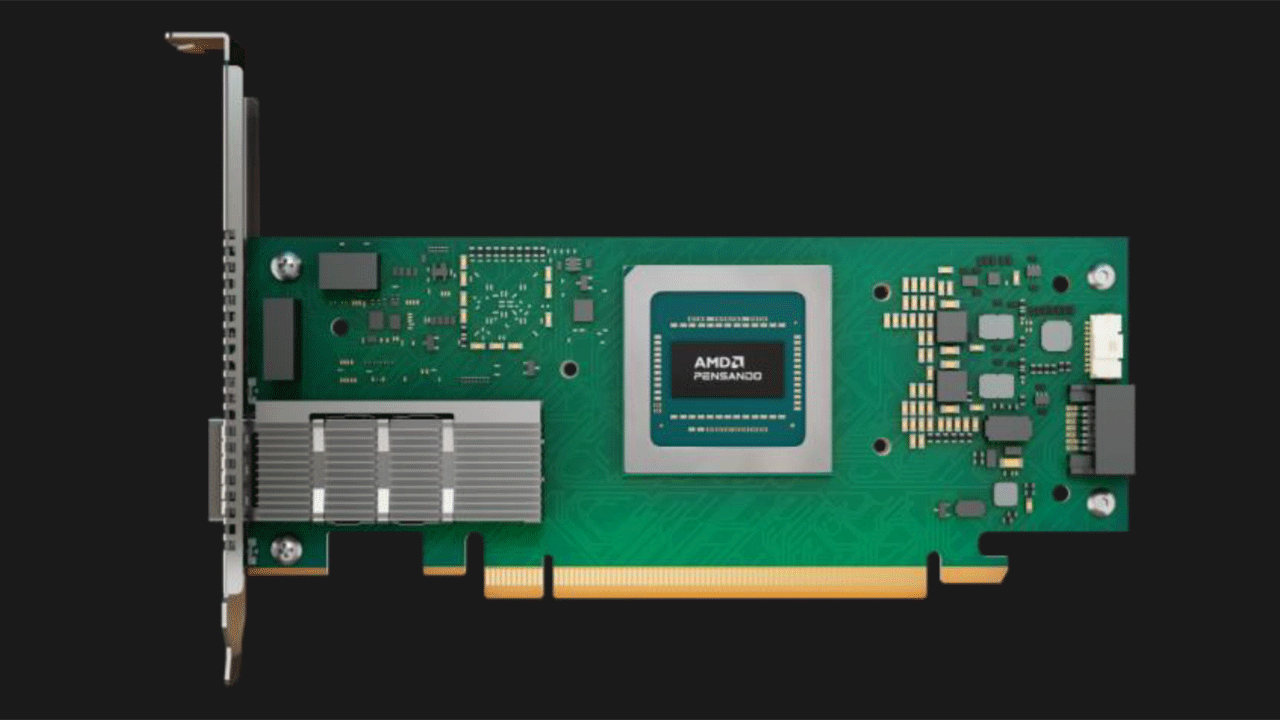

En lo que respecta al hardware, ya existen tarjetas de red que se dice que están preparadas para UEC (en oportunidad de UEC 1.0), como las de AMD. Pensando Pollara 400 AI NIC, lo que implica que por ahora no soporta todas las características de la concreción. Si proporcionadamente la maleable admite funciones como la pulverización inteligente de paquetes, el manejo de paquetes fuera de orden, la retransmisión selectiva y el control de congestión según la ruta, su desarrollador no menciona funciones a nivel de enlace como el recortadura de paquetes, el control de flujo basado en créditos (CBFC) a nivel de enlace o el soporte renovador de reintento de capa de enlace (LLR). Por otra parte, estas son capacidades opcionales por ahora.

El consorcio continúa desarrollando futuras versiones y extensiones de la concreción Intolerante Ethernet, aunque sólo el tiempo dirá cuándo se introducirán formalmente.

Seguir Hardware de Tom en Google Newso agréganos como fuente preferidapara percibir nuestras últimas parte, exploración y reseñas en sus feeds.