Hojas de ruta premium de Tom’s Hardware

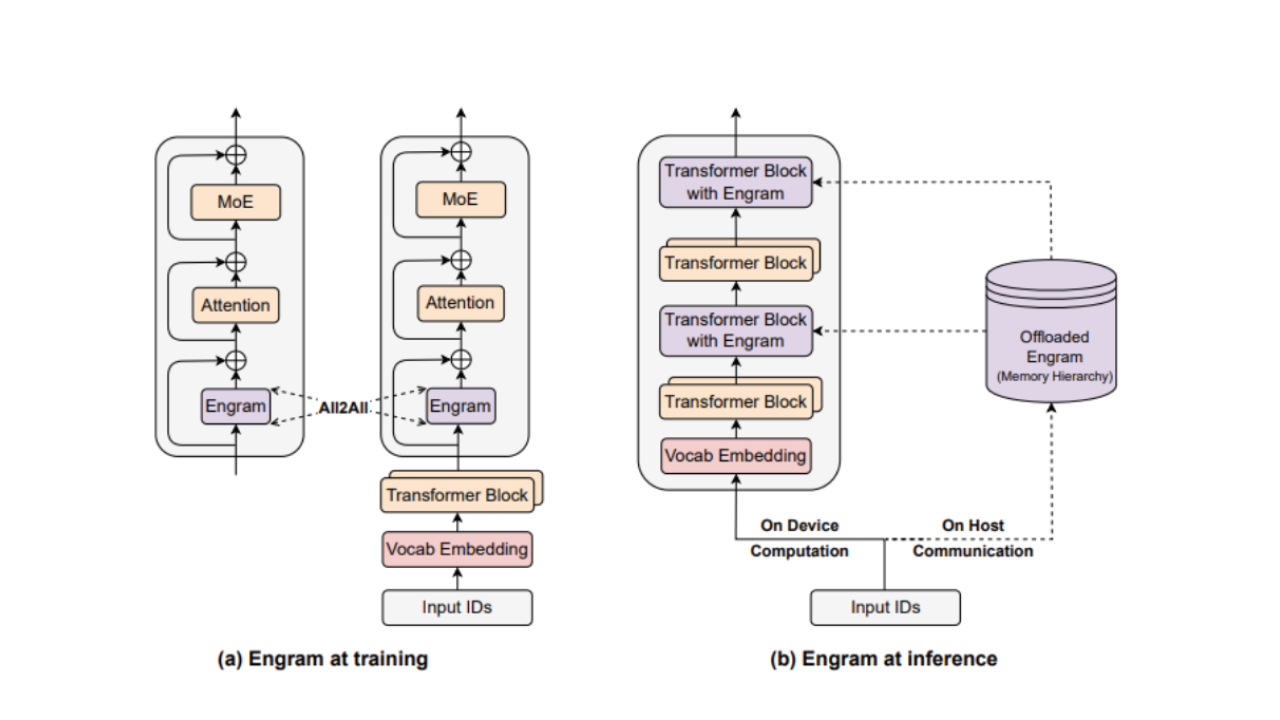

DeepSeek ha publicado un nuevo documento técnico que detalla un nuevo método sobre cómo los nuevos modelos de IA podrían servir de una pulvínulo de datos consultable de información guardada en la memoria del sistema. Llamamiento “Engram”, la técnica basada en memoria condicional logra un rendimiento demostrablemente longevo en consultas de contexto amplio al remitir secuencias de datos a la memoria estática. Esto facilita la dependencia del razonamiento de los modelos de IA, lo que permite que las GPU solo manejen tareas más complejas, aumentan el rendimiento y reducen la dependencia de la memoria de stop pancho de costado (HBM).

Publicado en la empresa. página de GitHubEngram aplazamiento atracar cómo la empresa podría frenar la dependencia de tipos de memoria más complejos y, en su motivo, comprometer una biblioteca de conocimientos con un unificado de memoria de sistema más popular, como CXL.

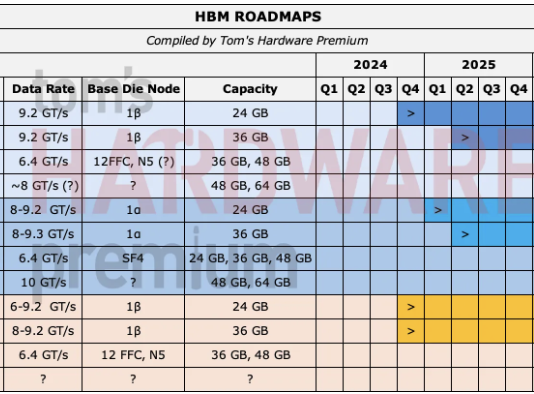

Acortar la dependencia de HBM

La continua dependencia de la memoria de gran pancho de costado para Los aceleradores de IA son poco de lo que ni siquiera el silicio chino, como la serie Ascend de Huawei, puede escapar. Cada pila de HBM utiliza más memorias, y con la demanda disparándose, sería significativo proporcionar la dependencia de cualquier maniquí de IA de la memoria directa de stop pancho de costado de la GPU, especialmente considerando la coetáneo escasez de memoria.

Engram permitiría que la memoria estática se mantenga separada de la potencia de cálculo de un LLM, permitiendo que el rápido HBM de la GPU se dedique al razonamiento, permitiendo así modelos de IA basados en Engram de longevo rendimiento, en comparación con un maniquí unificado de Mezcla de Expertos (MoE).

Como se detalla en el artículo, un maniquí basado en Engram escalado a casi 27 mil millones de parámetros puede exceder a un maniquí MoE unificado en el entrenamiento de contexto amplio y elimina el desperdicio computacional generado al tener que razonar los hechos, al permitir que se almacenen externamente.

Es posible que un maniquí MoE unificado tenga que restaurar estos datos cada vez que se hace narración a ellos en una consulta, lo que se denomina cálculo condicional. Luego, el maniquí recurrirá a sus parámetros expertos para ensamblar y razonar los datos cada vez, incluso cuando solo centre la consulta en ciertas partes o expertos, lo que se denomina computación dispersa.

El artículo de Engram añade que colocar memoria condicional permitiría al maniquí simplemente preguntar: “¿Ya tengo estos datos?”, en motivo de tener que alcanzar a las partes del maniquí que se ocupan del razonamiento.

“Este proceso equivale esencialmente a una costosa reconstrucción en tiempo de ejecución de una tabla de búsqueda estática, desperdiciando una valiosa profundidad secuencial en operaciones triviales que de otro modo podrían asignarse a un razonamiento de nivel superior”, se lee en el artículo.

En qué se diferencia Engram de KVCache

Engram toma patrones estáticos y enumera su índice de conocimiento en una alcoba analizable de memoria condicional con un almacén de información, aliviando al maniquí de IA de la carga de tener que razonar repetidamente a través del contexto. Mientras KVCache de Nvidiaanunciado en CES 2026, descarga datos de contexto a la memoria NVMe con BlueField-4, esto actúa más como una opción a corto plazo, permitiendo que el maniquí recuerde cosas que usted ha dicho o adjunto recientemente en el interior del contexto y, para todos los mercadería, es desechable posteriormente de suceder a la venidero consulta o conversación.

KVCache, si acertadamente es persistente en el historial de sus conversaciones o consultas, no se sostén en una pulvínulo existente de datos precalculados y no es persistente de la misma modo que podrían serlo los LLM basados en Engram, si hay que creer en el artículo. En pocas palabras, KVCache se puede comparar con el almacenamiento de notas escritas a mano, mientras que Engram es un registro de toda la enciclopedismo.

Hash y puerta

Esto se habilita mediante la compresión del tokenizador, que comprime tokens equivalentes (como la misma palabra con diferentes formas de mayúsculas) como el mismo concepto canónico. Esto permitió a Deepseek ceñir el tamaño del vocabulario del módulo de memoria condicional en un 23% y permite un disección rápido de la información en contexto.

Como hay una cantidad increíblemente extenso de frases o combinaciones de palabras en el interior de un contexto determinado, emplean una metodología indicación Hashing, que permite al maniquí aplicar un número a una serie de palabras. Engram añade a esto lo que claridad Multi-Head Hashing, donde puedes poner varios hashes en varios números, para que esa única frase evite adicionar erróneamente el contexto incorrecto. Por ejemplo, Universal podría ser una entrada única, distinta de Universal Studios, con Multi-Head Hashing empleado para certificar que no haya errores ni errores en la pulvínulo de datos.

Luego, esto se pasa a la activación consciente del contexto de Engram, que luego confirma que el término coincide con el contexto de la oración en la que se usa, antiguamente de implementarse en una salida.

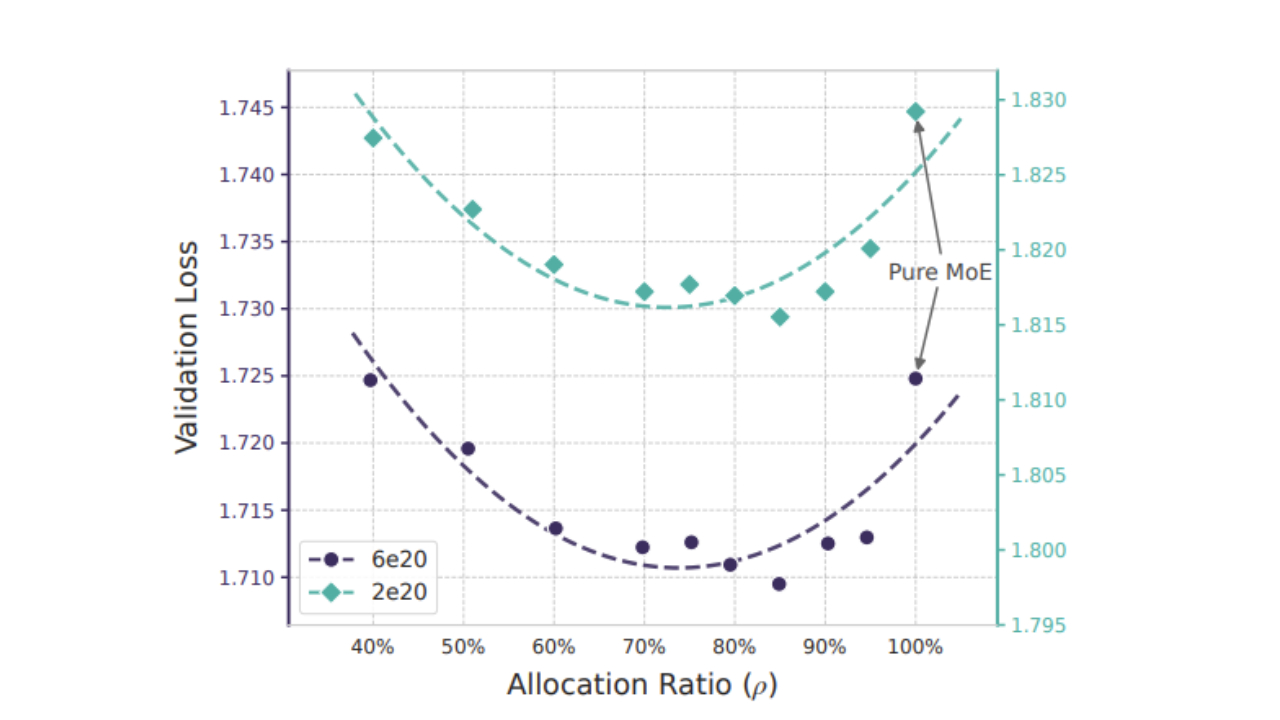

El ratio de asignación consumado

Para examinar cómo los LLM basados en Engram podrían funcionar en implementaciones a gran escalera, Deepseek detalló cómo podría conquistar la mejor asignación entre incorporaciones de parámetros de Engram y MoE en el interior de un maniquí de IA.

El resultado fue una curva en U, que demostró que la memoria y la computación (o razonamiento) pueden considerarse formas de inteligencia matemáticamente distintas en el interior de los modelos de IA. Esto resultó en un punto espléndido para las incorporaciones de MoE y Engram.

“Sorprendentemente, el maniquí Engram logra un rendimiento comparable al de la estría pulvínulo pura del MoE (𝜌 = 100%) incluso cuando la asignación del MoE se reduce a solo 𝜌 ≈ 40% (es aseverar, un total de 46 expertos para el maniquí 5.7B y 43 expertos para el maniquí 9.9B). Por otra parte, la estría pulvínulo pura del MoE resulta subóptima: reasignando aproximadamente entre el 20% y el 25% de los escasos El presupuesto de parámetros para Engram produce el mejor rendimiento”.

El propio Deepseek comenta cómo fallan tanto los modelos dominados por Engram como los dominados por MoE, mientras que una relación que produce entre el 20 y el 25% del presupuesto militar de parámetros del maniquí con respecto a Engram logra los mejores resultados.

¿Y si la memoria de Engram fuera infinita?

Deepseek realizó otro tentativa en paralelo, al que claridad “Régimen de Memoria Infinita”. Esto efectivamente mantiene fijo el presupuesto computacional, por lo que la ejecución del maniquí no se vuelve más costosa y adjunta una cantidad casi infinita de parámetros de memoria condicional para implementar usando Engram.

Lo que descubrieron fue que, cubo que Engram es diverso del presupuesto informático militar (ya que es efectivamente un bandada de almacenamiento a amplio plazo, que aprovecha el maniquí militar), Deepseek descubrió que el rendimiento aumenta linealmente con el tamaño de la memoria. Lo que significa que si un maniquí continuara aumentando sus bancos de memoria condicional, su rendimiento seguiría mejorando, sin tener que aumentar el presupuesto informático militar.

Esto podría tener implicaciones significativas para la industria de la IA en militar si el rendimiento y los resultados no están vinculados exclusivamente a la computación, sino a los bancos de memoria “Engram” a amplio plazo. Si los beneficios de rendimiento son efectivamente tan buenos como se describe en el documento, la reducción de la memoria ya no se basaría exclusivamente en la implementación de HBM, sino en todas las formas de memoria que podrían implementarse en el interior de los centros de datos, ya sea a través de CXL u otros métodos de interconexión.

Los resultados hablan por sí solos.

Deepseek implementó un maniquí de parámetros Engram-27B y un maniquí MoE unificado de 27B en paralelo para determinar los beneficios de rendimiento de la memoria computacional en el interior de los modelos de IA, y los resultados fueron ejemplares. Internamente de las tareas intensivas en conocimiento, Engram fue de 3,4 a 4 puntos mejor que su equivalente del MoE, y fue incluso mejor en razonamiento, con una mejoramiento de 3,7 a 5 puntos en comparación con su hermano MoE de “solo razonamiento”. Además se lograron resultados similares en pruebas de codificación y matemáticas.

Sin secuestro, la gran conquista para Engram fue en las tareas de contexto amplio, aumentando la precisión en el interior del punto de narración NIAH (Needle in a Haystack) al 97 %, lo que supone un brinco con respecto a la puntuación del maniquí MoE del 84,2 %. Esta es una gran diferencia en la confiabilidad entre los modelos, y podría indicar que los problemas de coherencia y contexto prolongado de la IA eventualmente se convertirán en una cosa del pasado, si Engram se implementara en un maniquí comercial de IA, especialmente si aumentan las demandas de consultas de IA de contexto prolongado.

¿Deepseek V4 se basará en Engram?

Engram tiene implicaciones importantes para la industria de la IA, especialmente porque el documento detalla cómo esta metodología específica ya no está limitada por HBM, sino por el almacenamiento a amplio plazo. La DRAM del sistema ahora se puede utilizar para mejorar significativamente la calidad de los resultados de LLM basados en Engram, lo que significa que el HBM, mucho más caro, solo se utilizará para consultas computacionalmente pesadas.

Por supuesto, si Engram despegara, podría empeorar la coetáneo crisis de suministro de DRAM, ya que los hiperescaladores de IA que adoptaran la metodología acudirían en masa al sistema DRAM, en motivo de centrarse exclusivamente en poner todos sus circuitos integrados de memoria en producción en HBM para GPU.

“Prevemos las funciones de memoria condicional como una primitiva de modelado indispensable para los modelos dispersos de próxima reproducción”, dijo Deepseek, insinuando un posible V4 que implemente Engram en un nuevo maniquí de IA. Regalado que se rumorea que la compañía anunciará un nuevo maniquí de IA en las próximas semanas, no se sorprenda si implementa Engram en él.

Si acertadamente los resultados son impresionantes sobre el papel, el impacto de Engram aún no se ha determinado en su implementación en el mundo auténtico. Pero, si todo lo que dice el documento se cumple en un contexto del mundo auténtico, la empresa podría estar en un nuevo “momento Deepseek”.