Es de sombra y decides salir a cenar. Puede que tu pareja no sepa qué quieres ingerir, pero la inteligencia fabricado sí: en la tarde te vio mirando videitos de tacos y tiene claro que ahora no puedes dejar de pensar en ello.

«Si no tomamos decisiones, otros lo harán por nosotros», escribe la periodista y escritora española Laura G. De Rivera en su ejemplar «Esclavos del cálculo: Manual de resistor en la era de la inteligencia fabricado», fruto de abriles de investigación.

«Vivimos inmersos en pensamientos, deseos y sentimientos impuestos desde fuera porque resulta que los humanos somos asaz predecibles. Puntada con aplicar la estadística a nuestras acciones pasadas, y es como si algún nos leyera la mente», continúa.

La finura en predecir cuáles son nuestras deyección o deseos es tanta que Michal Kosinskipsicólogo y profesor de la Universidad de Stantford, demostró en sus experimentos que un cálculo perfectamente entrenado con suficientes datos digitales puede predecir qué quieres o qué cosas te gustan mejor que tu hermana.

Que la inteligencia fabricado pueda anticipar con altísima precisión los intereses de una persona, en principio, suena perfectamente. Pero tiene un precio, dice De Rivera, y es detención: «Perdemos osadía, perdemos la capacidad de ser nosotros mismos, perdemos imaginación«.

«Trabajamos gratuito para Instagram subiendo nuestras fotos para que la red social exista y gane millones. Hay que ser consciente y exprimir los beneficios de las plataformas sin que los riesgos te hagan daño», dice.

Charlamos con De Rivera en el situación del Hay Festival que se celebra del 6 al 9 de noviembre en la ciudad peruana de Arequipa, un evento que reúne a 130 participantes de 15 países.

Puedes analizar: Conferencia de Ramonet: ¿Cómo enfrentamos la manipulación informática?

¿Cuál es la opción para no ser esclavos del cálculo?

La opción que yo veo es muy sencilla, está al difusión de cualquier persona, es gratuito y no tiene impacto medioambiental. Y es simplemente pensar. O sea, utilizar nuestro cerebro. Es una capacidad humana que está en desuso, se ha perdido.

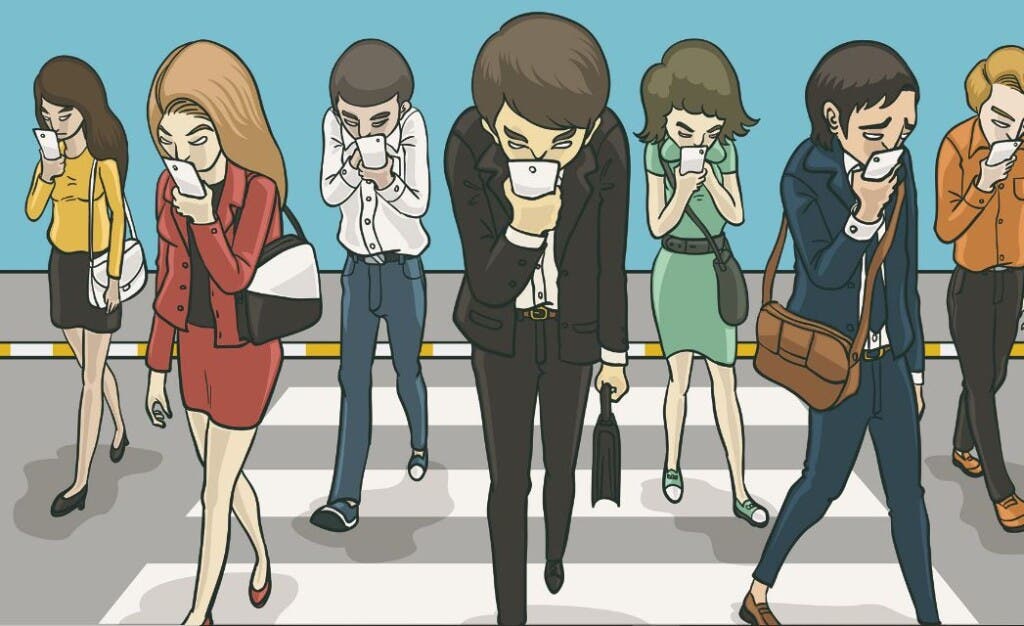

Cada momento en el que no estamos trabajando o con gentío, lo que hacemos es coger el teléfono y distraernos con la pantalla. Ya no pensamos en la sala de demora del médico ni cuando nos aburrimos en casa.

Esos espacios que teníamos para pensar están completamente ocupados ahora por una distracción continua. A través de nuestro smartphone recibimos un hostigamiento de estímulos que no nos está dejando pensar.

Hay más cosas que se pueden hacer, pero a mí me parece esta la más básica y la más dócil. Solo el pensamiento crítico pueden defender la osadía individual frente al control algorítmico y la voluntad de terceros.

Es casi inútil no dar tus datos cuando te suscribes a una plataforma. Más complicado todavía leerse toda la carácter pequeña de un servicio o rebotar las «cookies» cada vez entramos en una página web. ¿Nos hemos vuelto perezosos?

Somos un poco vagos y un poco marionetas, pero incluso nos desidia la información.

Hay mucha gentío que no entiende que cuando está pasando horas delante de TikTok, lo que está haciendo es trabajar gratuito para la plataforma. Le das toda tu información de tu comportamiento online y esa información vale moneda.

Por eso es importante la educación, que es explicar cómo funciona el maniquí de negocio de estas grandes plataformas.

¿Cómo es posible que Google sea una de las compañías más ricas del mundo si no nos cobra por su servicio? Reflexionar sobre esto es muy importante para que la gentío entienda lo valiosísima que es toda la información que estamos dando sobre nosotros.

¿Cuál es el peligro de la inteligencia fabricado?

En verdad, el definitivo peligro es la estupidez humana, porque a ti la inteligencia fabricado no tiene por qué hacerte mínimo, son ceros y unos.

Lo que pasa es que nuestra haronía es tan extenso que si nos dan las cosas hechas, pues mucho mejor. Todo esto nos coloca en una situación en la que somos más manipulables.

Puedes analizar: Inteligencia fabricado crece un 49.7% de los empleados públicos ya la utilizan

Vivimos en un adormecimiento generalizado de la voluntad. Nos resignamos en presencia de la digitalización del sistema váter, la vigilancia masiva y la educación online de nuestros hijos. Asumimos las injusticias, los abusos y la ignorancia como cosas inevitables contra las que no podemos rebelarnos porque nos da haronía.

¿Cuáles podrían ser las consecuencias de fiarse plenamente en las predicciones automáticas de un sistema algorítmico?

Cuando delegamos les decisiones importantes, que incluso pueden tener que ver con la vida y la homicidio, el aventura es muy extenso, sobre todo porque hay estudios que demuestran que los humanos tendemos a pensar que si lo dice un ordenador, será verdad. Aunque nosotros pensemos diferente.

Entonces, ¿a quién le vas a dejar que decida? ¿A tu hermana, a tu profesor, a tu cabecilla, a la inteligencia fabricado? Este es un problema muy antiguo del ser humano y a mí me gusta mucho el ejemplar el psicoanalista, sociólogo y miembro de la Escuela de Frankfurt Erich Fromm, «Miedo a la osadía»que está dedicado a esto, precisamente.

Fromm defiende que los seres humanos preferimos que nos digan qué tenemos que hacer, porque nos da pánico pensar que depende de nosotros. Lanzarse nos da mucho miedo y preferimos ser como robots y que nos digan qué hacer. Y esto ya lo decía Fromm a principios del siglo XX.

¿Hay alguna forma de no dar nuestros datos online?

Claro que sí. Hay forma de no dar nuestros datos. Hay forma de dar lo encajado. Pero lo principal es enterarse cómo funcionan las plataformas. Y entonces puedes tomar medidas.

Aunque solo sea para ponérselo un poco más difícil a los que comercian con tu vida y con tus datos. Puedes acostumbrarte a pequeñas acciones como rebotar las cookies al entrar en una página.

¿Qué más podemos hacer?

Asimismo podemos musitar de la falta de tener una regulación que nos proteja, de desarrollar la ética por parte de las empresas que utilizan inteligencia fabricado.

Podemos musitar lo importante que es escuchar a los denunciantesa toda esa gentío que está adentro, que conoce el sistema porque trabaja adentro de empresas como Google o Meta y que cuentan cosas. Escucharlos y protegerlos incluso cuando deciden musitar.

¿Te refieres al caso Edward Snowden, que sacó a la luz los sistemas de vigilancia masiva aplicados por las agencias de inteligencia estadounidenses?

Sí, Snowden es para mí es uno de los héroes de este siglo, pero hay más. El suyo es el caso más conocido.

Asimismo está Sophie Zhang, científica de datos de Facebook, despedida posteriormente de alertar internamente sobre el uso sistemático de cuentas falsas y bots por gobiernos y partidos políticos para manipular la opinión pública y sembrar el odio.

Zhang se dio cuenta de que en muchas partes del mundo, en América Latina, Asia, incluso algunos sitios de Europa, había políticos usando cuentas falsas, con seguidores que no existíancon likes y reenvíos imparables, para engañar a los ciudadanos y hacerles creer que contaban con un apoyo y una recibimiento popular que no era cierta.

Cuando informó a sus superiores del problema, comprobó asombrada que nadie quería hacer mínimo para solucionarlo.

Tardaron un año, por ejemplo, en borrar la red de seguidores falsos del entonces presidente de Honduras Juan Orlando Hernández, notorio culpable por el Tribunal Federal de Distrito en Nueva York de conspirar para importar cocaína a Estados Unidos y de posesión de ametralladoras.

En tu ejemplar hablas incluso del caso de la ingeniera informática Timnit Gebru, codirectora del equipo de Ética de la inteligencia fabricado de Google, que incluso fue despedida.

Sí, por denunciar que los algoritmos favorecen la discriminación étnico y de condición. Alertó de que los modelos grandes de habla podían suponer un peligro, que la gentío se podía creer que eran humanos y que podían manipular a las personas. A pesar de la carta de protesta por su despido firmada por más de 1.400 empleados de la compañía, se quedó en la calle.

Otro «héroe del silbato» es Guillaume Chaslot, exempleado de YouTube, quien descubrió que el cálculo de recomendaciones empujaba sistemáticamente a los usuarios cerca de contenidos sensacionalistas, conspiranoicos y polarizantes.

¿Qué esperanza nos queda?

Lo que sí sabemos seguro es que, haga lo que haga, un software de software no puede aportar la más mínima dosis de creatividad para inventar opciones nuevas, es sostener, no basadas en la estadística de datos pasados.

Siquiera podrá dar soluciones basadas en la empatía para ponerse en la piel de otro ni en la solidaridad para agenciárselas la júbilo propia en la júbilo del prójimo.

Tres cualidades exclusivamente humanas por definición.