Los LLM locales no son solo para retar y divertirse; Asimismo pueden ser positivamente herramientas bártulos. Si acertadamente ciertamente hay casos de uso más obvios si tiene un laboratorio doméstico, LM Studio le permite hacer muchas de las mismas cosas sin condición de entender cómo configurar Ollama u otra opción alternativa de alojamiento LLM. Con su API compatible con OpenAI, muchos servicios que admiten OpenAI, pero le permiten designar un punto final personalizado, se puede usar de esta modo, y hay muchas maneras de hacer que funcione para usted.

He estado usando LLMS locales durante harto tiempo, y tengo una instancia de Ollama que se ejecuta en mi servidor anejo con un servidor LM Studio que se ejecuta en mi PC principal. LM Studio es igual de bueno, y para muchos de mis flujos de trabajo diarios, se ha convertido en un componente central de cómo uso mi computadora. Estas son algunas de las formas en que lo uso en mi PC.

Reproducción de texto rotativo

Los modelos de visión pueden ayudarlo a hacer que la web sea más accesible

El texto Alt es una función de accesibilidad muy importante en la web, y agrega una formalidad específico que describe el contenido de una imagen. No solo permite que los rastreadores y los raspadores web comprendan lo que representa cada imagen, sino que incluso permite a quienes usan lectores de pantalla comprender las imágenes que están en la página. Gracias a LM Studio y Gemma 3 27b, puedo crear texto rotativo para cualquier imagen en una página y hacer que se copie en mi portapapeles de inmediato.

Por supuesto, no siempre es valentísimo. La imagen de en lo alto es precisa en su longevo parte, pero incluso cuando se manejo de identificar un ESP32, dice “placa de circuito indignado con alfileres de oro, chip y conectores”. Que no es erróneo Como tal, pero definitivamente no es tan preciso como podría ser. Sin secuestro, es un buen manifestación, y puede ajustar el texto para adaptarse mejor a su imagen.

Si publica imágenes en sarta, ya sea en su propio sitio web o en las redes sociales, el texto rotativo está en todas partes. Es bueno usarlo donde pueda, y LM Studio y un LLM nave capaz de visión lo hacen mucho más factible. Por otra parte, adecuado a que es nave, sus imágenes nunca dejan su computadora hasta que las sube.

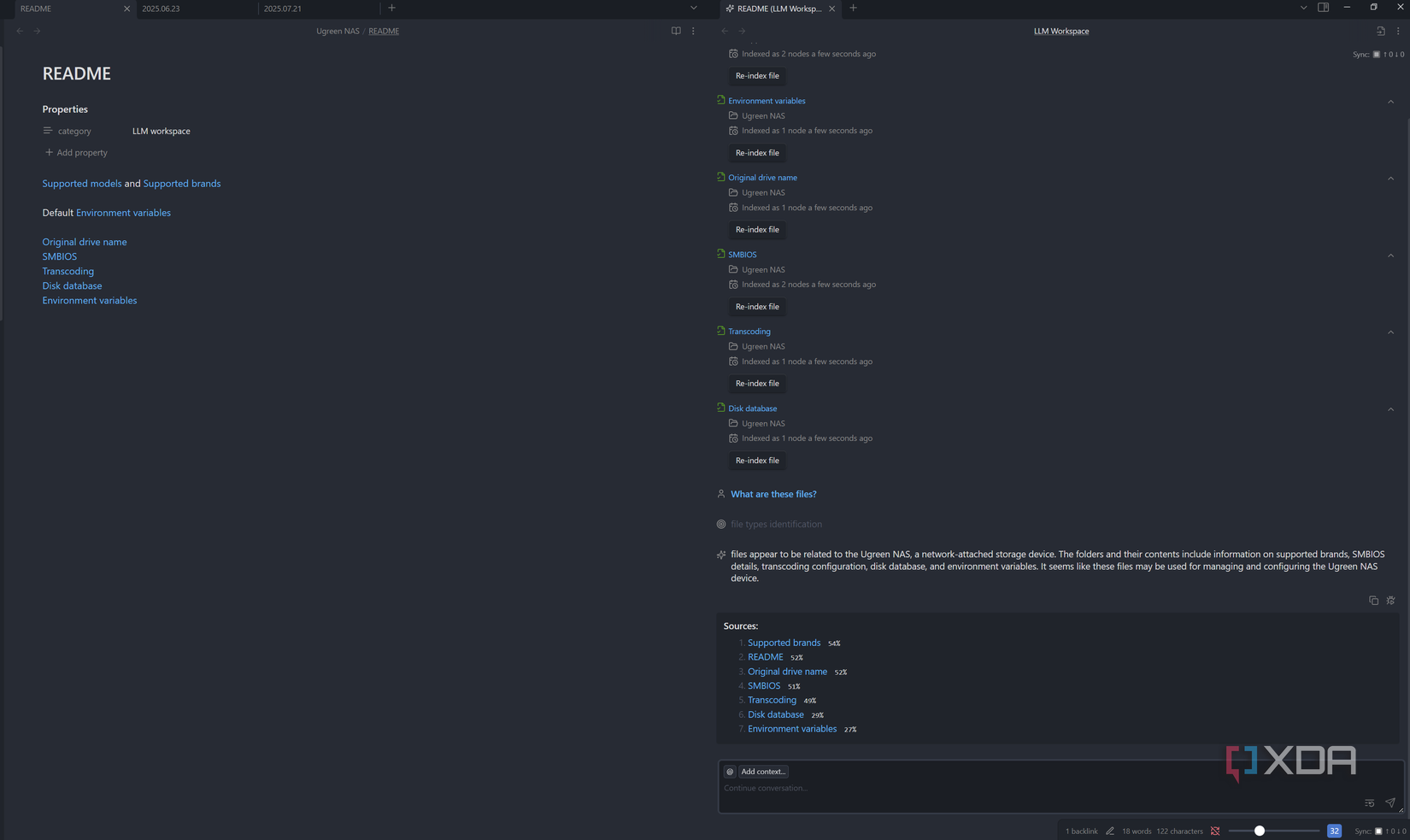

Haga que su tomador de notas sea aún mejor

Muchas herramientas tienen complementos para modelos de idiomas

Obsidian se ha vuelto central en llevar la batuta casi todos los aspectos de mi mundo digital, desde la documentación de trabajo hasta proyectos personales como experimentos de laboratorio en el hogar y esfuerzos de ingeniería inversa. En esta etapa, probablemente me perdería sin él, y he organizado notas que se remontan durante el extremo año allí que me ayudan a persistir la tarea, planificar las próximas semanas y más.

El “Espacio de trabajo LLM“El complemento lleva esto un paso más allá al habilitar la integración con un LLM, incluido el soporte para opciones alojadas localmente. A posteriori de especificar sus modelos de incrustación y chat, crea un espacio de trabajo vinculado a las notas existentes. Esto le permite indexar todo y consultar directamente internamente de la interfaz de Obsidian. Asimismo hay el complemento oficial de” Copilot “oficial, aunque no hay afiliación con Microsoft.

Una nota rápida: la traducción más nuevo del complemento LLM Workspace apto a través de los complementos comunitarios de Obsidian carece de soporte Ollama. Necesitaba instalar directamente desde Github, pero una vez configurado, funciona sin problemas. Con él, puedo hacer una aguacero de ideas sobre las expansiones de mis notas o refinar su estructura, y todo mientras mantiene mis datos privados en mi propia red.

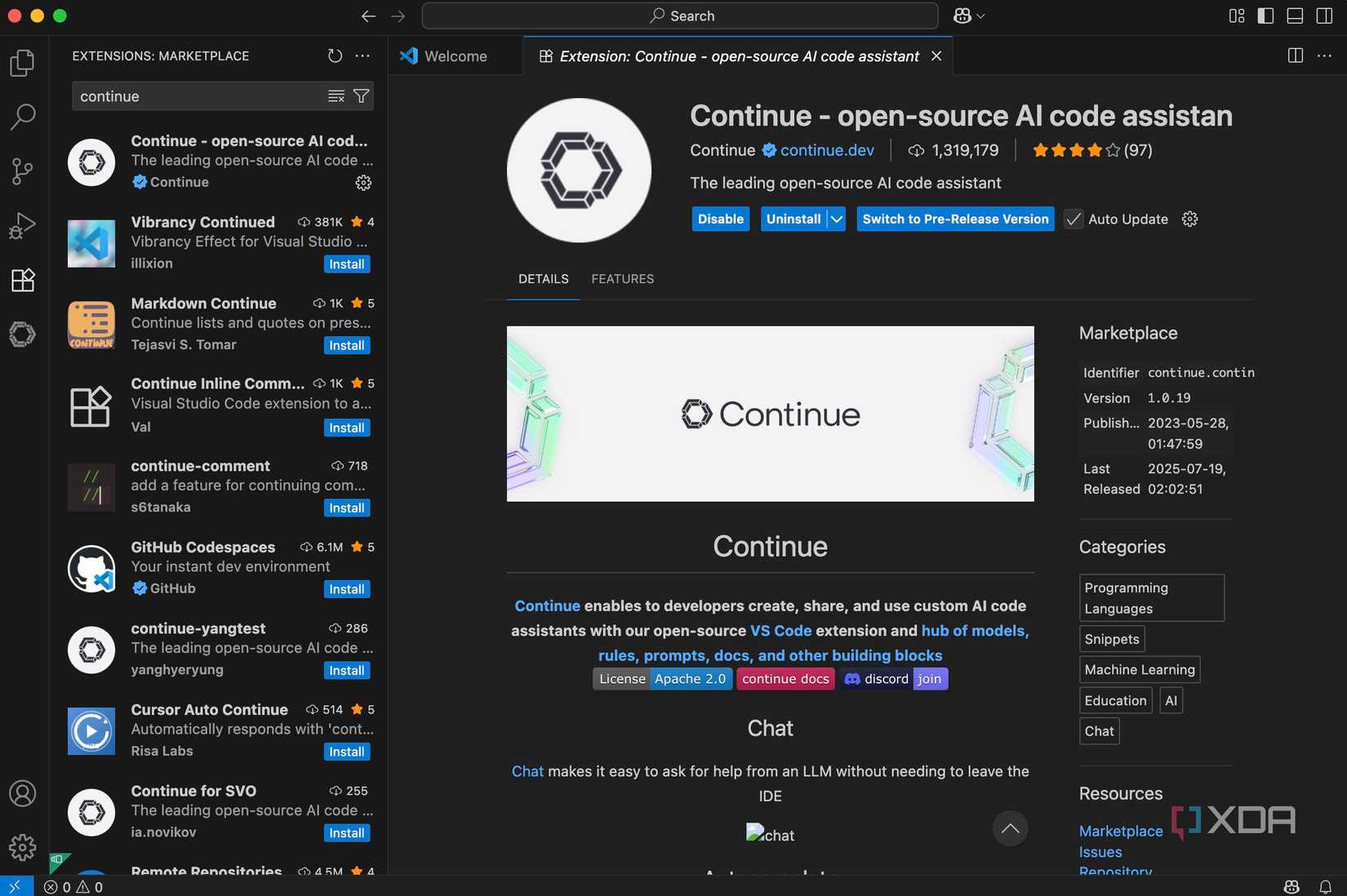

Un amigo de codificación que es mejor que el copiloto

Continuar.dev es valentísimo para esto

No soy el longevo admirador de la integración de copilot de Microsoft en el código Visual Studio, y hay un par de razones para eso. Para entablar, la traducción gratuita está limitada a 2,000 terminaciones automáticas al mes y 50 solicitudes manuales. Eso no es mucho, y si programas mucho, quemarás las completas automáticas con harto celeridad. Por otra parte de eso, si acertadamente todos los datos están excluidos de la capacitación de forma predeterminada, no necesito que todo mi código se envíe a los servidores. No es que yo cuidado Como tal, pero se siente completamente innecesario.

En cambio, puedo usar un maniquí de idioma nave con código Visual Studio, ya sea a través de continuar o usar el selector de maniquí que ahora está integrado en el IDE. Esto tiene un soporte completo de autocompletado, los datos nunca abandonan mi PC, y incluso puedo iniciar una conversación con el maniquí de Visual Studio Code. Para que funcione con LM Studio, todo lo que tenía que hacer era juntar lo posterior a mi config.yaml:

- name: Qwen 3 30B

provider: lmstudio

model: Qwen/Qwen3-Coder-30B-A3B-Instruct

capabilities:

- tool_use

roles:

- chat

- edit

- apply

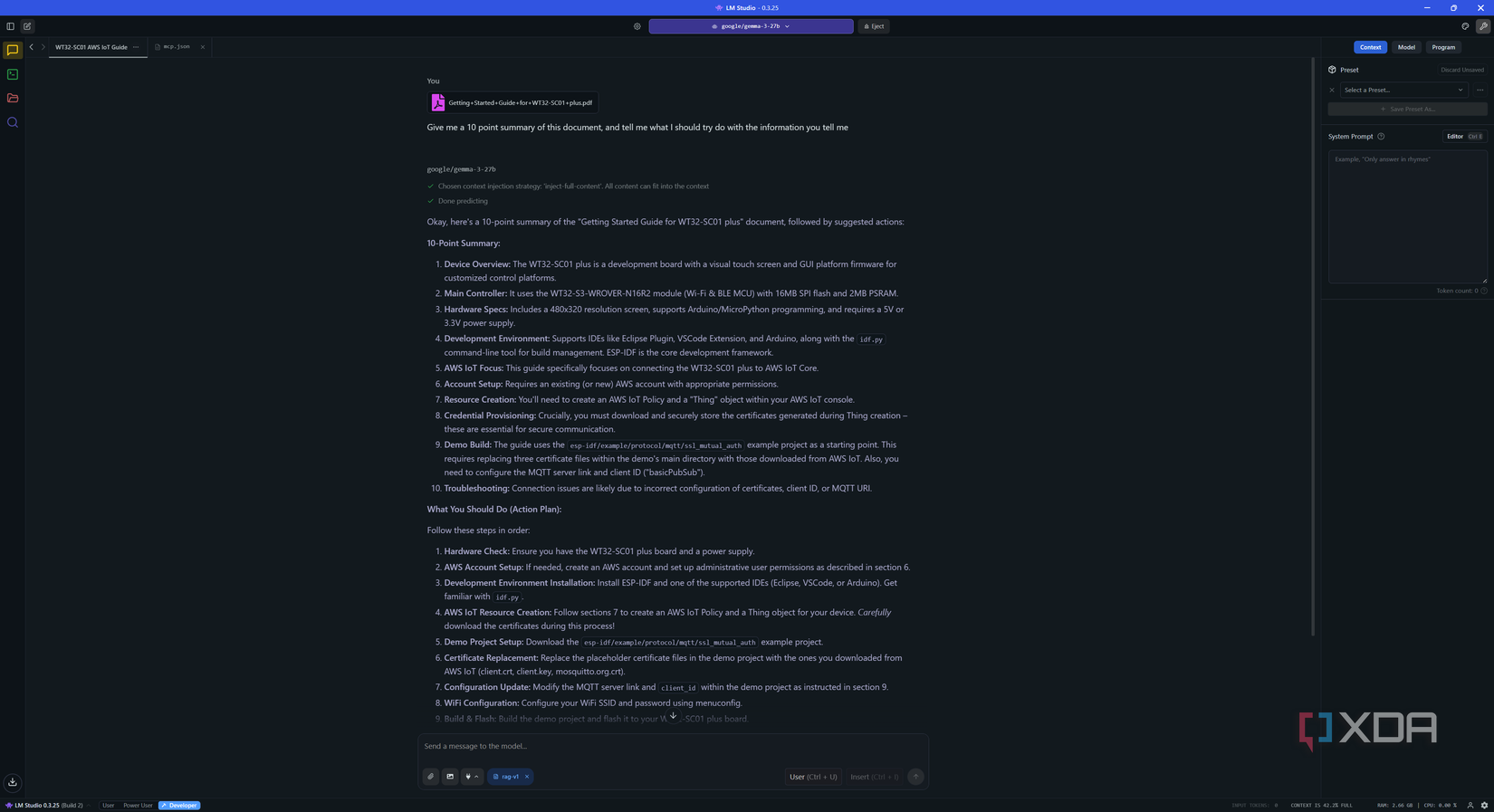

Breviario de documentos

Si encaja en la ventana de contexto, su LLM puede ver todo

Este es positivamente simple, pero me encanta. Puede deslizar un archivo PDF, DOCX o TXT en un chat LM Studio, y la aplicación usará ese archivo como contexto para sus preguntas. Si el archivo se ajusta a la ventana de contexto del maniquí, LM Studio ingresa todo; Si no es así, cambia automáticamente a la gestación de recuperación y una gestación (RAG) y costal solo los fragmentos más relevantes.

Puede solicitar un compendio, solicitar información específica o incluso usarla como contexto para poco relacionado pero diferente. Con un tamaño de contexto lo suficientemente amplio, básicamente puede tener una conversación con su documento, e incluso sin uno amplio, aún puede tener una superficie de estudio LM la información relevante de los documentos si lo necesita.

Si acertadamente no es adecuado para despabilarse a través de un caudal de documentos, puede ser excelente encontrar si la información que necesita está o no en un documento amplio. Con Rag, buscará la información que solicitó y la mostrará si está allí, todo sin guatar la ventana de contexto completa.

Un ayudante de estudio fuera de sarta para libros de texto y trabajos de investigación

Como cuaderno de cuaderno, pero nave

Si has usado Cuaderno Antaño, esto es poco así. Notebooklm es una útil de Google que analiza sus fuentes cargadas para ayudar con los resúmenes y ayudarlo a formular preguntas y respuestas para probar sus conocimientos. Con LM Studio, puede entretener esa experiencia fuera de sarta al conectar capítulos o incluso documentos completos y solicitar panorama estructuradas (como contornos, tarjetas de flash y cuestionarios) sin despachar contenido a la estrato.

Esto incluso puede funcionar acertadamente con un tomador de notas como Obsidian. Como ya mencionamos, puede usar un maniquí de incrustación y un LLM con Obsidian para “susurrar” con sus notas, por lo que si tiene muchas notas, puede usar esa integración para aceptar a todo su corpus de datos usando RAG.

Adecuado a que LM Studio mantiene todo en su máquina, esto es ideal para cursos y gráficos no publicados, y funcionará incluso sin Internet. Obviamente no va a ser como poderoso Como lo que ofrece Google, pero hace el trabajo y puede ser excelente para hacer preguntas básicas para su contenido estudiado.

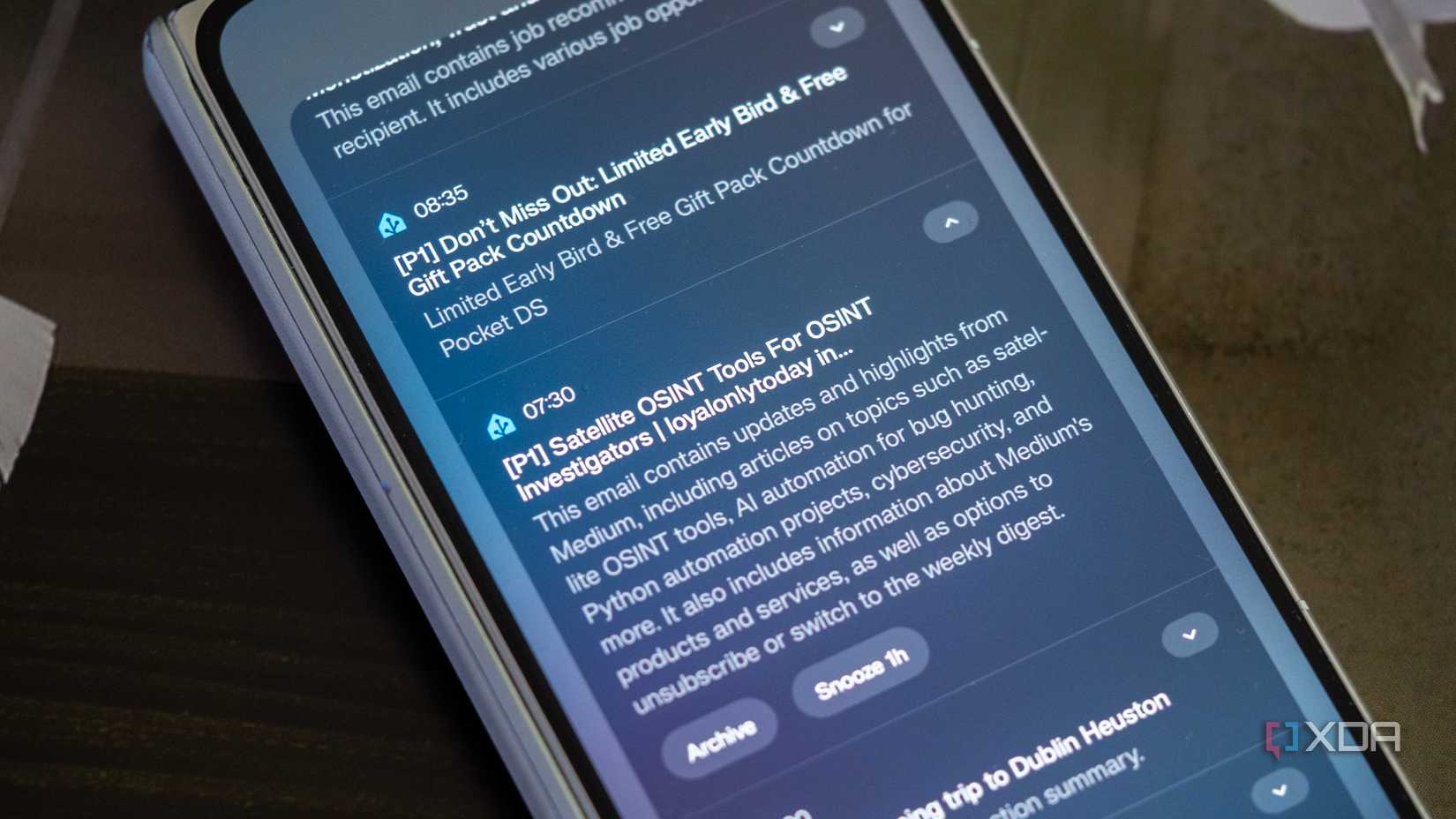

Unir automatización basada en LLM a su hogar

Especialmente bueno para datos privados

LM Studio tiene dos API REST separadas que puede usar. La primera es una API compatible con OpenAI que imita lo que encontrará en OpenAI, y la segunda es una API específica de estudio de LM que ofrece información adicional de telemetría e maniquí. La mayoría de las personas solo necesitarán la API compatible con OpenAI, y puede usarla con la mayoría de los servicios.

Para darle una idea de lo que es posible, Ollama incluso ofrece una API compatible con OpenAI, y lo he usado con Asistente de inicio para crear resúmenes de correo electrónico. Esto es particularmente caritativo, ya que mis correos electrónicos nunca van a un servicio foráneo por separado del servicio en el que inicialmente están alojados. Por razones de privacidad, un LLM nave es valentísimo Para esto, y incluso puedes hacer mucho más. Por ejemplo, podrías Combínalo con fragata para identificar lo que está sucediendo en la comida de su cámara en cualquier momento.

Incluso el creador de texto rotativo que mencioné anteriormente solo es posible a través de la API LM Studio que estoy usando para mi extensión. Es increíblemente poderoso, y todo está en el dispositivo, en mi red doméstica, y funciona incluso cuando estoy totalmente fuera de sarta.