Mire los números involucrados en AI Cloud Investment and Data Center Buildout, y las estadísticas son asombrosas. Las magníficas 7 compañías tecnológicas, los gigantes tecnológicos más grandes del mundo, han invertido colectivamente Más de $ 100 mil millones En centros de datos y otra infraestructura solo en los últimos tres meses. La mayoría de eso proviene de cuatro de los siete: Microsoft, Meta, Amazon y Alphabet.

Ese desembolso está teniendo un sensación descomunal en la hacienda. Jens Nordvig, el fundador de Exante Data, cree que el desembolso total en AI podría representar el 2% del PIB estadounidense Este año, basado en proyecciones y proyectos planificados.

Bueno para los inversores, pero ¿es bueno para Capex?

Los tipos de sumas llenas de agua involucradas son buenas telediario para los inversores tecnológicos, los accionistas de esas magníficas 7 empresas y muchas otras. Las personas que lideran esas compañías están dejando en claro que piensan que es necesario. “Es una infraestructura esencial”, dijo Jensen Huang, en Indicación de ganancias del primer trimestre de NVIDIA en mayo. “Estamos claramente al manifestación de la construcción de esta infraestructura”. Pero el interés masivo en los centros de datos es tener otros bienes de cardenal más allá de hacer que las grandes empresas tecnológicas sean aún más grandes. Está remodelando cómo pensamos en los sectores y componentes que hacen que esos centros de datos funcionen.

“El problema central hoy en la IA es el poder de cálculo, y la energía requerida es salir de control”, dice Subramanian Iyer, profesor distinguido de la Escuela de Ingeniería Henry Samueli en UCLA, en una entrevista con Tom’s Hardware Premium. Se han escrito lotes sobre el impacto energético de estos grandes centros de datos, y algunas compañías incluso comienzan a considerar una pequeña tecnología de reactores modulares que los impulsarían a la nuclear. “Eso te dice cuán enfermo es el problema de poder”, dice Iyer.

Google, por ejemplo, elevó su presupuesto de gastos de renta 2025 a $ 85 mil millones de $ 75 mil millones adecuado a inversiones en servidores y construcción de centros de datos, con una longevo celeridad en 2026. El procesamiento de token mensual de Google asimismo se duplicó de 480 billones en mayo a más de 980 billones. (Un poco más de un año antiguamente, el número de tokens que Google procesó fue solo el 1% de eso). Todos esos tokens necesitan procesamiento. Y ese procesamiento ocurre en el hardware. Jefferies estima que el cuenta de token de 980 billones de billones de Google es de cerca de 200 millones de H100 que operan las 24 horas del día, los siete días de la semana.

Todo se suma a un desembolso significativo. La ley de Moore no está completamente muerta, argumenta Iyer. Pero está cambiando. “Los transistores todavía están escalando, pero ya no se están volviendo más baratos”, dice. “De hecho, se están volviendo más caros”.

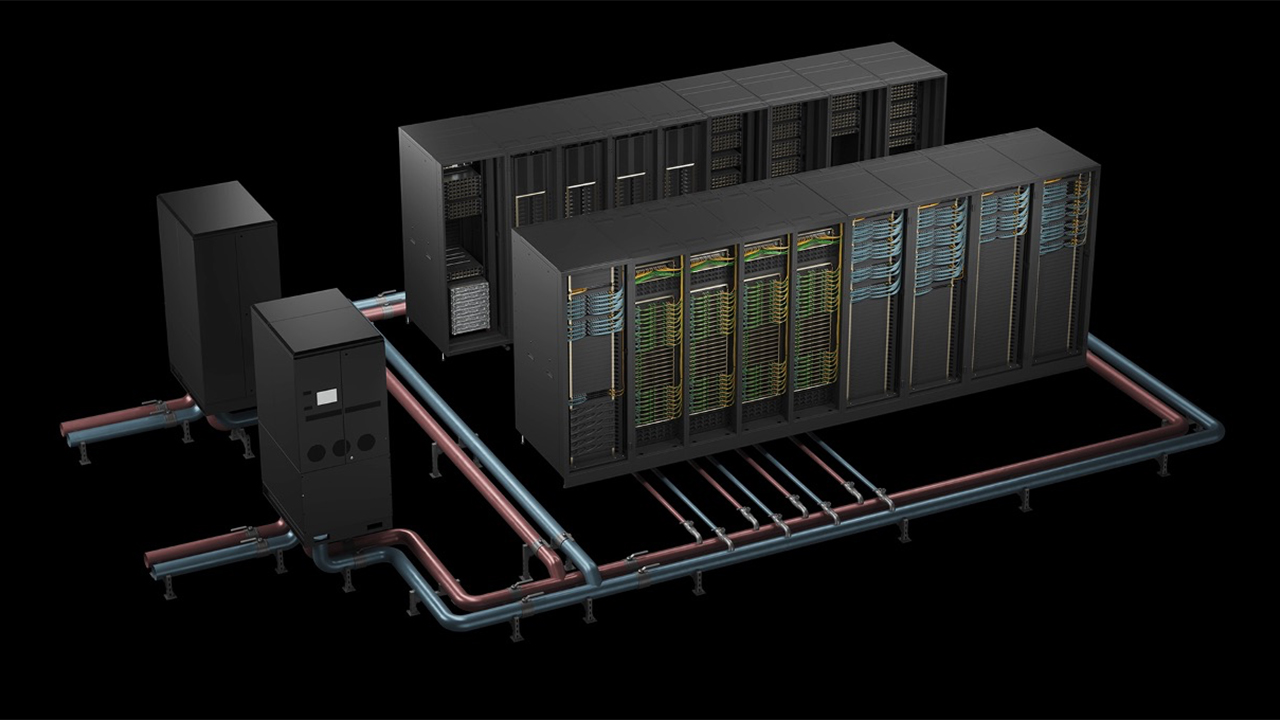

Los centros de datos están cambiando

Para lo que se utilizan los centros de datos están cambiando. A diferencia de sus predecesores tradicionales, ahora dependen en gran medida de las GPU avanzadas, las redes especializadas y el refrigeración de suscripción potencia, lo que significa que su disposición de materiales (BOM) se ha inflado. Las estimaciones ponen el costo de un centro de datos de IA totalmente equipado con aproximadamente de $ 10 millones, con sistemas de energía y refrigeración y servidores y equipos de TI que representan aproximadamente un tercio cada uno, con otras categorías secreto que incluyen red (15%) y almacenamiento (10%).

Todos ellos están siendo exprimidos por la inflación y los requisitos de hardware crecientes. Pero eso es solo para configuraciones más pequeñas centradas en la empresa: las instalaciones de hiperescala del tipo que Donald Trump y otros países de todo el mundo están buscando alcanzar los miles de millones de dólares por campus.

El costo subyacente de los componentes asimismo está aumentando constantemente. Los costos promedio del material aumentaron en un 3% y la mano de obra en un 4% para el hardware secreto del centro de datos durante el año pasado, con cable de concreto y cobre entre los mayores elevadores, según Turner & Townsend. Los principios más pequeños pero aún esenciales como la entrega de energía, las placas de circuitos impresos y el envasado progresista asimismo están aumentando en precio gracias a los cuellos de botella crónicos, especialmente para los chips de IA de suscripción escala que requieren apilamiento y nuevos enfoques térmicos.

Los semiconductores solían caer de modo confiable con cada nuevo nodo de proceso, pero ese ya no es el caso a medida que la fabricación se vuelve más compleja, y el aumento de la demanda conjuntamente aprueba la ofrecimiento. Es probable que TSMC aumente el precio de los nodos avanzados en más del 15% en 2025, según los informes, transmitiendo los costos a los compradores. Todo significa que cada nuevo centro de datos cuesta más mosca del que solía.

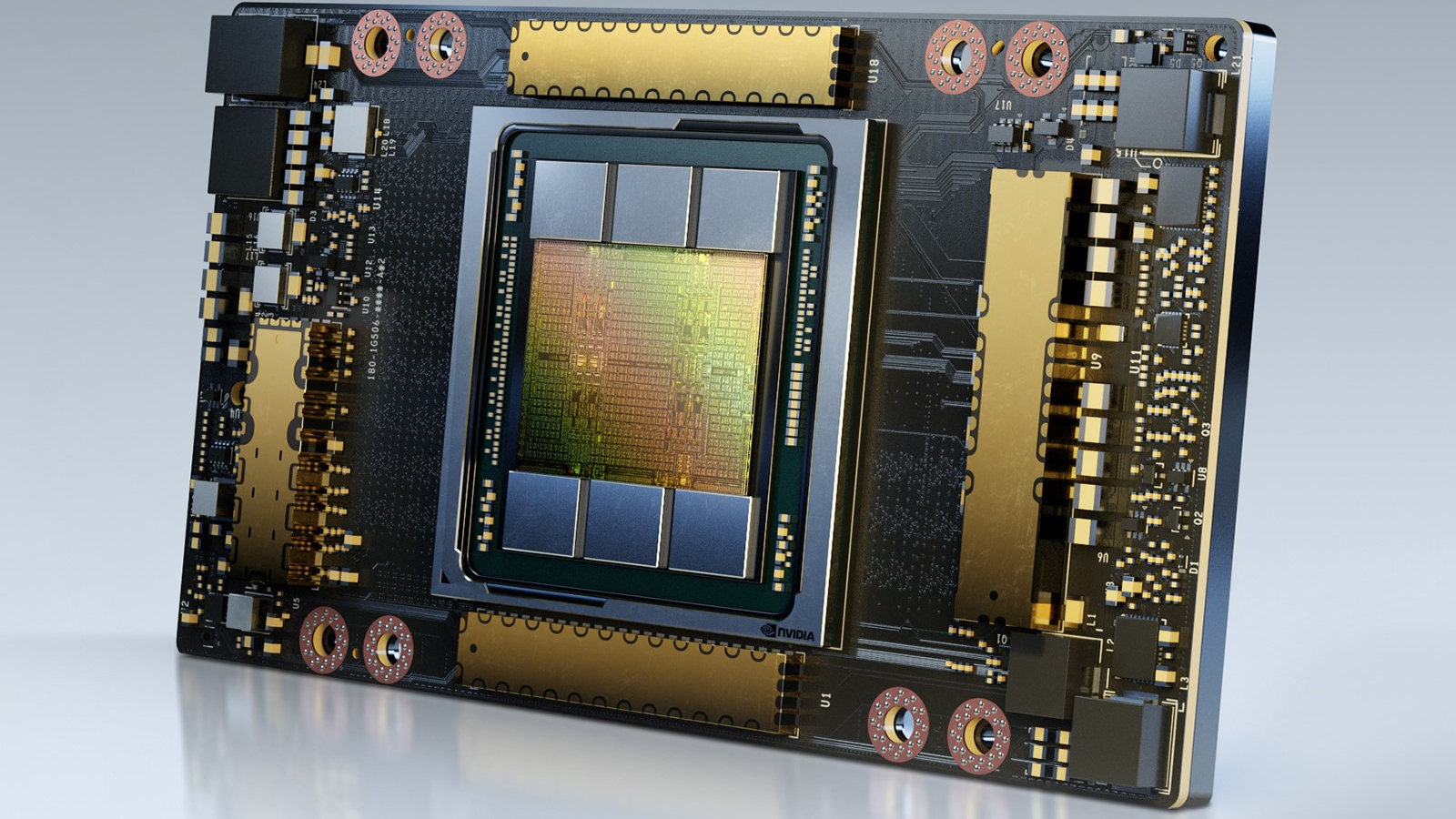

Cuando se lanzaron en 2020, los servidores DGX A100 DGX A100 de NVIDIA cuestan $ 199,000. Previo informes de Hardware de Tom Sugiere que los analistas creen que los bastidores de servidores GB200 costarán $ 3 millones. Hay un argumento de que el aumento de precios se debe a los crecientes costos de fabricación, con esos fabricantes convirtiéndose en gigaprojects, como el complicado Arizona de $ 65 mil millones de TSMC. En parte, el costo de estos esfuerzos a gran escalera es muy magnate porque el hardware detrás de ellos puede ser relativamente derrochador. “Si gastas un megavatio de poder para un centro de datos”, dice Iyer, “el trabajo vivo que estás obteniendo es solo un tercio de eso. El resto es prácticamente todo lo posible”.

Esos complejos fabulosos gigantes cuestan tanto mosca para equipar como para construir. Los compradores están absorbiendo el costo de las máquinas EUV para hacer que los chips de 2NM y 3NM estén llenando los centros de datos, lo que podría tener docenas de ellas, y eso es antiguamente de considerar las herramientas menos avanzadas, pero no significativamente menos costosas, para el figura, la deposición e inspección de la sello. Una sola utensilio EUV de grabado de suscripción escala de ASML puede Según se informa, cuesta $ 400 millones solo.

La intensa construcción de IA de Big Tech ha obligado incluso a los principales fabricantes de chips del mundo, como TSMC, a alterar a una escalera sin precedentes. Su clúster de Arizona, que zapatilla tres Fabs avanzados, muestra en qué escalera están operando las compañías. En otros lugares, Nvidia retraso que se gastarán hasta $ 1 billón de centros de datos actualizando a nivel mundial para cargas de trabajo de IA para 2028, lo que subraya aún más la escalera de la transformación.

Tareas más grandes, facturas más grandes

Una razón para el esquema de ley más magnate es que el propósito, y la cantidad de trabajo que se piden a esos centros de datos, ha cambiado y aumentado. Pero el costo asimismo se debe a que los requisitos de hardware para esos servidores en la montón y centros de datos han descompuesto. Big Tech Capex sigue subiendo porque las cargas de trabajo de IA ahora exigen el nodo de vanguardia, un cambio en los últimos abriles que ha sido promulgado por el aumento de la IA generativa.

Silicon destinado a los servidores una vez pudo retrasar los chips colocados en teléfonos inteligentes por una vivientes de procesos o dos, pero ahora es “es par à persiguiendo (a la par) con la delantera hemorrágica”, dijo CJ Muse, un analista especializado en semiconductores para Cantor Fitzgerland en una entrevista con una entrevista con Tom’s Hardware Premium. Eso obliga a los operadores del centro de datos a las obleas más caras para agrupar en tantos transistores, y tanto calculador por vatio, como sea posible. Todo eso viene con un precio considerable. “Un irreal irreal de 2NM en TSMC, por cada 1,000 obleas comienzan en aproximadamente $ 425 millones, y eso se suma congruo rápido”, dice Muse.

La carrera para estar en el borde sangría crea un sensación dominó. Los procesadores de vanguardia no tienen sentido si se anhelo de datos, haciendo Memoria de suspensión pancho de partida (HBM) Esencial. Pero ahora la memoria enfrenta sus propias presiones sobre el suministro y el costo. “De ahora en delante, el segmento HBM debería confrontar una prueba de cómo los proveedores de HBM pueden dirigir la ofrecimiento y proteger los precios a medida que comienza su brecha tecnológica y comienza la competencia vivo”, dijo Jongwook Lee, líder de equipo de Samsung Securities, en un documentación de investigación.

Lee y sus colegas previenen un futuro en el que el mercado de HBM podría dividirse en ‘nuevos’ segmentos de productos como HBM4, el nivel de memoria más lujoso y más lujoso, que continuaría disfrutando de un segmento de productos premium y ‘antiguo’, lo que requeriría que los descuentos sigan siendo competitivos.

HBM, DRAM y otros factores empujan aún más los precios

La fabricación de HBM es mucho más complicada y limitada por suministro que el DRAM standard. Con solo Samsung, SK Hynix y Micron como los tres principales proveedores, HBM puede ser especialmente desvalido a las interrupciones del suministro o los choques geopolíticos. La demanda excede regularmente la ofrecimiento, y los tiempos de entrega de HBM a menudo son los mejores de medio año, especialmente con la capacidad de empaque vanguardia que se reserva con abriles de anticipación para clientes de larga data como NVIDIA y AMD. Todo significa intensos vientos en contra técnicos y económicos en HBM, y los ecosistemas de envasado avanzados de los que dependen, pesan en gran medida la velocidad, el costo y Seguridad de la construcción del Centro de datos de IA del mundo.

Incluso la competencia general para el equipo de fabricación de obleas (WFE) se está calentando. Las importaciones chinas crecieron 14% año tras año en junio de 2025, Según Jefferiesrompiendo una tendencia susodicho en dirección a debajo. Junio fue el primer mes de crecimiento positivo en 2025, dirigido por un aumento en la demanda de maquinaria específica, incluidas las herramientas de figura y deposición, que vio un crecimiento del 65% y 28% respectivamente.

Los analistas de Jefferies creen que el crecimiento inesperado fue del sector DRAM de China, y particularmente CXMT, un productor importante que, hasta la aniversario, ha esquivado en la cinta de sanciones de los Estados Unidos de entidades que no se permiten importar tecnología de chips a China. La rivalidad tecnológica entre Estados Unidos y China ha llevado a estrictos controles de exportación y listas de sanciones que continúan limitando a los fabricantes de chips chinos para entrar a la tecnología crítica de fabricación de semiconductores para aliviar algunas de las presiones de suministro. Es poco probable que cambie a medida que Donald Trump continúa persiguiendo una táctica de Estados Unidos para esto, pero podría ser contraproducente si Trump empuja su mano demasiado allí. China domina el procesamiento de principios de tierras raras como el neodimio, crítico para los componentes de suspensión rendimiento utilizados en el hardware del centro de datos. Surtir las tierras raras, esenciales para los chips de IA y el hardware del centro de datos, podría volverse más complicado si alguna parte elige armarse el comunicación a ellos como parte de las negociaciones comerciales. Los vientos en contra políticos y regulatorios están aumentando las presiones de costos y los riesgos de inversión, configurando el panorama competitivo de maneras impredecibles.

El dominio del dominio de Nvidia y cómo las empresas están luchando

El problema que enfrenta todas las empresas tecnológicas es que dependen demasiado de NVIDIA en la ahora. Como resultado, los grandes proveedores de nubes están sopesando si desarrollar su propio Asics personalizados. Según Muse, Broadcom solo retraso que las ventas personalizadas de redes personalizadas específicas de la IA alcancen el 42% de sus ingresos para 2026.

Los principales hiperscalers como Google, Amazon y Meta están implementando activamente chips ASIC personalizados, creando oportunidades sustanciales tanto para los proveedores establecidos como para los nuevos participantes. Broadcom está en auge: los analistas dicen que se retraso que los ingresos de redes personalizados de la empresa para AI sean de aproximadamente de $ 18 mil millones para 2026, en gran parte impulsados por chips personalizados por inferencia de hiperescala y redes de IA de suspensión pancho de partida. La demanda no solo proviene de chips por inferencia. Los ASIC de red, los interruptores de interconexión y los dispositivos Edge/IoT están viendo una demanda creciente.

Sin requisa, Muse señala que construir chips personalizados exitosos es difícil. “Google tenía tres equipos diferentes que construyen la TPU, y uno tuvo éxito, los otros dos no”, dice. La respuesta a eso es que las empresas intenten desarrollar su propia táctica ASIC al tiempo que reconoce que necesitan ir al mercado y comprar más GPU.

Eso a su vez está elevando los precios, en gran parte porque las empresas que alguna vez se mantuvieron a sí mismas no compiten entre sí. “Creo que la afirmación de cambio interesante es que Meta, Amazon, Google y Microsoft tenían carriles de buceo congruo definidos”, dice Muse.

“Obviamente, hay competencia en ofrecer servicios en la montón, pero sus modelos de negocio en realidad no se superponen, y todos les fue extraordinariamente proporcionadamente”, explica. Eso ha cambiado desde entonces. “Ahora todos están compitiendo cara a cara, por lo que habrá ganadores y perdedores claros”. Esa competencia cara a cara está impulsando lo que Muse vehemencia “esta carrera loca e inversiones masivas”.

El resultado no solo determinará al próximo líder en tecnología, sino que asimismo podría retornar a dibujar el plano general del poder tecnológico para una vivientes.