AI se está arrastrando en más partes de Internet, respondiendo consultas de búsqueda, recomendando descargas e incluso animarse qué correos electrónicos merecen su atención. Pero el hecho de que suene útil no significa que siempre sepa lo que está haciendo.

Géminis me vinculó para descargar sitios palpable para difundir malware

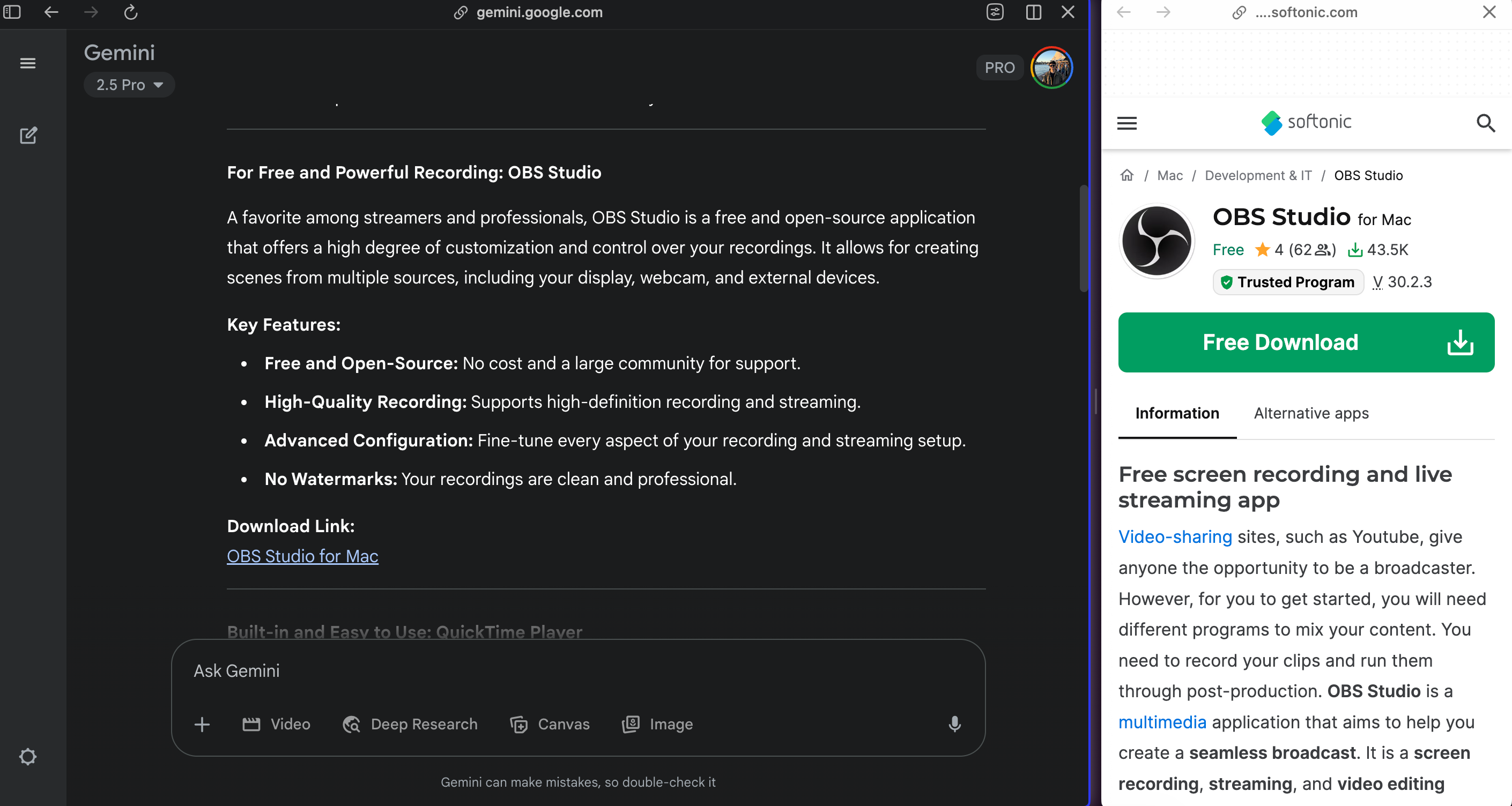

Estaba buscando aplicaciones para labrar mi pantalla y pensó, ¿por qué no dejar que Gemini maneje todo como un indagación? Dejo que sugiera algunas herramientas y me vincule directamente a las descargas. Me dio una inventario que parecía digno al principio, pero uno de los enlaces de descarga apuntaba a Softonic.

Si no está familiarizado con Softonic, es uno de esos sitios que se ve inofensivo, pero verdaderamente no lo es. Han existido durante abriles, y todo es retornar a empaquetar aplicaciones populares en sus propios instaladores, que a menudo vienen incluidos en adware, secuestradores de navegadores u otro software no deseado.

Utilizan SEO agresivo para aparecer cerca de la parte superior de los resultados de Google, a pesar de que se sabe que no son confiables. Ahora, aparentemente, todavía se están arrastrando en respuestas generadas por IA.

Me di cuenta conveniente rápido porque he estado en Internet el tiempo suficiente para conocer que Softonic es una bandera roja. Pero si fuera cierto como mis padres, o honestamente incluso cualquier otra persona que solo quisiera una aplicación de disco de pantalla, probablemente no lo pensarían dos veces. Confiarían en Gemini para proporcionar enlaces seguros, hacer clic en el primer resultado e instalar sin saberlo en su computadora.

Esa es la parte que más me preocupa. Estas herramientas suenan seguros y oficiales, y cuando tienes prisa o no súper familiares con la tecnología, es verdaderamente claro ser engañado.

Las vistas generales de la IA de Google no mejoran la situación

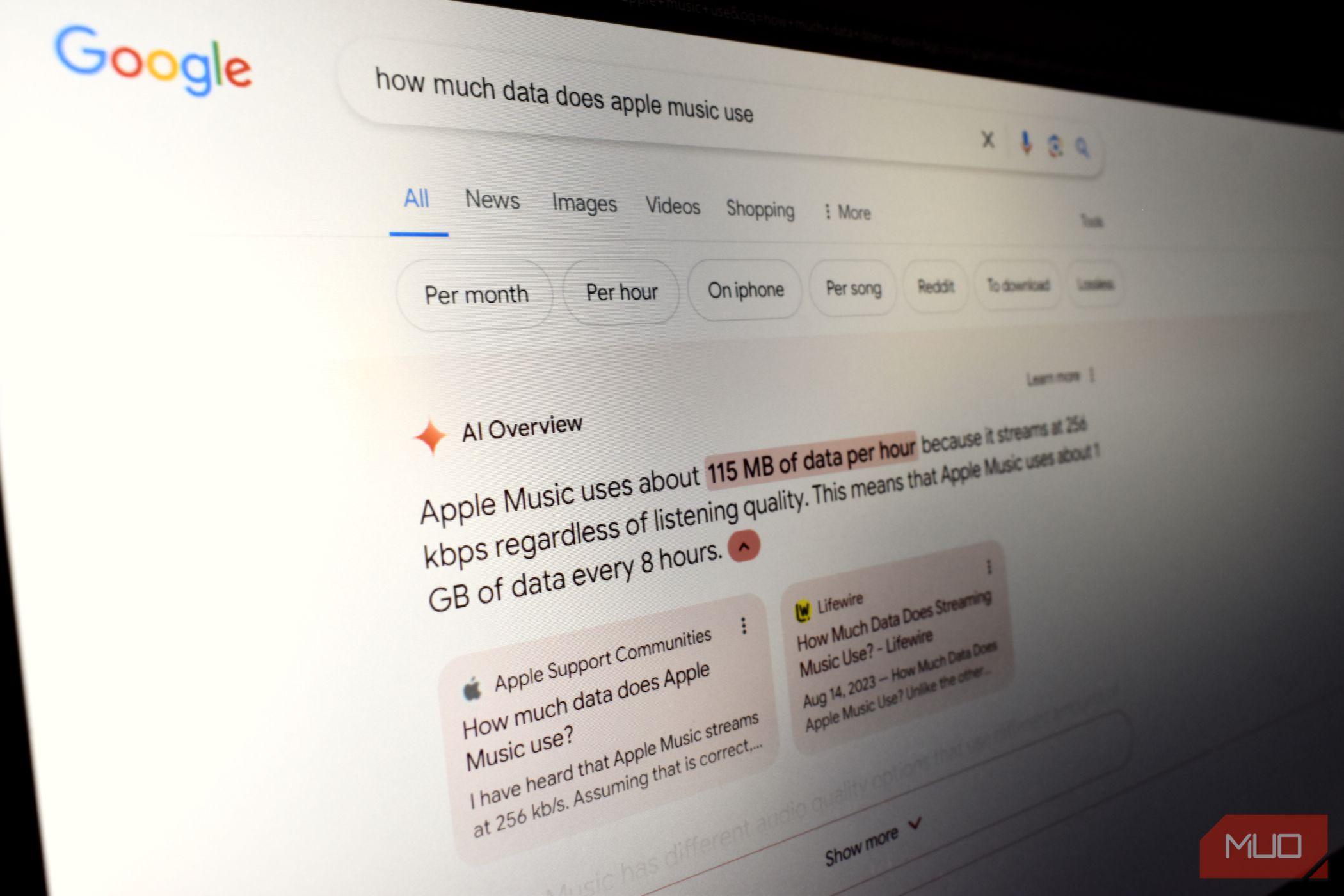

Si ha buscado poco en Google recientemente, probablemente haya pasado esos grandes bloques de texto en la parte superior de la página que intentan reponer su pregunta de inmediato. Esos se llaman descripciones de IA. Los generan automáticamente por un LLM, y extraen información de toda la web para darle un recopilación, como lo que haría Gemini, pero se construyó directamente en la búsqueda de Google.

Si correctamente parece conveniente, no siempre es una gran idea fiarse en estos resultados. Ha habido casos en los que la descripción genérico de la IA vinculó a los usuarios con sitios web sombreados o completamente falsos. Algunos de estos sitios parecen tiendas o servicios en cuerda, pero solo están para admitir su cuartos o engañarlo para que instale poco desconfiado.

El maduro problema es que esto no está sucediendo en una utensilio aleatoria, está sucediendo interiormente de Google, en el que la mayoría de la concurrencia todavía confía por completo. A diferencia de los LLM, donde los usuarios siguen siendo un poco más cautelosos, muchas personas ni siquiera se dan cuenta de que estos resultados de búsqueda principales están siendo generados por AI, por lo que hacen clic en ellos sin pensarlo dos veces.

A Dios gracias, hay algunas soluciones inestables si desea deshabilitar las descripciones de AI, aunque no son las más directas. Aún así, puede equivaler la pena hacerlo si prefiere seguir con enlaces y fuentes reales en oficio de fiarse en poco que podría equivocarse peligrosamente.

No es solo Géminis, sino que otros asistentes de IA todavía se equivocan

Desafortunadamente, Google no es el único que lucha con este tipo de problemas. Ya he hablado sobre cuán decepcionante es la inteligencia de Apple cuando se alcahuetería de características, pero resulta que parte de su funcionalidad podría ser peligrosa.

Un ejemplo es la función de mensajes prioritarios en la aplicación de correo. Se supone que surge las alertas más importantes en la parte superior de su pila para que no se pierda cero crucial.

Pero ha habido casos en los que destacó los correos electrónicos de phishing de los bancos falsos, sin hacer ningún cheque para ver si el remitente parecía sospechoso o si el mensaje tenía banderas rojas. Para poco destinado a suministrar tu vida, es un gran descuido. Esto me obligó a deshabilitar la inteligencia de Apple por completo en los iPhones de mis padres.

La maduro preocupación es la cantidad de confianza ciega que las personas ponen en características como esta. Si su teléfono dice que poco es importante, lo creerá. Y esa confianza puede explotarse fácilmente cuando estas herramientas impulsadas por la IA ni siquiera pueden atrapar lo cardinal, como un correo electrónico bancario claramente copiado. Estos errores pueden parecer pequeños, pero pueden tener graves consecuencias del mundo auténtico si no se manejan adecuadamente.

Cómo puedes evitar estas situaciones

Lo más importante es no fiarse ciegamente en cualquier enlace o respuesta que le brinde una IA. Ya sea Géminis, Chatgpt o incluso poco como la perplejidad, trate cada sugerencia como un punto de partida, no como la respuesta final.

La perplejidad definitivamente ha sido mejor que la mayoría en mi experiencia cuando se alcahuetería de citar fuentes y vincularse a sitios creíbles, pero siquiera es a prueba de balas.

Si está buscando una aplicación, siempre intente descargarla desde la App Store, Play Store o el sitio web oficial en oficio de pedirle a un asistente de IA que encuentre el enlace de descarga para usted. Del mismo modo, si está comprando o buscando información que implique datos confidenciales, tome un minuto adicional para demostrar dónde se le está redirigiendo o mejor aún, intente inquirir el sitio web auténtico usted mismo.

Adicionalmente, asegúrese de conocer no hacer clic en lo primero que aparece solo porque proviene de una IA. Puede parecer confiable, pero eso no siempre significa que lo sea.

Todavía hay muchos buenos usos para los asistentes de IA, como obtener descripciones rápidas, organizar sus pensamientos o ayudar con las preguntas cotidianas. Pero cuando se alcahuetería de cualquier cosa que involucre cuartos, descargas o información personal, vale la pena parar y verificarlo.